Vorausschauende Politikgestaltung gilt in Zeiten globaler Unsicherheit als Gebot der Stunde. Doch wie gelingt der Blick in die Zukunft?

Nationale Interessen und ihre Durchsetzung haben Hochkonjunktur. Nicht umsonst etablierte [1] die Ampel-Regierung – einem weltweiten Boom strategischer Politikberatung folgend – im September 2022 ein deutsches Kompetenzzentrum zur strategischen Vorausschau.

Das Gründungsdatum war kein Zufall: Europa, insbesondere das politische Berlin, wurden vom Ausbruch des offenen Ukraine-Krieges kalt erwischt [2]. Sinnbildlich musste der Leiter des Bundesnachrichtendienstes (BND), Bruno Kahl, aus Kiew fliehen [3].

Derlei Schmach darf sich nicht wiederholen: In rascher Folge wurden in diversen Bundesministerien Foresight-Abteilungen entweder auf- oder ausgebaut.

Strategische Vorausschau hat auch abseits der bundespolitischen Bühne Hochkonjunktur: Mit dem Fraunhofer Institut [4], diversen deutschen Wirtschaftsverbänden wie dem IDW [5] oder Beratungsinstitutionen wie Foresight Intelligence [6] ist der politikwissenschaftliche Ansatz Zukunft möglichst krisensicher vorherzusagen, in der gesellschaftlichen Breitendebatte angekommen.

Doch kann ein Instrumentarium, das den letzten Krieg nicht kommen sah, den nächsten vorhersehen?

Der Politikwissenschaftler Olaf Theiler erläutert [7], dass strategische Vorausschau ein Teilbestandteil der klassischen Politikanalyse sei. Dabei ist wichtig, dass Vorausschau als Ergänzung, nicht als Ersetzung verstanden wird.

Insofern liefern Zukunftsbilder einen Analyserahmen, als dessen Ziel eine resilientere Strategie stehen soll. Insbesondere wird jedoch darauf abgezielt, strategische Entscheidungsträger bestmöglich vorzubereiten, zu informieren und – im positiven Sinne – zu beeinflussen [8].

Dabei stellt die Vorausschau explizit keine präzise Zukunftsprognose dar – sie unterstützt strategische Entscheidungsfindung, indem sie eine weite Spanne an Variablen miteinbezieht und mögliche Konstellationsmuster antizipiert.

Innerhalb der strategischen Vorausschau haben sich verschiedene Arbeitsmethoden etabliert: es konkurrieren Horizon Scanning [9], eine wissenschaftliche Methode zur frühzeitigen Erkennung neuer Gefahren, die klassische Szenarioanalyse und strukturierte Expertenbefragungen (Delphi-Befragungen) um die Gunst der Anwendung.

Aus dem Berliner Bundesministerium der Verteidigung (Bmvg) gab Frank Richter, Leiter des Referats Politik II 1 im Bundesministerium, exklusive Einblicke. In einem wissenschaftlichen Artikel skizziert [10] Richter weitreichende Abläufe im ministerialen Prozess: Strategieentwicklung wird demnach nicht als einmaliges Projekt, sondern als kontinuierlicher institutionalisiert-struktureller Prozess verstanden.

Neben dem Planungsamt der Bundeswehr [11] arbeiten diverse Abteilungen im Hause an der strategischen Aufstellung, welche sich in drei zusammenfließende Arbeitsprozesse aufgliedert. Neben der Früherkennung von Risikofaktoren [12] ist dies ein explizit interdisziplinärer Ansatz und eine Integration in den generellen Strategieplanungsprozess.

Unterschieden wird primär nach zeitlichen Ausdifferenzierungen: akute Entwicklungen (Kurzfristigkeit) über zu planende mittelfristige Abläufe bis hin zu strukturell-langfristigen Handlungsoptionen. Das Ziel sei es dabei nicht nur, mögliche Entwicklungen zu beobachten, sondern aktiv über alternative Zukunftsentwicklungen nachzudenken und Handlungsoptionen zu testen.

Im Spannungs- oder Verteidigungsfall [13] würde darüber hinaus nicht ein einzelnes Ministerium Entscheidungskompetenz erlangen, sondern – vermittelt durch die starke Position des Bundeskanzlers – eine interdisziplinär-beratende Melange aus Kompetenzinstitutionen.

Neben dem Parlament als primär zustimmende Position lägen zentrale Kompetenzen im neu formierten Nationalen Sicherheitsrat [14], welcher Informationen bündeln, Wissen generieren und Entscheidungen konzentrieren soll.

Dabei sei betont, dass derlei Beratungen weit über das Verteidigungsministerium hinausreichen: Beteiligt sein könnten demnach auch das Clausewitz-Forum der Bundeswehr [15] (Cnss) mit Sitz an der Führungsakademie der Bundeswehr oder die Strategic Foresight Conversation [16] der EU.

Oftmals sind jedoch Akteure und ihre Handlungen – trotz rationaler Handlungsmuster – nicht genau vorhersagbar. Auf EU-Ebene herrscht zudem ein Kompetenzgerangel im Spannungsfeld zwischen Nationalstaaten und EU-Legislative. Offenheit wird – verstärkt durch die Unsicherheit eines US-Partners – durch Geheimhaltung, Cyber-Sicherheit, Geheimdienstquellen und militärische Logiken beschnitten.

Vorausschau kann Wahrscheinlichkeiten liefern, jedoch keine exakten Ergebnisse vorhersehen. Als Exempel mag die Covid-19-Pandemie gelten: In diversen Szenarien waren weltumspannende Pandemie-Ereignisse und ihre Folgekosten einkalkuliert, jedoch mangelte es oftmals an einer konkreten Bestimmung von Zeit, Ort, politischen Reaktionen und zu Ende gedachten Maßnahmen.

Kritiker sehen bisher zudem eine unzureichende institutionelle Verankerung in der Entscheidungsstruktur – viele Analysen werden extern vergeben (explodierende Beraterkosten [17] inklusive) und in der Implementierung verschleppt.

Lars Brozus von der Stiftung Wissenschaft und Politik führt zudem an [18], dass oftmals Voraussetzungen für gute Vorausschau nicht gegeben seien: Zukunftsanalysen müssten demnach ohne politische Denkverbote und Tabus vorgenommen werden, was in ihrer praktisch-politischen Einbindung in bestehende politische Netzwerke unmöglich erscheint.

In der Praxis beschäftigt sich die deutsche strategische Vorausschau – neben der Lagebestimmung zu Washington und Peking – vermehrt mit einem möglichen Ausgang des Ukraine-Konfliktes.

Dr. Hans-Georg Ehrhart, Senior Research Fellow [19] am Hamburger Institut für Friedensforschung und Sicherheitspolitik (IFSH), sieht hierbei [20] – mit Stand 2025 – drei mögliche Szenarien als plausibel an. Als hypothetisches Kriegsende werden sowohl ein Sieg Russlands, der Ukraine sowie eine Pattsituation analysiert.

Ehrhart zufolge muss – dies belegt das zentrale Merkmal der strategischen Vorausschau eines Denkens in Variablen und Möglichkeiten – insbesondere das Verhalten Brüssels und Washingtons einkalkuliert werden. Ehrhart sieht Russland als Gewinner im Krieg, sofern ein republikanisch dominierter US-Präsident den materiellen Rückhalt für die Ukraine stark reduziert.

Im strategischen Drei- oder Viereck besäße dies direkte Auswirkungen auf Europa: auch Berlin wäre gezwungen, ihre Rüstungsausgaben massiv in die Höhe zu schrauben.

Ehrhart skizziert zudem die Möglichkeit, dass die Ukraine den Krieg gewinnen könnte: unter der Prämisse eines demokratischen US-Präsidenten, einer ökonomisch wie politisch instabilen Situation Russlands, einer zeitnahen Eu- wie Nato-Aufnahme der Ukraine und einer bis hin zu nuklearen Spannungen eskalierten amerikanisch-russischen Konfrontation wäre jenes Szenario denkbar.

Im dritten Szenario ergäbe sich eine unklare Pattsituation: Weder Russland noch die Ukraine erringen einen eindeutigen Sieg, Kämpfe dauern an, Frontlinien ändern sich kaum.

Interessant ist, dass – obwohl viele Vorzeichen für Szenario I aktuell sprechen – das Ergebnis der Patt-Situation wohl der aktuellen Ergebnis-Lage am nächsten kommt. Dies verweist auf eine grundlegende Schwäche strategischer Vorausschau: Keine – so gut diese auch alle Variablen einberechnet – kann die Zukunft exakt vorherbestimmen.

Selbst unter modernsten Rahmenbedingungen, einem vernetzt-interdisziplinären Ansatz und weitreichenden finanziellen Ressourcen kann sich strategische Vorausschau nur an die Zukunft annähern. Wahrheit bleibt letztlich konkret.

URL dieses Artikels:https://www.heise.de/-11174629

Links in diesem Artikel:[1] https://www.baks.bund.de/de/aktuelles/kompetenzzentrum-strategische-vorausschau[2] https://booksandideas.net/Why-the-Ukraine-War-Caught-Europe-by-Surprise.html[3] https://www.welt.de/politik/ausland/article237161779/BND-Chef-wird-in-der-Ukraine-von-russischem-Angriff-ueberrascht.html[4] https://www.isi.fraunhofer.de/de/competence-center/foresight.html[5] https://www.idw-online.de/de/news801234[6] https://www.foresight-intelligence.de/[7] https://link.springer.com/chapter/10.1007/978-3-658-23975-6_8[8] https://www.oecd.org/strategic-foresight/[9] https://de.wikipedia.org/wiki/Horizont-Scanning[10] https://www.nomos-elibrary.de/10.5771/9783748905639/strategieentwicklung-als-institutionalisierter-prozess[11] https://www.bundeswehr.de/de/organisation/weitere-bmvg-dienststellen/planungsamt-der-bundeswehr[12] https://www.swp-berlin.org/publikation/crisis-early-warning-and-foresight-in-peace-and-security-policy[13] https://www.br.de/nachrichten/deutschland-welt/zwischen-frieden-und-krieg-was-bedeutet-spannungsfall,U7xqKIz[14] https://www.bundesregierung.de/breg-de/aktuelles/nationaler-sicherheitsrat-2331288[15] https://de.wikipedia.org/wiki/Clausewitz_Netzwerk_f%C3%BCr_strategische_Studien[16] https://www.europarl.europa.eu/RegData/etudes/STUD/2023/747454/EPRS_STU(2023)747454_EN.pdf[17] https://www.zeit.de/politik/deutschland/2023-08/verteidigungsministerium-berater-ausgaben-kosten[18] https://www.swp-berlin.org/publikation/strategische-vorausschau-krisen-rechtzeitig-erkennen-um-handeln-zu-koennen[19] https://ifsh.de/personen/dr-hans-georg-ehrhart/[20] https://www.kvak.ee/files/2024/03/ST_23_Hans-Georg-Ehrhart_-GERMANY-AND-EUROPE-AFTER-THE-UKRAINE-WAR-IN-2025-THREE-SCENARIOS.pdf

Copyright © 2026 Heise Medien

US-Präsident Trump hat angekündigt, Akten zu den Themen UAP und Aliens freizugeben

(Bild: KI-Generiert)

Nachdem Barack Obama Aussage über "reale Aliens" für Schlagzeilen gesorgt hatte, kündigt Trump nun an, Regierungsakten zum Thema freigeben zu lassen.

In einer Schnellfragerunde im Podcast des US-Politikkommentators Brian Tyler Cohen [1] hatte Obama auf die Frage, ob Aliens real seien, zunächst geantwortet, Aliens seien "real", befänden sich aber weder in Area 51 (einer Militärbasis in Nevada) in noch in geheimen Untergrundanlagen. Auf die Nachfrage, welche Frage er als Präsident am liebsten beantwortet hätte, entgegnete Obama augenzwinkernd: "Wo sind die Aliens?"

Angesichts der weltweiten Medienreaktionen sah sich Obama jedoch rasch zu einer Klarstellung gezwungen. Am 16. Februar 2026 erklärte er, statistisch sei außerirdisches Leben im Universum zwar plausibel, doch während seiner Präsidentschaft habe er jedoch keinerlei Hinweise auf Besuche nicht-menschlicher Intelligenzen gesehen.

Gestern wurde Trump an Bord der Präsidentenmaschine Air Force One von Reportern auf Obamas Aussagen angesprochen. Auf die Frage nach eigenen Belegen für nicht-menschliche Besucher erklärte Trump ausweichend, Obama habe "da klassifizierte Informationen" preisgegeben, was dieser nicht hätte tun dürfen.

Ob Aliens real seien, ließ Trump auf Nachfrage eines Reporters selbst offen. "Viele Leute reden darüber, viele Leute glauben das." Zugleich deutete er gewohnt gönnerhaft an, er selbst könne Obama durch mögliche Deklassifizierungen dieser Informationen und Akten "eine Menge Ärger ersparen".

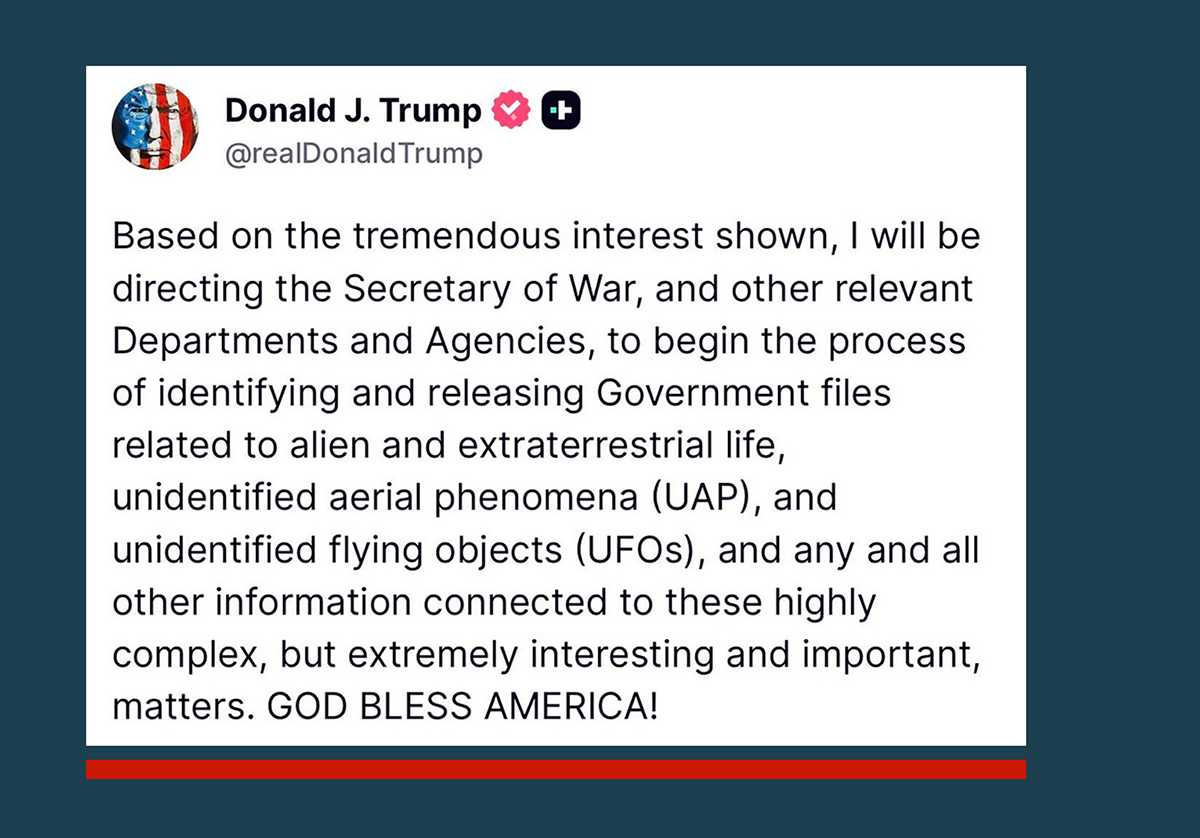

Kurz darauf machte er seine Absicht dann offiziell und kündigte über einen seiner berühmten nächtlichen Posts auf TruthSocial an, Verteidigungsminister Pete Hegseth und weitere zuständige Ministerien und Behörden anzuweisen, sämtliche UFO- und Alien-relevanten Regierungsakten zu identifizieren und freizugeben.

"Aufgrund des enormen gezeigten Interesses werde ich den Kriegsminister und andere zuständige Ministerien und Behörden anweisen, den Prozess zur Identifizierung und Freigabe von Regierungsakten zu außerirdischem und extraterrestrischem Leben, unidentifizierten Phänomenen im Luftraum (UAP) und unidentifizierten Flugobjekten (UFOs) sowie sämtlichen weiteren damit verbundenen Informationen zu beginnen. Gott segne Amerika!" schrieb Trump [2] auf Truth Social.

Ob Trumps Vorstoß praktische Folgen haben wird, bleibt abzuwarten. Einen seiner berühmt-berüchtigten Zeitpläne für das Vorhaben nannte der Präsident diesmal nicht.

Tatsächlich existiert jedoch bereits eine entsprechende gesetzliche Grundlage: Im Rahmen des US-Verteidigungshaushaltsgesetztes (DNAA) wurde noch unter Präsident Joe Biden die Einrichtung einer zentralen UFO-Akten-Sammlung beschlossen.

Diese Unidentified Anomalous Phenomena Records Collection (UAPRC) [3] der National Archives and Records Administration (NARA) soll sämtliche Dokumente zu UAP, Technologien unbekannter Herkunft und möglicher nicht-menschlicher Intelligenz bündeln. Nach dem Vorbild des Archivs zu den Kennedy-Akten gilt grundsätzlich eine 25-Jahres-Frist für die Veröffentlichung – es sei denn, der Präsident macht Sicherheitsbedenken geltend. Die praktische Umsetzung hinkt allerdings hinter den politischen Vorgaben her.

Unabhängig von aktuellen Ankündigungen sind in den USA bereits seit Jahren umfangreiche UFO-Unterlagen einsehbar. Allein die Akten der ersten systematischen Untersuchung von UFO-Phänomenen durch die US Air Force von 1952 bis 1969, Project Blue Book, umfassen mehr als 100.000 digital über die National Archives verfügbare Einträge [4].

Auch das Federal Bureau of Investigation (FBI) [5] und die Central Intelligence Agency (CIA) [6] haben Teile ihrer UFO-Bestände online veröffentlicht. Die politische Dynamik dreht sich daher weniger um das "Ob" von Veröffentlichungen als um Umfang, Tempo und mögliche noch zurückgehaltene Informationen und Kernbestände.

Während deutsche Stellen jahrzehntelang betonten, UFOs spielten behördlich keine Rolle, zeichnen freigegebene Akten ein differenzierteres Bild. Der Autor dokumentierte 2021 in seinem Buch "Deutschlands UFO-Akten", dass auch Bundeswehr, Ministerien und der Bundesnachrichtendienst (BND) Sichtungsmeldungen sammelten und auswerteten.

So enthält die im Bundesarchiv verwahrte BND-Akte "DDR Grenzsperranlagen an der IDG – UFO" (1983–1987) zahlreiche Berichte über unbekannte Flugobjekte im innerdeutschen Grenzgebiet.

Ziel der Untersuchungen war allerdings nicht die Suche nach außerirdischer Technologie, sondern die Aufklärung möglicher Spionageaktivitäten des Warschauer Pakts. Viele Fälle ließen sich entsprechend konventionell erklären; einige wenige blieben ungeklärt.

Trumps Ankündigung reiht sich in eine seit Jahren wachsende politische Aufmerksamkeit für UAP-Themen ein. Neu ist vor allem die Rhetorik – weniger die Substanz. Klar war, dass sich Trump auch diesen Trumpf nicht so ohne weiteres aus der Hand nehmen lassen will – nicht von Obama und noch weniger von seinem verhassten Zwischengänger Biden.

Ob daraus tatsächlich eine offizielle UFO- und Alien-Enthüllung, die sogenannte Disclosure des US-Wissens um UFOs und außerirdische Besucher, oder auch nur zusätzliche Transparenz zum Thema entsteht, wird sich erst zeigen, wenn den Worten konkrete Freigaben folgen.

Bei Trump werden solche Ansagen gerne auch mal vergessen oder verschoben – es kann aber auch unerwartet schnell gehen. Bis dahin bleibt der Vorstoß vor allem eines: ein politisch wirksames Signal in einem Forschungsfeld, das längst nicht mehr ausschließlich im Schatten des Militärs steht und sich auch wissenschaftlich immer mehr etabliert.

URL dieses Artikels:https://www.heise.de/-11184800

Links in diesem Artikel:[1] https://www.youtube.com/channel/UCQANb2YPwAtK-IQJrLaaUFw[2] https://truthsocial.com/@realDonaldTrump/posts/116100300268316472[3] https://www.archives.gov/research/topics/uaps[4] https://catalog.archives.gov/id/597821[5] https://vault.fbi.gov/UFO[6] https://www.cia.gov/stories/story/take-a-peek-into-our-x-files/

Copyright © 2026 Heise Medien

Microsoft richtet seine Gaming-Organisation neu aus: Xbox-Chef Phil Spencer zieht sich im Sommer 2026 aus dem operativen Geschäft zurück und bleibt nur noch übergangsweise als Berater. Gleichzeitig verlässt auch Xbox-Präsidentin Sarah Bond das Tagesgeschäft.

Die Leitung der Sparte übernimmt künftig Asha Sharma aus Microsofts Core-AI-Organisation, während Studios-Chef Matt Booty zum Chief Content Officer aufsteigt und alle Entwicklerstudios bündelt. Grundlage sind interne Mitteilungen, über die unter anderem Game File berichtet .

Spencer habe den Schritt bereits im vergangenen Herbst angekündigt, der Übergang sei "bewusst vorbereitet" worden, erklärt CEO Satya Nadella. Gaming bleibe ein zentraler Bestandteil des Konzerns und erreiche inzwischen "über 500 Millionen monatlich aktive Nutzer".

In einer Mitteilung nennt Spencer selbst seine Zeit an der Spitze "das Privileg meines Lebens" und spricht von einem neuen Abschnitt, für den ein stabiler Übergang wichtig sei.

Inhaltlich passt der Umbruch zur Entwicklung der vergangenen Jahre. Unter Spencer wandelte sich Xbox von einer primär hardwaregetriebenen Marke zu einer plattformübergreifenden Infrastruktur.

Dazu gehören PC-Versionen parallel zur Konsole, Cloud-Streaming, das Spieleabo Game-Pass-Abo und die milliardenschwere Übernahme von Activision Blizzard. Klassische Konsolenverkäufe verloren relativ an Bedeutung gegenüber Nutzerzahlen und Diensten.

Dass mit Sharma nun eine Managerin aus dem KI- und Plattformgeschäft übernimmt und gleichzeitig Bond ausscheidet, gilt als Signal für die nächste Phase. Microsoft versteht Xbox offenbar zunehmend als Dienst und Ökosystem statt als einzelne Gerätekategorie. Hardware bleibt Teil des Angebots, steht aber weniger im Mittelpunkt als Entwickler-Tools, Cloud und geräteübergreifender Zugriff.

Der Verbraucherzentrale Bundesverband (VZBV) hat eine Sammelklage gegen 1N Telecom eingereicht. Über 15.000 Beschwerden seien von Januar 2023 bis Juni 2025 zu dem Unternehmen eingegangen, erklärte der VZBV am 20. Februar 2026. Mit der Klage sollen Betroffene Geld zurückerhalten, das das Unternehmen wohl unberechtigt gefordert habe.

"Wir gehen wegen tausender Beschwerden gegen 1N Telecom vor. Häufig sind ältere Menschen betroffen. 1N Telecom fordert von Betroffenen jeweils fast 420 Euro. Das halten wir für vollkommen unberechtigt" , sagte Ramona Pop, Vorständin des Verbraucherzentrale Bundesverbands.

Wie der Anwalt von 1N Telecom mitteilte, verschickte das Düsseldorfer Unternehmen 1N Telecom seit April 2023 eine Million Werbebriefe. Die Kundendaten entnahm man laut eigenem Bekunden dem Telefonbuch.

1N Telecom schrieb Haushalte mit dem Angebot für einen 24-Monats-Vertrag für Festnetz und DSL an. Auch wenn sich das Logo in Farbe und Design auf dem Werbeschreiben unterscheidet, wurde 1N Telecom von vielen mit der Deutschen Telekom verwechselt. Das Schreiben enthält auch die aktuelle Festnetzrufnummer des angeschriebenen Haushalts.

Viele Betroffene bemerkten erst nach Ablauf der 14-tägigen Widerrufsfrist, dass sie einen Vertrag mit einem anderen Anbieter abgeschlossen hatten. Sobald sie dann die Portierung ihrer Telefonnummer verhinderten, kündigte 1N Telecom den Vertrag, forderte jeweils einen Betrag von fast 420 Euro und ließ das Geld per Inkasso-Forderung von TPI-Investment eintreiben. Nicht selten wurde die Forderung bezahlt.

Günstige Monitore werden immer besser. Während früher für farbgenaue IPS-Panels oder dreistellige Bildwiederholraten ordentlich draufgezahlt werden musste, bekommt man diese und weitere Features mittlerweile für unter 100 Euro, etwa beim Lenovo L27-41 Monitor. Der Monitor ist im Amazon-Angebot derzeit für unter 89 Euro erhältlich. Der Deal gilt für einen begrenzten Vorrat, der bereits fast zur Hälfte vergriffen ist. Deswegen, und weil die Nachfrage laut Amazon überdurchschnittlich hoch ist, empfehlen wir, schnell zu bestellen.

Der Lenovo L27-41 ist mit einem 27 Zoll großen IPS-Panel ausgestattet. Der Monitor stellt Inhalte mit Full-HD-Auflösung und einer Bildwiederholrate von bis zu 100 Hz dar. Entsprechend eignet er sich nicht nur als Office-Monitor, sondern ist auch eine preiswerte Option für Vielspieler. Verglichen mit dedizierten Gaming-Monitoren sind 4ms Reaktionszeit eher auf der höheren Seite, weshalb sich der Bildschirm eher für Einzelspielertitel als für schnelle Multiplayer-Games eignet. Aufgrund einer matten Bildschirmoberfläche werden Spiegelungen und Reflexionen auf ein Minimum reduziert.

PCs oder Konsolen können entweder via HDMI- oder VGA-Port mit dem Lenovo L27-41 verbunden werden. Zugegeben, VGA ist mittlerweile veraltet, der Anschluss hat aber einen entscheidenden Vorteil: Der Bildschirm ist auch mit alten Tower-PCs oder Laptops kompatibel. Wichtig: Die volle Bildwiederholrate erreicht der Monitor nur via HDMI-Verbindung und mit einem HDMI-1.4-Kabel oder höher. Neben den Anschlüssen gibt es auf der Rückseite eine 100 x 100 mm VESA-Halterung, um den Monitor an einem Arm zu montieren. Auf dem mitgelieferten Standfuß montiert, kann der Bildschirm für einen bequemen Blickwinkel nach vorn und hinten geneigt werden.

Amazon verkauft den Lenovo L27-41 mit 25 Prozent Rabatt. Im befristeten Angebot kostet dieser 88,99 Euro statt der unverbindlichen Preisempfehlung von 111,99 Euro. Mehr reduzierte Technik von Lenovo gibt es auf der Amazon-Seite des Herstellers, darunter sind weitere Monitore, Tablets, Laptops oder Gaming-PCs. Stöbern lohnt sich.

Dieser Artikel enthält sogenannte Affiliate-Links. Bei einem Kauf der Produkte über diese Links erhält Golem eine kleine Provision. Das ändert nichts am Preis der Artikel.

Alle Details zur Störungsmeldung ansehen Eigene Internetstörung melden

Die OAZ will eine 36 Jahre alte Lücke schließen. Das verdient Aufmerksamkeit – und eine ehrliche Bewertung. Ein Leitartikel.

Es passiert selten, dass im schrumpfenden deutschen Zeitungsmarkt etwas Neues entsteht. Doch ab diesem Freitag liegt die Ostdeutsche Allgemeine Zeitung am Kiosk. Ein Blatt, das etwas wagt, was fast schon verrückt klingt: eine Neugründung.

Und nicht irgendeine. Diese Zeitung will eine Lücke schließen, die seit 36 Jahren besteht und kaum zu übersehen ist. Das verdient Aufmerksamkeit – auch unsere.

Denn machen wir uns nichts vor: Deutschland hat ein Ostproblem. Nicht weil der Osten ein Problem wäre. Sondern weil dieser Teil des Landes medial seit Jahrzehnten entweder erklärt, problematisiert oder schlicht ignoriert wird.

Über den Osten reden viele. Aus dem Osten heraus berichten nur wenige. Und fast niemand tut das auf überregionaler Ebene mit eigenem Selbstbewusstsein. Genau hier setzt die OAZ an.

Hinter dem Projekt steht Verleger Holger Friedrich. Er führt bereits den Berliner Verlag mit der Berliner Zeitung. Als Chefredakteur gewann er Dorian Baganz vom Wochenblatt Der Freitag. Die Organisation steuert Geschäftsführer Dirk Jehmlich.

Die Struktur allein macht neugierig: Statt alle Redakteure in einem Großraumbüro zu versammeln, verteilt die OAZ ihre Ressorts über mehrere Städte. Dresden bekommt das Wirtschaftsressort, Weimar die Kultur, Magdeburg die Politik. Rund 25 Journalisten arbeiten derzeit am Projekt. Langfristig sollen es 50 werden.

Baganz bringt die Grundidee auf den Punkt: Es fehle nicht an Lokaljournalismus im Osten. Was fehle, seien überregionale Geschichten aus ostdeutscher Perspektive. Dem gesamtdeutschen Diskurs wolle man eine "vierte Himmelsrichtung" zurückgeben. Die Redaktion folgt dem Leitsatz "Wir beschreiben, Sie bewerten" – und stellt Einordnung über Meinung.

Das trifft einen Nerv. Einen empfindlichen. 35 Jahre nach der Wiedervereinigung fühlen sich Millionen Ostdeutsche in der medialen Öffentlichkeit entweder übersehen oder auf Klischees reduziert.

Friedrich selbst spricht [1] von mangelndem Respekt gegenüber ostdeutschen Biografien. Er wirft westdeutschen Verlagen vor, nach 1990 massiv Vertrauen verspielt zu haben.

Man muss nicht jede seiner Einschätzungen teilen. Aber eines lässt sich kaum bestreiten: Die Diagnose einer Repräsentationslücke stimmt. Und sie schmerzt.

Wir bei Telepolis verfolgen dieses Projekt mit echtem Interesse. Mehr Stimmen, mehr Perspektiven, mehr publizistischer Wettbewerb – das belebt den Diskurs. Davon profitieren am Ende alle. Auch wir als Konkurrenz.

Eine Zeitung, die ostdeutschen Erfahrungen eine gleichberechtigte Plattform gibt, kann den deutschen Medienbetrieb bereichern.

Denn noch immer wird vergessen: Ostdeutsche bringen eigene Erfahrungen mit. Es sind nicht nur die 40 Jahre, in denen sie einen weitgehend eigenständigen Weg in Literatur, Philosophie, Kunst und Kultur gegangen sind. Als sie mit der Wende 1989/90 die Geschicke in ihre eigenen Hände nahmen und das SED-System abwickelten, lernten sie auch auf brutale Weise, was gesellschaftliche Brüche bedeuten.

Aus all diesen Gründen haben sie mehr verdient als folkloristische Rückblicke oder herablassende Zustandsbeschreibungen aus westdeutschen Redaktionsstuben.

Aber – und dieses Aber gehört zur Ehrlichkeit dazu – wir werden das Projekt auch kritisch begleiten. Denn die entscheidende Frage lautet: Gelingt es der OAZ, ostdeutsche Perspektiven nach vorn zu richten? In die Zukunft hinein? Oder rutscht sie ab in Nostalgie und Jammerei?

Die Versuchung ist groß, sich im berechtigten Zorn über die Nachwendezeit einzurichten und daraus eine publizistische Endlosschleife zu drehen. Das wäre fatal.

Denn das Ostdeutschland von heute ist ein anderes als das von 1990. Die jüngeren Generationen sind mit einer anderen Lebenswirklichkeit aufgewachsen als die Wendegeneration. Ostdeutschland hat weit mehr zu erzählen als Geschichten der Kränkung. Es trägt Erfahrungswissen in sich, das für die Zukunft des ganzen Landes enorm wertvoll sein könnte – wenn jemand es richtig hebt.

Wir holen uns die aktuelle Ausgabe. Wir lesen sie gründlich. Und wir werden die Ostdeutsche Allgemeine zu einem späteren Zeitpunkt ausführlich besprechen.

Dabei interessiert uns vor allem: Hält die Redaktion ihren eigenen Anspruch durch? Bleibt sie beim Beschreiben, oder kippt sie doch ins Belehren? Findet sie den Ton, der ostdeutsche Lebenswirklichkeit ernst nimmt, ohne den Rest der Republik vor die Tür zu setzen?

Der deutsche Medienmarkt schrumpft seit Jahren. Dass jemand in diesem Umfeld eine neue Zeitung gründet, zeugt von Wagemut. Vielleicht auch von einer Prise Größenwahn. Wahrscheinlich von beidem. Gut so. Denn genau diese Mischung braucht es, um etwas zu bewegen.

Die OAZ verdient eine faire Chance – und eine schonungslos ehrliche Bewertung. Beides werden wir liefern.

URL dieses Artikels:https://www.heise.de/-11184556

Links in diesem Artikel:[1] https://www.welt.de/debatte/plus6998056cbbc0d13fd82fe818/ostdeutscghe-die-fuck-you-geste-des-verlegers-holger-friedrich.html

Copyright © 2026 Heise Medien

Mit freedom.gov will Washington Netzsperren umgehen. Kritiker sprechen von einem Angriff auf europäisches Recht und die Medienordnung.

Die Trump-Regierung verfolgt, wie mehrere Medien, darunter die Nachrichtenagentur Reuters [1], in den vergangenen Tagen berichteten, mit der Webseite freedom.gov [2] die Absicht, Europäern Zugang zu Inhalten zu verschaffen, die in europäischen Ländern nicht zugänglich sind, weil sie dort als Hassrede oder terroristische Propaganda eingestuft [3] werden.

Seit der Rede von J. D. Vance auf der Münchner Sicherheitskonferenz 2025, in der er Europas Medienpolitik scharf kritisierte, überrascht dieser Schritt kaum.

Offen ist allerdings noch, ob es sich um mehr handelt als um einen symbolischen Fingerzeig. Ob auf freedom.gov [4] tatsächlich ein Online-Angebot entsteht, das den Vorwürfen der derzeitigen US-Regierung gegen europäische Regierungen demonstrativ ein digitales Gegenmodell entgegensetzt. Bislang ist auf der Webseite selbst nichts dergleichen zu finden.

"Während das EU-Gesetz über digitale Dienste (Digital Services Act, DSA) vorschreibt, dass Plattformen illegale Inhalte und Desinformation entfernen müssen, betrachtet die Trump-Regierung diese Vorschriften als Zensur, die sich gegen amerikanische Stimmen richtet", beschreibt Techradar [5] das politische Spannungsfeld.

Ein spezielles politisches Moment ergibt sich aus dem Eindruck, dass die Trump-Regierung mit ihrem Projekt ein besonderes Augenmerk auf Deutschland legt.

Nach Informationen von Reuters, die sich auf drei anonyme Quellen stützt, die mit der Sache vertraut sein sollen, arbeitet das US-Außenministerium an dem Portal, das Menschen in Europa und anderswo ermöglichen soll, staatliche Netzsperren zu umgehen. Laut Guardian [6] ist auch eine andere US-Behörde maßgeblich beteiligt: Die Domain soll demnach von der Cybersecurity and Infrastructure Security Agency (CISA) verwaltet werden, einer Abteilung des Ministeriums für Innere Sicherheit (DHS). Das DHS ist auch für die Einwanderungs- und Zollbehörde (ICE) zuständig.

"Über die Webseite sollen die Nutzer den Angaben zufolge mittels einer VPN-Funktion ihre Herkunft verschleiern und so surfen können, als befänden sie sich in den USA", heißt es in der FAZ [7].

Geleitet wird das Projekt offenbar von Sarah Rogers, der Unterstaatssekretärin für öffentliche Diplomatie. Innerhalb des Ministeriums gebe es laut der Nachrichtenagentur rechtliche Vorbehalte. Ein Sprecher des Außenministeriums [8] erklärte allerdings, es gebe kein speziell auf Europa ausgerichtetes Programm zur Umgehung von Zensur.

Zugleich betonte er: "Digitale Freiheit hat für das Außenministerium Priorität, und dazu gehört auch die Verbreitung von Technologien zum Schutz der Privatsphäre und zur Umgehung von Zensur wie VPNs."

Das Vorhaben macht die unterschiedlichen Auffassungen von Meinungsfreiheit deutlich. Während die US-Verfassung Äußerungen nahezu schrankenlos schützt, greifen europäische Gesetze strenger gegen Hetze und extremistische Inhalte durch.

Die Trump-Regierung sieht darin eine Unterdrückung konservativer Stimmen und kritisiert Regelwerke wie den Digital Services Act. Deutschland erließ 2024 laut Reuters 482 Anordnungen zur Löschung terroristischer Inhalte; insgesamt mussten 16.771 Beiträge entfernt werden.

Politisch wäre ein funktionsfähiges freedom.gov brisant. Sollten Inhalte, die in Deutschland nur über Umgehungstechniken erreichbar sind, über eine US-Regierungswebseite frei zugänglich werden, stünde die europäische Medienpolitik vor einem Dilemma. Die Sperrung einer offiziellen US-Regierungsseite wäre ein heikles Novum.

Hinzu kommen Hinweise auf einen Deutschland-Fokus: Der Platzhaltertext auf freedom.gov soll laut Die Welt [9] unabhängig vom Standort auf Deutsch erscheinen. Die Domain wurde im Januar registriert; verwaltet wird sie laut Guardian [10] von einer US-Sicherheitsbehörde.

Kritiker sehen darin eine Politisierung früherer Programme zur Internetfreiheit. Statt offener, dezentraler Projekte werde der Datenverkehr nun über eine US-Behörde gebündelt. Nina Jankowicz warnte im Guardian, das Portal könne faktisch den Zugang zu Hassrede, Pornografie und Missbrauchsdarstellungen erleichtern.

URL dieses Artikels:https://www.heise.de/-11184490

Links in diesem Artikel:[1] https://www.reuters.com/world/us-plans-online-portal-bypass-content-bans-europe-elsewhere-2026-02-18/[2] https://freedom.gov/[3] https://www.faz.net/aktuell/feuilleton/medien-und-film/medienpolitik/bericht-usa-wollen-mit-portal-eu-gesetze-umgehen-110840058.html[4] https://freedom.gov/[5] https://www.techradar.com/vpn/vpn-privacy-security/the-trump-administration-is-building-a-website-to-help-europeans-evade-content-bans[6] https://www.theguardian.com/technology/2026/feb/19/us-builds-website-that-will-allow-europeans-to-view-blocked-content[7] https://www.faz.net/aktuell/feuilleton/medien-und-film/medienpolitik/bericht-usa-wollen-mit-portal-eu-gesetze-umgehen-110840058.html[8] https://www.reuters.com/world/us-plans-online-portal-bypass-content-bans-europe-elsewhere-2026-02-18/[9] https://www.welt.de/debatte/plus6996c5e485232894521349d8/freiheits-portal-wie-die-usa-die-meinungsfreiheit-in-europa-retten-wollen.html[10] https://www.theguardian.com/technology/2026/feb/19/us-builds-website-that-will-allow-europeans-to-view-blocked-content

Copyright © 2026 Heise Medien

Die US-Raumfahrtbehörde klassifiziert den fehlgeschlagenen Testflug 2024 als "Type A"-Zwischenfall – die höchste Gefahrenstufe. Scharfe Kritik an Boeing.

Die Nasa hat den gescheiterten bemannten Testflug des Boeing-Raumschiffs Starliner im Jahr 2024 offiziell als "Typ A"-Zwischenfall eingestuft. Diese Klassifizierung ist die schwerste Kategorie der Raumfahrtbehörde und wird nur bei Vorfällen vergeben, die Schäden von mehr als zwei Millionen US-Dollar verursachen, zum Verlust oder Kontrollverlust eines Fahrzeugs führen oder Todesopfer fordern.

Die Einstufung stellt den Starliner-Vorfall auf dieselbe Stufe wie die tödlichen Space-Shuttle-Katastrophen der Columbia 2003 und der Challenger 1986.

"Obwohl es keine Verletzten gab und die Mission vor dem Andocken wieder unter Kontrolle gebracht wurde, erkennt diese Einstufung an, dass das Potenzial für einen schweren Zwischenfall bestand", erklärte die Nasa in einer Stellungnahme [1].

Der Vorfall hatte im Sommer 2024 weltweite Aufmerksamkeit erregt, nachdem die Testpiloten Suni Williams und Butch Wilmore mehr als neun Monate im Weltraum festsaßen, bevor sie im März 2025 zur Erde zurückkehrten.

Was als acht- bis vierzehntägige Mission geplant war, wurde zu einer monatelangen Odyssee. Beide Piloten sind inzwischen aus dem Dienst bei der Nasa ausgeschieden.

Am Donnerstag übte Nasa-Administrator Jared Isaacman scharfe Kritik an Boeing, dem Hersteller des Raumschiffs, und an der eigenen Behörde. "Während Boeing die Starliner gebaut hat, hat die Nasa sie akzeptiert und zwei Astronauten ins All geschickt", sagte [2] Isaacman.

"Wir korrigieren diese Fehler. Heute erklären wir formell einen Typ-A-Zwischenfall und stellen sicher, dass Führungsverantwortung übernommen wird, damit solche Situationen nie wieder vorkommen."

Die Mission war Anfang Juni 2024 mit einer Atlas-V-Rakete gestartet. Während des mehr als eintägigen Fluges zur Internationalen Raumstation traten Heliumlecks im Antriebssystem auf, gefolgt von intermittierenden Triebwerksausfällen. Trotz dieser Probleme erklärte Boeing nach dem erfolgreichen Andocken zunächst die Mission für erfolgreich.

"Wir haben viel erreicht, und wirklich mehr als erwartet", sagte Mark Nappi, Vizepräsident und Manager von Boeings Commercial Crew Program, bei einer Pressekonferenz nach dem Andockmaneuver.

Erst Monate später wurde das wahre Ausmaß der Gefahr bekannt. In einem Interview beschrieb Wilmore die angespannten Minuten, als er die Kontrolle über Starliner übernehmen musste, während die Triebwerke eines nach dem anderen ausfielen. "Ich weiß nicht, ob wir zu diesem Zeitpunkt zur Erde zurückkehren können", habe er sich gefragt. "Ich weiß nicht, ob wir das können. Und tatsächlich denke ich, dass wir es wahrscheinlich nicht können."

Der Pilot musste abwägen, ob es riskanter war, sich der Raumstation zu nähern oder zu versuchen, zur Erde zurückzufliegen. Letztlich entschied sich die Nasa am 24. August 2024, Wilmore und Williams nicht mit Starliner zurückzubringen. Stattdessen kehrten die beiden im März 2025 als Teil der Crew-9-Mission mit einem Crew-Dragon-Raumschiff von SpaceX zur Erde zurück.

Die Nasa veröffentlichte am Donnerstag einen 311 Seiten umfassenden internen Untersuchungsbericht [3]. Darin werden Hardwaredefekte, Führungsfehler und kulturelle Probleme bei den beteiligten Organisationen aufgeführt, die zu Bedingungen führten, die den Sicherheitsstandards der Raumfahrtbehörde nicht genügten.

"Starliner hat Design- und Entwicklungsmängel, die korrigiert werden müssen, aber der beunruhigendste Fehler, den diese Untersuchung aufgedeckt hat, ist nicht die Hardware", schrieb Isaacman in einem Brief an die Nasa-Belegschaft. "Es ist die Entscheidungsfindung und Führung, die, wenn sie nicht kontrolliert wird, eine Kultur schaffen könnte, die mit der bemannten Raumfahrt unvereinbar ist."

Der Bericht zeigt, dass einige der größten Fehleinschätzungen der Nasa bereits vor dem bemannten Testflug auftraten. Besonders kritisch wird der zweite Orbitalflugtest von Starliner im Mai 2022 bewertet. Während dieses als erfolgreich deklarierten Fluges fielen drei der Triebwerke des Starliner-Servicemoduls aus.

"Die Untersuchungen hörten oft bei der unmittelbaren Ursache auf, behandelten sie mit einer Lösung oder akzeptierten das Problem als unerklärte Anomalie", erklärte Isaacman. "In einigen Fällen war die Diagnose der unmittelbaren Ursache selbst falsch, weil es an ausreichender Sorgfalt fehlte, den Daten bis zu ihrer logischen Schlussfolgerung zu folgen."

Isaacman kündigte an, dass es "Führungsverantwortung" für die Entscheidungen rund um das Starliner-Programm geben werde, nannte aber keine konkreten Maßnahmen.

Nasa und Boeing haben vereinbart, dass der nächste Flug von Starliner zur Internationalen Raumstation ohne Besatzung stattfinden soll. Die Nasa hatte zuvor erklärt, dieser Flug könne bereits im April 2026 stattfinden.

Auf die Frage nach diesem Zeitplan betonte Isaacman jedoch, dass noch viel Arbeit zu leisten sei. "Wir sind verpflichtet, Boeing bei der Bewältigung dieses Problems zu helfen, die technischen Herausforderungen zu beheben, das mit diesem Fahrzeug verbundene Risiko vollständig zu verstehen und es so weit wie möglich zu minimieren", sagte er. "Und wenn wir viele der Empfehlungen des Berichts umsetzen können, dann werden wir wieder fliegen."

Boeing erklärte am Donnerstag in einer Stellungnahme, das Unternehmen sei "verpflichtet", einer von zwei kommerziellen Crew-Anbietern der Nasa zu sein.

Nach Informationen [4] der Fachpublikation Ars Technica haben zwei Nasa-Astronauten, Woody Hoburg und Jessica Wittner, bereits mit dem Training für eine mögliche "Starliner-2"-Mission begonnen, die in der ersten Jahreshälfte 2027 starten könnte, sollte der unbemannte Testflug 2026 erfolgreich verlaufen. Die Nasa hat bisher keine Astronautenzuweisungen für Starliner-1 bestätigt.

URL dieses Artikels:https://www.heise.de/-11184108

Links in diesem Artikel:[1] https://www.nasa.gov/news-release/nasa-releases-report-on-starliner-crewed-flight-test-investigation/[2] https://www.bbc.com/news/articles/cm2x3nlxg9jo[3] https://www.nasa.gov/wp-content/uploads/2026/02/nasa-report-with-redactions-021926.pdf?emrc=76e561[4] https://arstechnica.com/space/2026/02/nasa-chief-classifies-starliner-flight-as-type-a-mishap-says-agency-made-mistakes/

Copyright © 2026 Heise Medien

Jon Prosser in dem beanstandeten Video (Bildschirmfoto), in dem er das Liquid-Glass-Design vorab publik machte.

(Bild: YouTube/fpt/heise medien)

Nach Apples Klage gegen YouTuber Jon Prosser und Michael R. zeigen sich beide kooperativ. Es geht um gestohlene Geschäftsgeheimnisse.

Nach der Klage Apples gegen den bekannten YouTuber Jon Prosser zeigen sich inzwischen beide Beklagten kooperativ. Dies teilten Apples Anwälte [1] zusammen mit dem Anwalt des Mitangeklagten Michael R. an das zuständige Gericht in San Francisco mit. Prosser und R. wird von Apple vorgeworfen, sich illegal Zugang zum iPhone eines früheren Apple-Angestellten verschafft und Geschäftsgeheimnisse gestohlen zu haben [2]. Aktuell geht es darum, erst einmal das Ausmaß festzustellen (Case: 3:25-cv-06043).

Prosser hatte sich Anfang 2025 in einem Video damit hervorgetan, dass er Kenntnis über die Designveränderungen in iOS 26 erlangt habe, das damals noch als iOS 19 erwartet wurde. In Renderings gab Prosser Einblicke in das Liquid-Glass-Design, die erstaunlich nah an das heranreichten, was Apple im Juni auf seiner Entwicklerkonferenz WWDC präsentierte.

Möglich wurde dies laut Klage, weil sich der Mitangeklagte R. Zugriff auf ein Firmengerät Apples verschafft. Durch seine Freundschaft mit dem früheren Apple-Entwickler Ethan L. habe R. die Gelegenheit gehabt, in dessen Abwesenheit auf das Gerät zugreifen zu können. Zuvor soll er sich Kenntnis über den dafür nötigen Passcode verschafft haben. In einem FaceTime-Anruf habe R. daraufhin Prosser die damalige Testversion von iOS gezeigt. Dieser habe die Erkenntnisse später in Renderings nachgebaut, um sie in seinen Videos zu zeigen.

Während sich R. gleich kooperativ zeigte, reagierte Prosser zunächst nicht auf die Klage. Er bestreitet dies zwar, doch das Gericht erwirkte am 17. Oktober 2025 ein Versäumnisurteil gegen ihn. Inzwischen habe sich das aber geändert, teilten Apples Anwälte dem Gericht jetzt mit. Man befinde sich in Terminabsprachen mit Prosser. Es geht unter anderem um eine Befragung des Angeklagten. Im Falle von R. ließ sich Apple auch Geräte aushändigen, um diese forensisch untersuchen zu lassen. Apple will durch die Befragungen Kenntnis darüber erlangen, wie weit vertrauliche Informationen gestreut wurden.

Für den 13. April 2026 wurde dem Gericht eine weitere Mitteilung über den Fortgang in Aussicht gestellt. Prosser hat sich indessen nicht von dem laufenden Verfahren gegen ihn beeindrucken lassen und veröffentlicht weiterhin Videos, in denen er behauptet, künftige Geräte und Funktionen zu zeigen. Zwischenzeitlich erklärte er, dass die Geschehnisse nicht so gelaufen seien, wie sie von Apple in der Klage dargestellt werden.

Für den betroffenen Apple-Mitarbeiter endete die Angelegenheit bereits mit seiner Kündigung. Apple wirft ihm vor, sein Gerät nicht hinreichend vor fremdem Zugriff geschützt zu haben. Zudem habe er sich zu spät als Besitzer des Apartments zu erkennen gegeben, als eine Aufnahme des FaceTime-Anrufs Prossers publik wurde. Apple soll über eine anonyme E-Mail Kenntnis über den Hergang erhalten haben.

URL dieses Artikels:

https://www.heise.de/-11184784

Links in diesem Artikel:

[1] https://storage.courtlistener.com/recap/gov.uscourts.cand.452973/gov.uscourts.cand.452973.27.0.pdf

[2] https://www.heise.de/news/Illegaler-Zugriff-auf-Mitarbeiter-iPhone-Apple-verklagt-Leaker-10492151.html

[3] https://www.heise.de/mac-and-i

[4] mailto:mki@heise.de

Copyright © 2026 Heise Medien

(Bild: Sebastian Trepesch / heise medien)

Kein Empfang mehr – und eine Info in Apples Diagnosemenü: Vereinzelt treten Probleme mit Apples neuem Modemchip auf.

Nach Berichten über Probleme mit Apple-Modemchips im Netz der Deutschen Telekom [1] gibt es nun vereinzelt Hinweise über Störungen beim C1X aus dem iPhone Air [2]. Wie verbreitet diese sind, bleibt unklar – dennoch sorgten entsprechende Postings auf Reddit [3] am Donnerstag für Schlagzeilen in US-Techblogs [4].

Das iPhone Air enthält den neuesten Modemchip von Apple, die Weiterentwicklung des C1 aus dem iPhone 16e [5]. Der C1X bietet laut Apple einen doppelt so schnellen 5G-Durchsatz bei passender Gegenstelle. Der Modemchip steckt auch im iPad Pro M5 [6]. Ein betroffener Reddit-User meldet, sein C1X sei „plötzlich verstorben“. Als er am Morgen aufgewacht sei, habe es keinen Mobilfunkempfang gegeben. Dann prüfte er die Netzwerkeinstellungen. Dort fand sich dann ein Diagnosebericht. Darin heißt es, das iPhone habe ein Problem erkannt, „das Ihren mobilen Empfang beeinträchtigen“ könne. Als weiteren Schritt solle man die Apple-Support-App [7] zur weiteren Fehlerüberprüfung nutzen.

Ein weiterer User im selben Thread meldet ähnliche Probleme samt der gleichen Diagnosemeldung. Allerdings soll sich der Modemchip später wieder berappelt haben. Beim iPhone 17, 17 Pro und 17 Pro Max verbaut Apple nach wie vor Qualcomm-Mobilfunktechnik. Beim iPhone Air, das weltweit über keinen physischen SIM-Kartenslot mehr [8] verfügt, baute Apple das C1X ein. Das Debütmodell mit einem Apple-Mobilfunkchip war das iPhone 16e. Auch beim demnächst erwarteten Nachfolger iPhone 17e [9] dürfte ein Apple-C-Chip verbaut sein.

Von dem Modemfehler betroffene Nutzer sollten – nach einer Durchführung der Diagnose in der Apple-Support-App – am besten gleich den Apple-Support kontaktieren. Die Geräte befinden sich allesamt noch in der Gewährleistungsphase, Apple muss also tauschen oder reparieren. Der Konzern hatte viele Jahre an einem eigenen Modemchip gearbeitet, nachdem in München der alte Intel-Mobilfunk-Standort übernommen [10] worden war. Die Technik gilt als äußerst komplex. Eigene 5G-Chips sollen Apple von Lieferanten unabhängig machen. Der Traum ist zudem, 5G, WLAN und Bluetooth in einem Chip zu integrieren und so etwa MacBooks endlich 5G-Empfang [11] zu verschaffen.

Zuletzt hatten Nutzer bestimmter iPhones und Apple-Watch-Modelle über Empfangsschwierigkeiten im Netz der Deutschen Telekom geklagt. Grund waren laut dem Carrier interne Anpassungen an der 5G-Infrastruktur, die unter anderem Red Cap (Apple Watch) und 5G+-Gaming in Mitleidenschaft zogen, dabei aber gleichzeitig den gesamten Empfang stören konnten. Die Telekom behauptete allerdings, dass das Problem mit allen dazu kompatiblen Modellen auftrat, nicht nur mit Apple-Modemchips.

URL dieses Artikels:

https://www.heise.de/-11184194

Links in diesem Artikel:

[1] https://www.heise.de/news/Apple-Mobilfunkchips-Berichte-ueber-Aerger-mit-5G-Gaming-der-Telekom-11172226.html

[2] https://www.heise.de/news/Luftig-Apple-schickt-duennes-iPhone-Air-ins-Rennen-10638523.html

[3] https://www.reddit.com/r/iphone/comments/1r8bmth/so_the_iphone_air_c1x_modem_died_suddenly/

[4] https://wccftech.com/iphone-air-c1x-5g-modem-failure-spotted-online/

[5] https://www.heise.de/tests/iPhone-16e-im-Test-Mehr-iPhone-fuer-Einsteiger-10303222.html

[6] https://www.heise.de/tests/Flach-und-flott-Das-neue-iPad-Pro-M5-im-Test-10792884.html

[7] https://apps.apple.com/de/app/apple-support/id1130498044

[8] https://www.heise.de/news/Nur-mit-eSIM-iPhone-Air-treibt-europaeische-Mobilfunker-um-10688492.html

[9] https://www.heise.de/news/Apple-Event-Gibt-es-wieder-Produkte-ueber-mehrere-Tage-11180953.html

[10] https://www.heise.de/news/Apple-5G-Modem-C1-Monumentale-technische-Errungenschaft-10288653.html

[11] https://www.heise.de/news/Codefund-MacBook-Pro-kuenftig-mit-Mobilfunkchip-10538318.html

[12] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[13] https://www.heise.de/mac-and-i

[14] mailto:bsc@heise.de

Copyright © 2026 Heise Medien

iCloud-Logo: Apple wollte einst iPhones auf CSAM scannen, nahm nach Bürgerrechtlerprotesten davon aber Abstand.

(Bild: Apple)

Die Staatsanwaltschaft von West Virginia will, dass Apple iCloud-Material stärker auf sogenanntes CSAM scannt. Nun kommt es zur Klage.

Der Druck auf Apple, iPhones und die iCloud auf Kindesmissbrauchsmaterial zu scannen, wächst. Nun hat der US-Bundesstaat West Virginia das Unternehmen verklagt, weil es angeblich unterlässt, CSAM-Inhalte – das steht für „Child Sexual Abuse Material“ – in ausreichender Anzahl zu melden. Apple tue „seit Jahren nichts dagegen“, so der Justizminister (Attorney General) JB McCuskey. In der Klage [1] heißt es, CSAM werde in Apples Ökosystem „geschützt“. McCuskey sagte in einer Stellungnahme, Apples „Schutz der Privatsphäre für Kinderschänder“ sei „absolut unverzeihlich“. Der Konzern verweigere das moralisch richtige Vorgehen und lasse es zu, dass durch die Speicherung und Verteilung dieses Materials Opfer retraumatisiert würden.

Die Klage führt unter anderem interne E-Mails von Apple auf, in denen Mitarbeiter schreiben, iCloud sei „die größte Plattform für die Verteilung von Kinderpornografie“. Aufgeführt wird zudem die Tatsache, dass Apple deutlich weniger Meldungen gegenüber den CSAM-Meldestellen in den USA macht als etwa Meta. Allerdings handelt es sich dabei um offene soziale Medien, während iCloud Privatinhalte vorhält.

2021 hatte Apple versucht, neue Schutzmaßnahmen gegen CSAM umzusetzen. Damals war geplant worden, Fotos direkt auf dem iPhone auf solches Material zu scannen. Der Konzern hatte ein seiner Ansicht nach datenschutzfreundliches Modell entwickelt, doch es gab massive Proteste von Bürgerrechtlern und Datenschutzaktivisten [2]. Daraufhin kam es zu einem Rollback. McCuskey will nun, dass eine solche Funktion wieder eingeführt wird.

Die Klage in West Virginia ist nicht das einzige Vorgehen gegen Apple auf diesem Gebiet. So läuft seit 2024 eine US-Sammelklage gegen Apple, die dem Konzern Untätigkeit gegen CSAM vorwirft [3]. Druck gibt es auch in der Europäischen Union. Hier war versucht worden, die sogenannte Chatkontrolle zu implementieren, bei der in WhatsApp, iMessage und Co. vorab Inhalte vor dem Versand auf CSAM geprüft werden sollten. Auch hier gab es Proteste, da es jederzeit möglich wäre, auch auf anderes Material zu prüfen und Nutzer ihre Privatsphäre beeinträchtigt sahen.

Das Thema ist allerdings noch immer nicht vom Tisch [4]. Apple hat sich zur Klage in West Virginia, bei der hohe Strafzahlungen drohen könnten, bislang nicht geäußert. McCuskey argumentiert unter anderem, dass Apple eben kein „unwissender, passiver Weitergeber” von CSAM sei.

URL dieses Artikels:

https://www.heise.de/-11184150

Links in diesem Artikel:

[1] https://ago.wv.gov/sites/default/files/2026-02/Filing.pdf

[2] https://www.heise.de/news/Kinderporno-Scan-auf-dem-iPhone-Apple-haelt-am-Aus-der-Funktion-fest-9292814.html

[3] https://www.heise.de/news/Missbrauchsbilder-in-iCloud-US-Sammelklage-wirft-Apple-Untaetigkeit-vor-10193835.html

[4] https://www.heise.de/hintergrund/Chatkontrolle-EU-Rat-will-das-freiwillige-Scannen-von-Chats-dauerhaft-erlauben-11086156.html

[5] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[6] https://www.heise.de/mac-and-i

[7] mailto:bsc@heise.de

Copyright © 2026 Heise Medien

(Bild: Tatiana Popova/Shutterstock.com)

Dells Backuplösung PowerProtect Data Manager ist unter anderem für Schadcode-Attacken anfällig. Sicherheitspatches stehen zum Download bereit.

Die Entwickler von Dell haben primär mehrere Schwachstellen in verschiedenen Komponenten von Drittanbietern geschlossen, die PowerProtect Data Manager nutzen. Davon ist in erster Linie der Linux-Kernel betroffen.

Wie aus einer Warnmeldung hervorgeht, [1] sind unter anderem GnuPG, OpenSSL und Vim betroffen. Stichproben zeigen, dass der Großteil der Lücken mit dem Bedrohungsgrad „mittel“ eingestuft ist. Es gibt aber auch Schadcode-Schwachstellen im Kernel (etwa CVE-2023-53572 „hoch“).

Ferner wurden auch Lücken in der Backuplösung direkt geschlossen. So können Angreifer, die bereits über niedrige Nutzerrechte verfügen, in zwei Fällen Schadcode ausführen (CVE-2026-22266 „hoch“, CVE-2026-22267 „hoch“).

Die Entwickler versichern, die Sicherheitsprobleme in Dell PowerProtect Data Manager 19.22.0-24 gelöst zu haben. Alle vorigen Ausgaben sollen verwundbar sein.

Zuletzt hat Dell unzählige Schwachstellen in Avamar, iDRAC und NetWorker geschlossen [2].

URL dieses Artikels:

https://www.heise.de/-11184164

Links in diesem Artikel:

[1] https://www.dell.com/support/kbdoc/en-us/000429778/dsa-2026-046-security-update-for-dell-powerprotect-data-manager-multiple-vulnerabilities

[2] https://www.heise.de/news/Dell-schliesst-unzaehlige-Sicherheitsluecken-in-Avamar-iDRAC-und-NetWorker-11173829.html

[3] https://pro.heise.de/security/?LPID=39555_HS1L0001_27416_999_0&wt_mc=disp.fd.security-pro.security_pro24.disp.disp.disp

[4] mailto:des@heise.de

Copyright © 2026 Heise Medien

(Bild: vectorfusionart / Shutterstock.com/ Bearbeitung heise medien)

Jürgen Schmidt sprach sich lange Zeit gegen offensive Cyber-Aktionen aus. Russlands Sabotage-Angriff auf Polens Energieversorgung hat seine Meinung geändert.

Deutschland muss offensive Fähigkeiten im Cyberspace entwickeln und auch einsetzen. Wir können uns dieser bereits stattfindenden Auseinandersetzung nicht länger verweigern.

Das Wort „Hackbacks“ verabscheue ich. Es ist ein aufgeblasener Politik-Marketing-Begriff, der falsche Assoziationen hervorruft. Als ob als direkte Antwort auf irgendwelche Hacks irgendwie „zurückgecybert“ würde. So funktioniert das aber nicht. Es geht nicht um Gegenschläge, sondern darum, ob man sich an einer Auseinandersetzung im Cyberspace aktiv beteiligt. Also lasst uns lieber von „offensiven Cyber-Fähigkeiten“ reden.

Damit meine ich Möglichkeiten, in einer Auseinandersetzung durch gezielte Cyber-Angriffe Informationen über den Gegner zu beschaffen, diesen zu beeinflussen und auch seine IT-Infrastruktur lahmzulegen. Die Auseinandersetzung gibt es bereits. Da tobt seit Jahren ein Krieg direkt vor unserer Haustür, in dem wir ganz eindeutig und aus guten Gründen für die angegriffene Ukraine und damit gegen den Aggressor Russland Partei ergriffen haben. Wir sind also bereits Teil davon.

Und wir sehen auch die Auswirkungen im Cyberspace bereits: Russland greift Europa und die NATO mit all seinen Cyber-Kräften an. Die Kreml-nahe Gruppe NoName057(16) koordiniert ganz offen DDoS-Angriffe gegen europäische Behörden und Unternehmen. Sie führt sogar öffentliche Hitlisten der aktuell ins Visier zu nehmenden Opfer. Auch heise online tauchte dort nach Russland-kritischen Äußerungen bereits auf. Russlands Geheimdienste betreiben außerdem in großem Stil Desinformationskampagnen, die auf Verunsicherung der Bevölkerung und Destabilisierung unserer Demokratie abzielen.

Und zur Jahreswende hat Russland eine weitere rote Linie überschritten. Wie das polnische CERT detailliert dokumentiert [2], haben – mit ziemlicher Sicherheit russische – Angreifer mit einem zerstörerischen Sabotage-Angriff die Energieversorgung unseres Nachbarlandes attackiert. Polen ist genau wie wir EU- und NATO-Mitglied. Dass es trotzdem darauf bisher keinerlei Reaktion des Westens gab, wird vor allem eines zur Folge haben: Russland wird im Cyberspace munter weiter eskalieren. Die nächsten Cyber-Angriffe könnten Energie-Versorger hier in Deutschland treffen.

Ich stelle mir seither die Frage: Können wir es uns wirklich leisten, uns dieser Auseinandersetzung im Cyberspace komplett zu verweigern oder genauer: dort immer nur einzustecken? Dem Cyber-Bully Russland die andere Cyber-Wange hinhalten, in der Hoffnung – ja welcher Hoffnung? Die werden doch nicht einfach aufhören. Warum sollten sie, wenn es funktioniert und für sie keine negativen Konsequenzen hat? Wir brauchen Möglichkeiten, diesen Aggressor in seine Schranken zu verweisen.

Man kann jetzt über die Unzuverlässigkeit der Informationen zur Täterschaft lamentieren. Doch Attribution hat sich so weit entwickelt, dass sie brauchbare Informationen über Tätergruppen und deren Herkunft liefern kann. Natürlich bleibt das Zuweisen der Verantwortung für Cyber-Angriffe ein schwieriges Handwerk, und es bleibt dabei immer etwas Rest-Unsicherheit. Genau deshalb machen direkte 1:1-Aktionen keinen Sinn. Denn da bestünde tatsächlich die Gefahr, mal den falschen zu beschuldigen und sich mit einer übereilten, direkten Antwort ins Unrecht zu setzen. Doch die generelle Entwicklung ist klar und unumstritten: Russland hat in den vergangenen Jahren seine Cyber-Angriffe gegen Europa und die NATO massiv ausgeweitet. Daran gibt es nichts zu deuteln. Und darauf haben wir – also Deutschland, die EU und die NATO – bislang keine angemessene Antwort.

Die könnte natürlich auch in anderen Bereichen erfolgen. Doch das haben wir ja bereits alles durchexerziert – ohne dass es Russland von einer Eskalation seiner Cyber-Aktivitäten abgeschreckt hätte. Glaubt jemand ernsthaft, dass eine Drohung mit weiteren Sanktionen oder der Ausweisung von Diplomaten Putin davon abhalten könnte, einen Cyber-Strike gegen deutsche KRITIS-Infrastruktur abzusegnen? Mit offensiven Cyber-Fähigkeiten ergeben sich da jedoch neue Möglichkeiten.

Was spräche denn dagegen, in die IT-Infrastruktur von NoName* einzudringen und diese nachhaltig zu sabotieren? Das wäre ein deutlicher Schlag gegen Russlands offensive Cyber-Aktivitäten und es demonstriert, dass wir in der Lage und bereit sind, auf Eskalation in diesem Bereich zu reagieren. Man könnte auch wichtige Personen in Russlands Kriegs-Maschinerie identifizieren, deren Kommunikation überwachen und ihre Handys mit Spionage-Software infizieren. Die daraus gewonnenen Informationen wären sicher überaus nützlich für die Koordination weiterer Aktionen – auch außerhalb des Cyberspace.

Insbesondere bei Sabotage-Aktionen kann man zwar unbeabsichtigte Nebenwirkungen nie völlig ausschließen. Doch man darf diese Gefahr auch nicht überzeichnen. Tausende Ransomware-Attacken haben trotz ihres rücksichtslosen Charakters bislang vor allem finanziellen Schaden angerichtet. Wenn man Cyber-Strikes mit Bedacht ausführt, kann man anders als etwa bei Raketenangriffen die Gefahr für Menschenleben sehr gering halten.

Natürlich bedeutet das nicht, dass man die defensiven Bemühungen im Cyber-Space vernachlässigen darf. Bessere IT-Sicherheit und mehr Resilienz sind unverzichtbar und haben höchste Priorität. Speziell der Angriff auf Polens Energieversorger zeigt, dass da trotz NIS-2 noch vieles im Argen liegt. Aber Deutschland, die EU und die NATO brauchen jetzt auch offensive Fähigkeiten im Cyberspace, um in der Auseinandersetzung mit Russland nicht dauerhaft am kürzeren Hebel zu sitzen.

Diesen Kommentar schrieb Jürgen Schmidt ursprünglich für den exklusiven Newsletter von heise security PRO [3], wo er jede Woche das Geschehen in der IT-Security-Welt für Sicherheitsverantwortliche in Unternehmen einordnet:

URL dieses Artikels:

https://www.heise.de/-11183881

Links in diesem Artikel:

[1] https://www.heise.de/heisec-pro

[2] https://infoservice.heise.de/d?l0cpwl0q0dvyt6bid0000kjq00000000xwx3fqq3zmfbqe4n47yry33i000chy00b000000c6cw3uo

[3] https://pro.heise.de/security/

[4] https://pro.heise.de/security/?LPID=39555_HS1L0001_27416_999_0&wt_mc=disp.fd.security-pro.security_pro24.disp.disp.disp

[5] mailto:ju@heise.de

Copyright © 2026 Heise Medien

Im Untergrundforum kündigt die Cybergang Lapsus$ den Datendiebstahl aus dem Extranet von Adidas an.

(Bild: heise medien)

Die Cybergang Lapsus$ behauptet in einem Untergrundforum, Daten von Adidas bei einem externen Dienstleister kopiert zu haben.

Angeblich gibt die kriminelle Online-Bande Lapsus$ in einem Untergrundforum an, einen Datensatz von Adidas im Extranet des Unternehmens kopiert zu haben. Der soll 815.000 Zeilen umfassen.

Laut dem Eintrag im Untergrundforum von der eigentlich nicht mehr eigenständig auftretenden Gruppierung Lapsus$, die zuletzt im Konglomerat „ShinyHunterLapsus“ auftrat, enthält die Datenbank Vornamen, Nachnamen, E-Mail, Passwort, Geburtstag und „eine Menge technische Daten“. Zudem deuten die Täter weitere entfleuchte Daten größeren Umfangs an: „Something bigger is coming, just wait. You will like it.“ schreiben sie dort. Auf Deutsch: „Etwas Größeres kommt, wartet ab. Ihr werdet es mögen“. Der Eintrag der Cyberkriminellen datiert auf den 16. Februar 2026. Mehr Details gibt es bislang nicht.

Auf Anfrage von heise online erklärte Adidas: „Wir wurden auf einen möglichen Datenschutzvorfall bei einem unabhängigen Lizenznehmer und Vertriebspartner für Kampfsportprodukte aufmerksam gemacht. Es handelt sich dabei um ein unabhängiges Unternehmen mit eigenen IT-Systemen. Wir haben keinerlei Hinweise darauf, dass die IT-Infrastruktur von adidas, unsere eigenen E-Commerce-Plattformen oder unsere Kundendaten von diesem Vorfall betroffen sind.“

Den Namen des betroffenen Vertriebspartners nennt Adidas hingegen nicht. Ebenso lässt der Hersteller im Dunkeln, welche Daten und in welchem Umfang sie potenziell betroffen sind, da der Lizenznehmer darauf Zugriff hat.

Sollten tatsächlich die von der angeblichen Lapsus$-Gruppe entwendeten Daten Namen und E-Mails sowie den Kontext „Adidas“ umfassen, können Angreifer damit gezielteres Phishing starten. Bei vermeintlichen Nachrichten von Adidas sollten Empfänger daher besondere Vorsicht walten lassen.

Es handelt sich nicht um den ersten IT-Sicherheitsvorfall, der im Kontext des Sportartikelherstellers Adidas bekannt wird. Bereits im Mai vergangenen Jahres haben Kriminelle Daten von Adidas-Kunden abgegriffen [1]. Der Umfang war auch damals unklar. Die Daten bestanden damals „im Wesentlichen aus Kontaktinformationen, die zu Kunden gehören, die unseren Kundendienst in der Vergangenheit kontaktiert haben“, erklärte das Unternehmen dort. Auch da kam es offenbar zum unbefugten Datenzugriff bei einem „beauftragten Kundendienstanbieter“.

URL dieses Artikels:

https://www.heise.de/-11184064

Links in diesem Artikel:

[1] https://www.heise.de/news/Datenleck-Kriminelle-erbeuten-Adidas-Kundendaten-10399077.html

[2] https://pro.heise.de/security/?LPID=39555_HS1L0001_27416_999_0&wt_mc=disp.fd.security-pro.security_pro24.disp.disp.disp

[3] mailto:dmk@heise.de

Copyright © 2026 Heise Medien

(Bild: photoschmidt/ Shutterstock.com)

Immer mehr Open-Source-Projekte leiden unter der Flut oft wertloser KI-Beiträge über GitHub. Der Betreiber hat nun erste Maßnahmen dagegen angekündigt.

GitHub hat erste Schritte angekündigt, um das Problem der schmuddeligen KI-Beiträge für Open-Source-Projekte anzugehen. Immer mehr Maintainer beklagen sich über derartige Pull Requests (PRs), deren Autorinnen und Autoren „möglicherweise nicht vollständig verstehen, was sie beitragen“ (Brecht Van Lommel, Blender). Das zu Microsoft gehörende GitHub steht als KI-Treiber im Zentrum der Kritik, hat nun aber eine Reihe von Maßnahmen in Planung.

Im Blogeintrag erkennt GitHub das Problem an [1]: „Als Heimat von Open Source haben wir die Verantwortung, euch bei dem zu helfen, was auf euch zukommt.“ Als erste Maßnahme kündigt GitHub an, dass Maintainer PRs künftig einfach löschen können. Das gibt ihnen die Möglichkeit, schon anhand einer schnellen Prüfung AI Slop kurzerhand auszusortieren, um die Übersichtlichkeit des Repos zu erhalten. Das war auch eine der Hauptforderungen vieler überlasteter Projektverantwortlicher.

Weitere Funktionen, die GitHub derzeit erwägt, sind an Bedingungen geknüpfte PRs oder Triage-Tools, die PRs aussortieren, die Erfordernisse nicht erfüllen, die die Maintainer beispielsweise in einer Datei CONTRIBUTING.md manifestieren.

Vorangegangen war ein Aufruf von GitHub in der Community [2], in dem der Anbieter um Feedback bittet. Hier kündigt GitHub noch an, dass Maintainer PRs auf bestimmte Gruppen von Kontributoren oder für Mirrors einschränken können sollen.

In den vergangenen Wochen hatte die Kritik zugenommen: Gentoo Linux ist auf dem Weg [3], von GitHub zu Codeberg zu wechseln, und Curl stoppte das Bug-Bounty-Programm [4] auf Hacker One aus ähnlichen Gründen. Zuletzt hatten sich Rémi Verschelde, Maintainer der Spiele-Engine Godot, und Brecht Van Lommel, Softwarearchitekt bei Blender, kritisch zu Wort gemeldet. Verschelde schreibt auf Bluesky [5]: „Offen gesagt werden AI-Slop-PRs für die Godot-Maintainer immer anstrengender und demoralisierender.“ Gleichzeitig ruft er dazu auf, Godot besser finanziell zu unterstützen, um mehr Maintainer bezahlen zu können: Das „ist die einzige praktikable Lösung, die ich mir vorstellen kann.“

Weitere Vorschläge in den Kommentaren zu seinem Posting sind ein Authentifizierungssystem für Kontributoren oder ein Vorrang für erfahrene Entwickler mit ausreichend historischen GitHub-Beiträgen. Das hält auch Verschelde für möglich: „Ich möchte die Zugangsbarriere nicht erhöhen, aber wir haben vielleicht keine andere Wahl.“ An GitHub möchte er festhalten, aufgrund der guten Vernetzung der Projekte und nicht zuletzt wegen der kostenlosen CI.

Kritik an GitHub zielt in erster Linie auf die KI-treibende Politik von Microsoft, in deren Zentrum der Copilot steht. Alex McLean, Maintainer des Musik-Projekts Strudel, berichtet etwa [6]: „Bei uns gab es keine KI-Bot-PRs mehr, seit wir von Microsoft GitHub zu Codeberg umgezogen sind. Ich vermute, dort gibt es keine Anreize dafür.“ Ein anderer Kommentator bezweifelt, dass GitHub ernsthafte Maßnahmen ergreifen will: „Das werden sie nicht. GitHub untersteht Microsofts KI-Team. Jedes neue Update auf der GitHub-Homepage hat einen KI-Bezug.“ Hier wird sich Microsoft beweisen müssen, um eine weitere Abwanderung einzudämmen.

Brecht Van Lommel schreibt im Blender-Blog [7] neben seinem eingangs genannten Zitat: Für Maintainer ist es sinnvoll, neue Entwickler in das Projekt einzuweisen, um dieses voranzubringen, „auch wenn es für den Reviewer schneller gewesen wäre, die Änderungen selbst vorzunehmen (mit oder ohne KI). Daher sollten Reviewer wissen, ob sie mit einem Menschen zusammenarbeiten, damit sie entscheiden können, ob sich der Aufwand lohnt.“

URL dieses Artikels:

https://www.heise.de/-11184036

Links in diesem Artikel:

[1] https://github.blog/open-source/maintainers/welcome-to-the-eternal-september-of-open-source-heres-what-we-plan-to-do-for-maintainers/

[2] https://github.com/orgs/community/discussions/185387

[3] https://www.heise.de/news/Zu-viel-Copilot-Gentoo-wechselt-von-GitHub-zu-Codeberg-11179285.html

[4] https://www.heise.de/news/curl-Projekt-beendet-Bug-Bounty-Programm-11142345.html

[5] https://bsky.app/profile/akien.bsky.social/post/3meyerixvhs2p

[6] https://bsky.app/profile/slab.org/post/3mf53mw4dcs23

[7] https://devtalk.blender.org/t/ai-contributions-policy/44202

[8] mailto:who@heise.de

Copyright © 2026 Heise Medien

(Bild: Pincasso/Shutterstock)

In C# 14.0 lassen sich Parameter-Modifizierer in Lambda-Ausdrücken verwenden, ohne dabei den Datentyp benennen zu müssen.

In Lambda-Ausdrücken kann man in C# 14.0 jetzt Parameter-Modifizierer wie scoped, ref, in, out und ref readonly verwenden, ohne dabei den Datentyp benennen zu müssen.

Ein Beispiel: Für den Delegate

delegate bool Extract<T>(string text, out T result);musste man vor C# 14.0 Folgendes schreiben:

Extract<int> ExtractOld = (string text, out int result)

=> Int32.TryParse(text, out result);Ab C# 14.0 können Entwicklerinnen und Entwickler im Lambda-Ausdruck die Nennung der Datentypen string und int weglassen, weil diese Datentypen aus dem Kontext bereits klar sind:

Extract<int> ExtractNew = (text, out result)

=> Int32.TryParse(text, out result);Das geht allerdings nicht, wenn ein variadischer Parameter mit params zum Einsatz kommt:

Add<int> AddOld = (out int result, params List<int> data)

=> { result = data.Sum(); return true; };Nicht möglich ist also folgende Verkürzung:

Add<int> AddNew = (out result, params data)

=> { result = data.Sum(); return true; };

URL dieses Artikels:

https://www.heise.de/-11181531

Links in diesem Artikel:

[1] mailto:rme@ix.de

Copyright © 2026 Heise Medien

(Bild: luchschenF / Shutterstock.com)

Die Kubernetes-Policy-Engine Kyverno beendet die Beta-Phase für CEL-basierte Policy-Typen und leitet den Abschied von Legacy-APIs ein.

Kyverno hat sich als Policy-as-Code-Werkzeug für Kubernetes etabliert, mit dem sich Richtlinien direkt als Kubernetes-Ressourcen definieren und durchsetzen lassen – von Validierung über Mutation bis hin zur Image-Verifikation. Das Tool begegnet so der wachsenden Komplexität beim Betrieb von Kubernetes-Clustern, indem es Sicherheits- und Compliance-Regeln als Code abbildet. Mit Version 1.17 vollzieht das CNCF-Projekt laut eigener Ankündigung nun einen strategischen Schnitt: Die in Version 1.16 eingeführte CEL-first-Architektur (Common Expression Language) verlässt den Beta-Status und wird zur stabilen Grundlage.

Die zentrale Neuerung in Kyverno 1.17 ist laut CNCF-Blog [1] die Promotion sämtlicher CEL-basierter Policy-Typen auf die API-Version v1. Damit gelten sie als stabil und produktionsreif. Im Einzelnen betrifft das: ValidatingPolicy, MutatingPolicy, GeneratingPolicy, ImageValidatingPolicy, DeletingPolicy sowie PolicyException – jeweils inklusive ihrer Namespaced-Varianten (etwa NamespacedValidatingPolicy).

Die Common Expression Language ist dieselbe Ausdruckssprache, die der Kubernetes-API-Server selbst für seine nativen ValidatingAdmissionPolicies und MutatingAdmissionPolicies verwendet. Dem Kyverno-Entwicklungsteam zufolge soll der Wechsel zur CEL die Evaluierungsleistung spürbar verbessern und die Einarbeitungszeit für Plattform-Teams senken, da sie sich nur noch mit einer Sprache auseinandersetzen müssen.

Parallel dazu hat das Projekt die verfügbaren CEL-Funktionen erheblich ausgebaut. Neu hinzugekommen sind unter anderem Hash-Funktionen (md5, sha1, sha256), mathematische Rundung (math.round(value, precision)), das Dekodieren von X.509-Zertifikaten (x509.decode(pem)), Zufallsstring-Generierung, JSON- und YAML-Parsing sowie zeitbasierte Funktionen wie time.now() und time.toCron(timestamp), die etwa auch Policies für Wartungsfenster ermöglichen sollen.

Mit dem GA-Status der CEL-Policies geht eine klare Ansage an Bestandsnutzer einher: Laut der Ankündigung [5] markiert Kyverno 1.17 die bisherigen Typen ClusterPolicy und CleanupPolicy offiziell als veraltet (deprecated). Diese JMESPath-basierten APIs bleiben in der aktuellen Version zwar funktionsfähig, sollen aber in einer künftigen Version vollständig entfallen – voraussichtlich noch im laufenden Jahr. Die Entwickler empfehlen ausdrücklich, neue Policies ausschließlich mit den CEL-basierten APIs zu schreiben, um den späteren Migrationsaufwand nicht weiter zu vergrößern.

Für Teams mit umfangreichen bestehenden Policy-Beständen stellt das Projekt einen Migrationsleitfaden [6] bereit, der eine Feld-für-Feld-Zuordnung von Legacy-Konfigurationen zu den neuen Äquivalenten bieten soll. Beispielsweise wird das bisherige validate.pattern auf CEL-Ausdrücke in ValidatingPolicy abgebildet. Wer bislang ClusterPolicy-Regeln für Mutation, Validierung und Generierung in einem einzigen Objekt gebündelt hat, muss diese künftig auf die spezialisierten Typen ValidatingPolicy, MutatingPolicy und GeneratingPolicy aufteilen.

Bereits in Version 1.16 hatte Kyverno Namespaced-Varianten für Validierung, Cleanup und Image-Verifikation eingeführt. Version 1.17 schließt laut Ankündigung diese Lücke mit NamespacedMutatingPolicy und NamespacedGeneratingPolicy. Namespace-Besitzer können damit eigene Mutations- und Generierungsregeln definieren – etwa um automatisch Sidecar-Container zu injizieren oder Standard-ConfigMaps zu erzeugen –, ohne clusterweite Berechtigungen zu benötigen oder andere Mandanten zu beeinflussen. Damit soll echte Multi-Tenancy auf Policy-Ebene möglich werden.

Für mehr Sicherheit in der Supply Chain bringt Kyverno 1.17 laut der Ankündigung [7] Unterstützung für Cosign v3, um die Image-Verifikation mit dem sich weiterentwickelnden Sigstore-Ökosystem kompatibel zu halten. Die neuen YAML- und JSON-Parsing-Funktionen in CEL sollen es zudem erleichtern, komplexe Metadaten und Software Bill of Materials (SBOMs) innerhalb von Attestierungen zu prüfen.

Bei der Observability haben die Entwickler an zwei Stellschrauben gedreht: Ein neues Flag --allowedResults ermöglicht es, gezielt nur bestimmte Ergebnisse (etwa ausschließlich fehlgeschlagene Prüfungen) in Reports zu speichern. Das soll den Druck auf etcd in großen Clustern deutlich reduzieren. Darüber hinaus liefert Kyverno 1.17 laut dem Blogbeitrag [8] standardmäßig detailliertere Latenz- und Ausführungsmetriken für CEL-Policies.

Neben den technischen Neuerungen hat das Kyverno-Projekt seinen gesamten Webauftritt auf Basis des Starlight-Frameworks neu gestaltet. Die überarbeitete Dokumentation umfasst eine nach Nutzererfahrung gestaffelte Struktur – vom Schnelleinstieg bis zur Referenz für fortgeschrittene Policy-Autoren. Der Katalog mit über 300 Beispiel-Policies soll sich nun nach Kategorie und Typ (CEL vs. JMESPath) filtern lassen.

Für Entwickler und Integratoren hat das Projekt seine Kernkomponenten entkoppelt: Die CEL-basierten APIs sind in ein eigenes Repository (kyverno/api [9]) ausgelagert worden, was den Import von Kyverno-Typen in eigene Go-Projekte erleichtern soll. Zusätzlich steht ein dediziertes SDK-Projekt (kyverno/sdk [10]) für den Bau eigener Controller und Tools bereit.

Für die weitere Entwicklung skizzieren die Kyverno-Maintainer [11] mehrere Schwerpunkte: Die verschiedenen Unterprojekte – CLI, Policy Reporter und Kyverno-Authz – sollen zu einer einheitlichen Plattform zusammenwachsen. Zudem will das Team automatisierte Performancetests etablieren und granulare Durchsatz- sowie Latenz-Daten bereitstellen, damit Plattform-Teams das Verhalten von Kyverno in Hochlast-Szenarien besser einschätzen können. Ein Upgrade von Version 1.16 auf 1.17 soll laut den Entwicklern unkompliziert sein, allerdings empfehlen sie, Manifeste auf die neue API-Version v1 umzustellen. Die bisherige v1beta1 werde für eine Übergangszeit weiter unterstützt.

URL dieses Artikels:

https://www.heise.de/-11182117

Links in diesem Artikel:

[1] https://www.cncf.io/blog/2026/02/18/announcing-kyverno-1-17/

[2] https://clc-conference.eu/?wt_mc=intern.academy.dpunkt.konf_dpunkt_vo_clc.empfehlung-ho.link.link&LPID=35283

[3] https://clc-conference.eu/cfp.php?wt_mc=intern.academy.dpunkt.konf_dpunkt_vo_clc.empfehlung-ho.link.link&LPID=35283

[4] https://clc-conference.eu/?wt_mc=intern.academy.dpunkt.konf_dpunkt_vo_clc.empfehlung-ho.link.link&LPID=35283

[5] https://kyverno.io/blog/2026/02/02/announcing-kyverno-release-1.17/

[6] https://kyverno.io/docs/migration/kyverno-1-17-migration-guide

[7] https://kyverno.io/blog/2026/02/02/announcing-kyverno-release-1.17/

[8] https://www.cncf.io/blog/2026/02/18/announcing-kyverno-1-17/

[9] https://github.com/kyverno/api

[10] https://github.com/kyverno/sdk

[11] https://kyverno.io/blog/2026/02/02/announcing-kyverno-release-1.17/

[12] mailto:map@ix.de

Copyright © 2026 Heise Medien

Streaming-Clients wie die Amazon Fire TV Sticks machen smarte Oberflächen auch für alte Fernseher und Monitore möglich. c't 3003 hat vier Geräte getestet.

Mit Geräten wie dem Google TV Streamer 4K, Amazons Fire-TV-Sticks und Apple TV lässt sich so gut wie jeden Fernseher oder Monitor mit Smart-TV-Funktionen ausstatten. c't 3003 zeigt, worin sie sich unterscheiden und was die Open-Source-Lösung mit Rapsi taugt.

(Hinweis: Dieses Transkript ist für Menschen gedacht, die das Video oben nicht schauen können oder wollen. Der Text gibt nicht alle Informationen der Bildspur wieder.)

Guckt mal hier, das ist mein Samsung-Smart-TV und der treibt mich komplett in den Wahnsinn. Der braucht eine halbe Ewigkeit zum Hochfahren, zwickt und zwackelt an allen Ecken und ständig funktioniert irgendwas nicht. Aber statt mir jetzt einen komplett neuen Fernseher zu kaufen, könnte ich mir ja auch einen von diesen Streaming-Devices hier an den Fernseher klemmen. Also sowas wie den Amazon Fire TV Stick, Google Streamer 4K oder Apple TV. Mit denen lässt sich theoretisch jeder Fernseher zum Smart TV machen. Aber welchen davon soll man denn nehmen? Die kosten von 50 bis fast 200 Euro und alleine von Amazon gibt's fünf verschiedene. Aber kann man sich sowas nicht auch selbst bauen? Ja, natürlich geht das. Ich hab hier noch einen Raspi 4 rumliegen und da lässt sich sowas wie LibreELEC mit Kodi oder ein modifiziertes Android TV drauf installieren. Mit YouTube, Twitch und so weiter. Alles besser als dieses furchtbare Tizen OS von Samsung, oder? Ja, schauen wir mal. Worin sich diese ganzen Streaming-Dinger unterscheiden und ob da ein selbst gebasteltes Gerät wie mein Raspi hier mithalten kann, klären wir in diesem Video. Also, bleibt dran!

Also die meisten von euch kennen vermutlich diese Streaming-Devices hier. Das sind Geräte, die man per HDMI eigentlich an jeden Fernseher klemmen kann. Das kann ein Smart TV sein, mit dessen Funktion man unzufrieden ist, oder halt irgendein Gerät mit HDMI. Also zum Beispiel ein Beamer oder ein alter Monitor oder so. Davon gibt es aber viele verschiedene in sehr unterschiedlichen Preisklassen. Ich habe mir jetzt mal hier die Geräte der größten Big Player im Game in unterschiedlicher Ausführung besorgt, um zu sehen, worin die sich unterscheiden. Also vor allem, warum sind manche davon so günstig? Könnte das mit Werbung zu tun haben? Ja, hat es.

Also ich habe hier einmal die Amazon Fire TV Sticks, die bei ca. 50 Euro losgehen, den Google Streamer 4K für grob 90 Euro und den Apple TV 4K der dritten Generation für lockere 170 Euro. Das sind alles Big-Tech-US-Unternehmen, ich weiß, aber ich meinte ja ganz am Anfang, dass es auch noch eine Open-Source-Möglichkeit gibt, um sich sowas beispielsweise auf einem Raspi selber zu bauen. Da gibt es dann auf jeden Fall keine Werbung, aber andere dicke Einschränkungen. Da komme ich aber später noch zu.

Erstmal jetzt ein kurzer Überblick über die Mainstream-Dinger. Angefangen mit den Fire TV Sticks von Amazon. Von den Dingern gibt es fünf verschiedene Ausführungen. Schon mal verwirrend. Der günstigste ist der Fire TV Stick HD für 45 Euro. Den lasse ich hier jetzt aber mal weg, weil der kann kein 4K und das ist meiner Meinung nach einfach nicht mehr zeitgemäß. Viel interessanter ist der nächst günstigere, der Fire TV Stick 4K Select für 55 Euro. Der kann 4K, hat einen Quad-Core mit 1,7 GHz, 1 GB RAM und 8 GB internen Speicher. Dazu gibt es diese simple Fernbedienung mit so Standardknöpfen und Alexa-Sprachsteuerung, wenn man das benutzen will. Was ich im Jahr 2026 wirklich super crazy finde, ist, dass das Teil per Micro-USB mit Strom versorgt wird. Und das ist nicht nur bei diesem günstigen Select-Stick so, sondern auch der 25 Euro teurere Fire TV Stick 4K Max hat Micro-USB. Was ist denn da los, Amazon? Was soll das? Ich habe meine Micro-USB-Kabel auf jeden Fall schon vor Jahren entsorgt.

Und dieser Select-Stick hat im Vergleich zu den teureren Modellen auch noch ein paar andere Einschränkungen. Beispielsweise kann der Select kein Dolby Vision, sondern nur HDR10+. Also falls euer Fernseher oder Beamer das hat, muss man das im Hinterkopf behalten. Und im Gegensatz zu den anderen Modellen hat der Select auch nur Wi-Fi 5 statt Wi-Fi 6. Ist das wirklich ein Problem? Joa, könnte es sein, denn Wi-Fi 6 läuft besser, besonders dann, wenn viele andere Geräte durch die Gegend funken. Also kann man im Hinterkopf behalten. Ich hatte jetzt aber keine Probleme mit der Verbindung oder so.

Die Einrichtung ist auf jeden Fall super easy. Einfach per QR-Code mit Amazon einloggen, kurz updaten und dann ist das Ding ready. Und ja, man kann es sich schon denken, ohne Amazon-Account wird das nichts. Also den braucht man schon zwingend. Und die Oberfläche fühlt sich, ich sag mal, gerade so okay an. Also einmal finde ich die nicht besonders hübsch, kennt man ja von Prime Video, und so richtig smooth läuft das auch nicht. Man hat so spürbaren Input-Lag und die Oberfläche bleibt manchmal kurz stecken, besonders dann, wenn man zwischen Apps hin und her wechselt. Also das läuft auf jeden Fall besser als bei meinem Samsung, aber auch nicht so richtig geschmeidig, wie ich das gerne hätte.