IoT verstehen statt nur nutzen: Mit Makey:Lab stellen Make und der Umwelt-Campus Birkenfeld eine neue Plattform für eigene Technikprojekte vor.

(Bild: Andreas Wodrich / heise medien)

Mit Makey:Lab erscheint in Kürze eine Plattform für IoT-Technik. Es richtet sich an junge Menschen, die Technik nicht nur nutzen, sondern auch verstehen wollen.

Technik ist heute allgegenwärtig: Smartphones, smarte Lautsprecher, Sensoren, Internet, Cloud-Dienste gehören für viele Jugendliche zum Alltag. Wie die einzelnen Komponenten solcher Systeme miteinander verbunden sind und zusammenwirken, bleibt dabei oft unklar.

Mit Makey:Lab kann man die gleichen Techniken spielerisch in eigenen Projekten einsetzen und so die Zusammenhänge besser verstehen.

Makey:Lab ist eine kompakte Lern- und Experimentierplattform. Robust gebaut, übersichtlich und tragbar. Ein ESP32 übernimmt die Rechenarbeit. Hinzu kommen ein BME680-Umweltsensor für Temperatur, Luftfeuchtigkeit, Luftdruck und Luftqualität, ein Farbsensor, ein MEMS-Mikrofon, ein Buzzer, ein OLED-Display, zwei RGBW-LEDs und ein Dreh-drück-Encoder für Interaktionen.

Mehrere Erweiterungsanschlüsse öffnen Makey:Lab für zusätzliche Sensoren und Aktoren. Eine Kontaktleiste ermöglicht zudem die Nutzung von BBC-micro:bit-kompatibler Hardware.

Viele dieser Bausteine kennen Maker aus eigenen Projekten, meist als einzelne Module, die erst beschafft, kombiniert und verdrahtet werden müssen. Makey:Lab bündelt diese Hardware auf einer einzigen Platine. Das spart Zeit und senkt die Einstiegshürde deutlich.

Die Plattform ist kompakt, übersichtlich aufgebaut und ohne lose Kabel. So lässt sie sich problemlos mitnehmen und spontan einsetzen – vom eigenen Schreibtisch bis zur Arbeit mit vielen Händen in der Schule oder in Workshops.

Damit Ideen schnell umgesetzt werden können, setzt Makey:Lab softwareseitig auf die „IoT-Werkstatt“. Die Entwicklungsumgebung arbeitet blockbasiert und baut intern auf der bekannten Arduino IDE und Ardublock auf.

Unter der Oberfläche entsteht echter C++-Code für den ESP32, automatisch generiert, aber jederzeit einseh- und editierbar.

Die Blockprogrammierung erleichtert Anfängern den Einstieg. Die Sensoren, das Display und das WLAN lassen sich ohne das Wissen um Protokolle und technische Details zur Elektronik einfach nutzen. Die Blöcke liefern einfach die gewünschten Daten oder schreiben Werte auf das Display. Dabei bleiben grundlegende Konzepte in der Programmierung trotzdem sichtbar: Variablen, Bedingungen, Schleifen.

Das beiliegende Playbook umfasst über 200 Seiten und ist als Arbeitsbuch konzipiert. Es verbindet Erklärung, Dokumentation und Projektarbeit.

Der erste Teil führt in die Plattform, die IoT-Werkstatt und grundlegende Programmierlogik ein. Der zweite Teil besteht aus Projekten, die Themen aus dem Alltag aufgreifen, etwa Wetter, Raumklima, Geräusche, Licht oder Internetanbindung.

Die Ansprache richtet sich klar an Jugendliche und bleibt auf Augenhöhe. Ziel ist es, Technik verständlich zu vermitteln, ohne banal zu werden.

Die Projekte im Playbook greifen Alltagsthemen konkret auf. Zu Beginn wird Makey:Lab zum Wetterfrosch. Temperatur, Luftdruck und Luftfeuchtigkeit werden gemessen, angezeigt und eingeordnet. Was sagt ein fallender Luftdruck aus? Wie unterscheiden sich Innen- und Außenwerte?

Im Kapitel „Frische Luft fürs Gehirn“ misst Makey:Lab die Luftqualität im Raum und steuert eine Lüftungsampel. Grün, Gelb, Rot: Bauchgefühl wird durch Messwerte ersetzt.

Praktisch wird es auch mit der sogenannten Duschpetze. Steigen Temperatur und Luftfeuchtigkeit zu stark, meldet sich das System. Das spart Energie, reduziert Schimmelgefahr und macht Klimadaten unmittelbar erfahrbar.

Ein weiteres Projekt ist eine einfache Zimmer-Alarmanlage mit Internetanbindung. Erkennt Makey:Lab Bewegung, Lichtänderungen oder Geräusche, gibt es eine Benachrichtigung per WhatsApp. Für viele Jugendliche ist das der Moment, in dem klar wird, was Internet of Things und smarte Vernetzung konkret bedeuten.

Makey:Lab ist aus der praktischen Arbeit entstanden. Am Umwelt-Campus Birkenfeld setzt Prof. Dr. Klaus-Uwe Gollmer seit Jahren die Vorgängerplattform Octopus in der Lehre ein, mit Studierenden, in Projekten und bei Hackathons. Das Hardwaredesign stammt von Guido Burger (FabLab.eu).

Ziel war und ist es, Sensorik, Internet of Things und Nachhaltigkeit so zu vermitteln, dass Zusammenhänge verstanden werden, statt nur Messwerte zu sammeln. Gollmer beschreibt diesen Ansatz als IoT² – Internet of Things and Thinking.

Auf dieser Grundlage entstand Makey:Lab als nächste Entwicklungsstufe, ergänzt um die Erfahrung der Make-Redaktion, komplexe Technik verständlich zu erklären.

Makey:Lab ist als langfristiger Begleiter angelegt. Weitere Playbooks zu Themen wie KI, Robotik und Energie sowie zusätzliche Hardwareerweiterungen sind bereits in Planung. Ergänzend entstehen Onlinematerialien und eine Plattform zum Austausch, in der Projekte geteilt und weiterentwickelt werden können.

Einsatzmöglichkeiten gibt es viele: zu Hause, in Makerspaces, in der Schule oder im Studium. Überall dort, wo Technik nicht nur erklärt, sondern ausprobiert werden soll.

Die Idee dahinter ist einfach: Wer Technik versteht, kann sie gestalten. Makey:Lab liefert dafür die Werkzeuge – praxisnah und mit genug Tiefe, damit es nicht beim LED-Blinken bleibt.

Zum Zeitpunkt dieses Artikels befindet sich Makey:Lab in der finalen Produktionsphase. Der offizielle Start ist in Kürze geplant. Aktuelle Informationen gibt es in diesem Beitrag. [7]

URL dieses Artikels:

https://www.heise.de/-11153763

Links in diesem Artikel:

[1] https://www.heise.de/ratgeber/Die-Makey-Lab-Plattform-11153763.html

[2] https://www.heise.de/ratgeber/Wie-Maker-Skills-in-der-Schule-gefoerdert-werden-ein-Erfahrungsbericht-10299421.html

[3] https://www.heise.de/hintergrund/Raspberry-Pi-Projektideen-fuer-junge-Programmierer-10001876.html

[4] https://www.heise.de/ratgeber/Wie-man-Kinder-fuer-Elektronik-und-Programmieren-begeistert-10564591.html

[5] https://www.heise.de/ratgeber/Roboter-und-Baukaesten-Lern-Gadgets-fuer-Kinder-ausprobiert-10642803.html

[6] https://www.heise.de/make

[7] https://www.heise.de/hintergrund/Makey-Lab-Der-leichte-IoT-Einstieg-fuer-junge-Maker-10498312.html

Copyright © 2026 Heise Medien

(Bild: Lee Charlie/Shutterstock.com)

Batch-Scans mehrerer verdächtiger Dateien und passgenaue Malware-Recherchen zur Incident Response: Mit dem Gratis-Tool vt-cli folgt VirusTotal Ihrem Kommando.

Googles Online-Dienst VirusTotal (VT) ist die wohl beliebteste Anlaufstelle für Malware-Scans durch Privatanwender wie auch Profis. Über das Webinterface kann man einzelne Dateien oder verdächtige URLs mit wenigen Klicks übermitteln. VT durchleuchtet sie mit Scan-Engines mehrerer Anbieter, führt zusätzlich dynamische und statische Analysen durch und bündelt alle Informationen in einem ausführlichen Report.

Jenseits einfacher Anwendungsfälle stößt die grafische Oberfläche des Dienstes jedoch schnell an ihre Grenzen. Zum Beispiel dann, wenn Sie bei akutem Schadcode-Befall möglichst zügig nicht nur eine einzelne Datei, sondern gleich den Inhalt eines ganzen Ordners scannen wollen. Oder wenn Sie im Zuge einer Kompromittierung wissen möchten, ob einige der verdächtigen IP-Adressen aus Ihren Logfiles bereits bei früheren VT-Analysen aufgetaucht sind.

Das „VirusTotal Command-Line Interface“, kurz: vt-cli erspart Ihnen in solchen Situationen zeitraubende Einzel-Uploads beziehungsweise -Suchanfragen. Das auf der Kommandozeile basierende Hilfstool entkoppelt die VirusTotal-Funktionen vom Webinterface, indem es direkt auf das zugrundeliegende API zugreift. So können Sie mittels einfacher Terminal-Befehle die von VT gewohnten Scan- und Suchfunktionen nutzen und überdies den Output Ihren individuellen Bedürfnissen anpassen.

Wie Sie mit dem für Linux, Windows und macOS verfügbaren Gratis-Tool schnelle Batch-Scans umsetzen, Ergebnisse filtern und die VT-Plattform gezielt nach relevanten Bedrohungsinformationen durchsuchen können, erklärt dieser Artikel. Außerdem vermittelt er einen ersten Eindruck davon, wie Entwickler vt-cli zum Skripten von VirusTotal-Abfragen nutzen können, ohne sich mit Interna der Programmierschnittstelle zu befassen.

vt-cli ist ein offizielles VirusTotal-Projekt, dessen Quellcode bei GitHub gehostet wird. Am schnellsten bringt man es auf dem eigenen System zum Laufen, indem man auf die fertig kompilierten Binaries zurückgreift. Die stehen zum Veröffentlichungszeitpunkt dieses Artikels in Version 1.2.0 zum Download bereit [2].

Eine Installation ist nicht notwendig: Nach dem Extrahieren der Standalone-Anwendung „vt“ kopieren Sie diese einfach in das gewünschte Verzeichnis und starten sie mit dem Kommandozeilenbefehl vt init. In unserem Testdurchlauf mit Windows 11 sowie mit einer frischen Installation des Debian-basierten Kali Linux in VirtualBox klappte das jeweils problemlos. Wer das in der Sprache Go programmierte Projekt lieber selbst kompilieren möchte, folgt der Kurzanleitung in der Readme.MD [3].

(Bild: Screenshot)

In der vt-cli-Dokumentation tummeln sich Anwendungsbeispiele, die die bereitgestellten VirusTotal-Funktionen auf clevere und praktische Weise mit Unix-Befehlen wie cat oder grep kombinieren. Um diese Beispiele unverändert unter Windows übernehmen zu können, raten die vt-cli-Entwickler zur zusätzlichen Installation der freien Laufzeitumgebung Cygwin [4]. Das Cygwin-Terminal versteht Unix-Befehle und bietet laut vt-cli-Team zudem Performance-Vorteile gegenüber der Standard-Windows-Konsole bei der Ausgabe großer Textmengen.

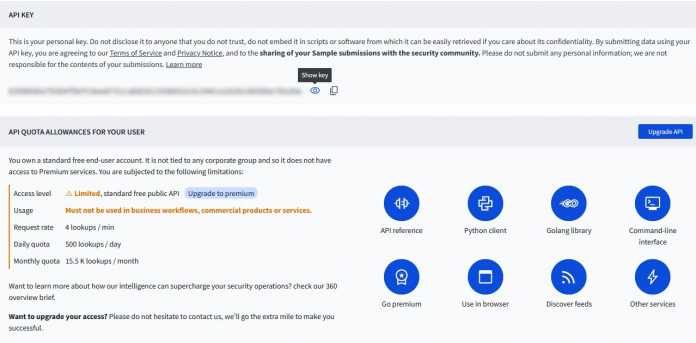

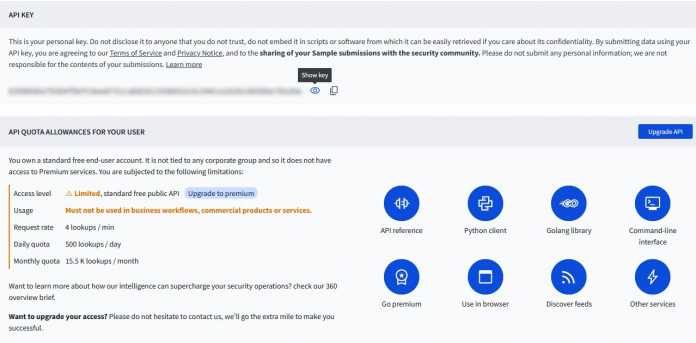

Nach dem ersten Aufruf von vt-cli via vt init fragt das Tool nach einem VirusTotal-API-Key. Einen solchen können Sie in der Ausführung „standard free public“ kostenlos von der VT-Website beziehen [5]. Dort legen Sie zunächst einen Account an, loggen sich ein und klicken dann oben rechts auf Ihren Benutzernamen.

(Bild: VirusTotal / Screenshot)

Über den Menüpunkt „API Key“ sind der kostenlose Schlüssel wie auch Informationen zu den Nutzungsbedingungen und -beschränkungen abrufbar. Insbesondere die Aufforderung, den Schlüssel vor unbefugtem Zugriff zu schützen, sollten Sie dringend beherzigen: Bösewichte missbrauchen gestohlene Keys gern für massenhafte Anfragen, um etwa Verschleierungstaktiken ihres Schadcodes zu testen. Im schlimmsten Fall führt derlei Missbrauch zur Sperrung des Schlüssels.

Nach einmaliger Übergabe des Keys an vt-cli speichert das Tool diesen dauerhaft in einer Konfigurationsdatei im Home- beziehungsweise Benutzerverzeichnis Ihres Systems. Nun ist vt-cli startklar.

An dieser Stelle noch ein wichtiger Hinweis: Wenn Sie Dateien mit Ihrem kostenlosen API-Key zu VT hochladen, sind die Resultate dauerhaft online abrufbar – und zwar für alle Nutzer. Achten Sie deshalb unbedingt darauf, keine Dokumente vertraulichen Inhalts zu übermitteln.

Falls Sie bei einer bestimmten verdächtigen Datei unsicher sind, ob Ihr Upload nicht doch ein Datenschutzproblem darstellen könnte, bietet sich ein Alternativweg an: Mit vt file (Dateihash) starten Sie eine Suchanfrage auf der VT-Plattform. Ist die Datei dort bereits bekannt und ein Report vorhanden, gibt Ihnen vt-cli dessen Inhalt im Terminal aus.

Für die Anfrage benötigen Sie den SHA-256-, SHA-1- oder MD5-Hash Ihrer verdächtigen Datei. Den ermitteln Sie unter Linux ganz einfach mit Kommandozeilen-Tools wie sha256sum, sha1sum und md5sum. Unter Windows können Sie etwa das PowerShell-Cmdlet Get-FileHash [6] nutzen.

Um ein wenig mit den Scan-Funktionen zu experimentieren genügt es im Zweifel, schnell ein paar harmlose Testdateien zusammenzustellen oder alternativ auf die EICAR-Testdatei [7]zurückzugreifen.

Eine Analyse werfen Sie ganz einfach mit

vt scan file (Pfadangabe/Dateiname) --open

beziehungsweise

vt scan url (URL) --open

an. Dabei akzeptiert vt scan nicht nur URLs, sondern ebenso Domains und IP-Adressen.

Der Parameter --open sorgt dafür, dass vt-cli nach erfolgter Analyse Links zu den generierten VirusTotal-Reports auf der Kommandozeile ausgibt, so dass Sie sich in der gewohnten Webansicht durch die Ergebnisse klicken können. Alternativ dazu können Sie sich aber auch mit --wait alle Resultate direkt ins Terminal schreiben lassen, sobald die Analyse abgeschlossen ist.

Es lohnt in jedem Fall, sich näher mit den verfügbaren und teils auch kombinierbaren Scan-Parametern zu befassen: So schickt etwa --password string (Passwort) das benötigte Kennwort mit, wenn Sie ein geschütztes Schadcode-Archiv an VirusTotal senden. Eine Gesamtübersicht über alle verfügbaren Optionen bieten die vt-cli-Doku-Abschnitte zu scan file [8] und zu scan url [9].

Nun aber zurück zu unserem eingangs beschriebenen Batch-Scan-Szenario. Für den Scan mehrerer Dateien oder auch URLs akzeptiert vt-cli Eingaben nach dem Schema

scan file (Datei 1)(Datei 2)(…)

und

scan url (URL 1)(URL 2)(…).

Noch einfacher lässt sich der Scan eines ganzen Ordners voller verdächtiger Dateien mit folgendem Einzeiler abarbeiten:

vt scan file (Ordnerpfad) --open

(Bild: Screenshot)

Will man wiederum einen ganzen Schwung URLs nacheinander an VirusTotal übermitteln, speichert man diese zunächst in einer Textdatei mit einem Eintrag je Zeile. Das Abarbeiten dieser Liste gelingt dann mit vt-cli und dem Unix-Befehl cat folgendermaßen:

cat (Pfadangabe/URL-Liste) | vt scan url - --open

Dabei schickt vt scan url - den via cat ausgelesenen Dateiinhalt zeilenweise zur Analyse weiter. Im Anschluss liefert --open wie gewohnt zu jeder URL den erzeugten VT-Link zurück.

Sie haben keine Zeit, umfangreiche Analyseberichte zu wälzen und wünschen sich einfach nur eine schnelle Bedrohungseinschätzung auf der Kommandozeile?

In diesem Fall verzichten Sie beim Aufruf von vt scan komplett auf Parameter wie --open oder --wait. Statt VT-Links oder Reports gibt vt-cli dann einfach nur eine Analyse-ID in Gestalt eines Hashes zurück. Diese reichen Sie an den folgenden Befehl weiter:

vt analysis (ID)

Dieser schreibt lediglich die Resultate der Scan-Engines ins Terminal und verzichtet auf Zusatzinformationen wie Verhaltensanalysen oder Community-Kommentare.

(Bild: Screenshot)

Kombiniert mit Unix-Befehlen lässt sich diese Ausgabe noch weiter filtern. Etwa so:

vt analysis (Analyse-ID) | "grep category:" | sort | uniq -c

grep sucht in der Analyse alle Vorkommen des Begriffs „category“. VirusTotal nutzt diesen intern, um die Rückgaben der Scan-Engines in Kategorien wie „harmless“, „malicious“ und „undetected“ einzuordnen und Scanfehler zu protokollieren. sort und uniq -c sortieren die gefundenen Zeilen alphabetisch, zählen deren Vorkommen und entfernen Doppler vor der Ausgabe. Die könnte dann beispielsweise so aussehen:

1 category: "failure"

54 category: "malicious"

6 category: "timeout"

4 category: "type-unsupported"

11 category: "undetected"

Sie wissen jetzt, dass 54 Scanner die Datei oder URL für schädlich halten – eine recht klare Einschätzung. Auf ähnliche Weise gelingt übrigens auch eine schnelle Abfrage der herstellerspezifischen Malware-Aliases nach einem Dateiscan: Ersetzen Sie einfach „category:“ durch „result:“.

Wissenswert für Entwickler: Über die Analyse-IDs sind Scan-Ergebnisse dauerhaft referenzierbar. Somit kann man die IDs auch verwenden, um etwa im Zuge umfangreicher System-Scans Resultate „zwischenzuspeichern“ und weiterzuverarbeiten, statt sie sofort auszugeben.

Wenn ein System mit Schadsoftware infiziert wurde, steht man vor größeren Problemen als nur einer einzelnen infizierten Datei. Im Zuge der Incident Response gilt es, zahlreiche Einbruchsspuren (Indicators of Compromise, IoCs [10]) auszuwerten und sie zueinander in Beziehung zu setzen, um das Geschehen zu rekonstruieren und adäquat darauf reagieren zu können.

Vorhandene VirusTotal-Reports können auch in diesem Zusammenhang eine wertvolle Recherchequelle darstellen. Mit vt-cli zapfen Sie diese ganz nach Bedarf an: Via vt file (Hash), alternativ aber auch mit den Befehlen vt domain (Domain), vt ip (IP-Adresse) und vt url (URL), sofern Ihnen etwa verdächtige Netzwerkaktivitäten oder Informationen aus Firewall-Logs als Ausgangspunkt dienen.

Die große Stärke von Anfragen via vt-cli gegenüber der Suchfunktion auf der VT-Website offenbart sich, wenn man die verfügbaren Befehlsergänzungen nutzt. Statt sich einfach komplette Reports zurückliefern zu lassen, kann man die Suche spezifizieren, um im Zuge der Incident Response wesentliche Fragen zu klären. Hier ein paar Beispiele:

Alle verfügbaren Befehlsergänzungen finden Sie in den Doku-Abschnitten zu vt file [11], vt domain [12], vt ip [13] und vt url [14].

Kommandozeilenaffinität vorausgesetzt, ist vt-cli eine echte Bereicherung für alle, die die gewohnten VirusTotal-Funktionen flexibler und zielgerichteter nutzen wollen. Programmierern können die verfügbaren Befehle das Umsetzen eigener Projekte erleichtern – von stark individualisierten Scans bis hin zu exakt zugeschnittenen Suchanfragen an VT als Wissensdatenbank.

Ein guter Ausgangspunkt, um sich mit den hier angesprochenen sowie weiteren Features vertraut zu machen, ist neben der ausführlichen vt-cli-Doku [15] die via vt help auf der Kommandozeile abrufbare Übersicht über alle Befehle.

Grenzen setzt der Funktionsumfang des kostenlosen API-Keys, der Premium-Features wie etwa Malware-Downloads oder Zugriff auf den „VT Hunting“-Service ausklammert und die Zahl der täglichen VT-Anfragen auf 500 begrenzt.

Diese recht großzügigen Beschränkungen lassen jedoch reichlich Raum für die maßgeschneiderte Malware-Jagd mit vt-cli. Viel Spaß beim Experimentieren!

URL dieses Artikels:

https://www.heise.de/-11176057

Links in diesem Artikel:

[1] https://pro.heise.de/security/?LPID=39555_HS1L0001_27416_999_0&wt_mc=disp.fd.security-pro.security_pro24.disp.disp.disp

[2] https://github.com/VirusTotal/vt-cli/releases/tag/1.2.0

[3] https://github.com/VirusTotal/vt-cli#manual-building

[4] https://www.cygwin.com/

[5] https://docs.virustotal.com/docs/please-give-me-an-api-key

[6] https://learn.microsoft.com/en-us/powershell/module/microsoft.powershell.utility/get-filehash

[7] https://www.eicar.org/download-anti-malware-testfile/

[8] https://virustotal.github.io/vt-cli/doc/vt_scan_file.html

[9] https://virustotal.github.io/vt-cli/doc/vt_scan_url.html

[10] https://www.heise.de/hintergrund/Studiere-deinen-Feind-IoCs-als-Bausteine-einer-effektiven-IT-Verteidigung-9606508.html

[11] https://virustotal.github.io/vt-cli/doc/vt_file.html

[12] https://virustotal.github.io/vt-cli/doc/vt_domain.html

[13] https://virustotal.github.io/vt-cli/doc/vt_ip.html

[14] https://virustotal.github.io/vt-cli/doc/vt_url.html

[15] https://virustotal.github.io/vt-cli/

[16] mailto:o.v.westernhagen@outlook.de

Copyright © 2026 Heise Medien

(Bild: Pincasso/Shutterstock)

In C# 14.0 sind neue automatische Konvertierungen zwischen Arrays und Span

Im Rahmen der Initiative „First-Class Span Types [1]“ sind in C# 14.0 neue automatische Konvertierungen zwischen Arrays und Span<T> sowie ReadOnlySpan<T> enthalten.

Wenn die Klasse Developer von der Basisklasse Person erbt und es ein Array von Developer-Objekten gibt

Developer[] devArray = new Developer[3];dann gab es bisher schon folgende Konvertierungen von Array zu Spans:

Span<Developer> devSpan = devArray;

ReadOnlySpan<Developer> devROSpan = devArray;

ReadOnlySpan<Person> personROSpan = devArray;

In C# 14.0 sind zusätzlich neuerdings folgende Umwandlungen möglich:

ReadOnlySpan<Person> personROSpanFromDevSpan = devSpan;

ReadOnlySpan<Person> personROSpanFromDevROSpan = devROSpan;

Allerdings sind folgende Konvertierungen in C# 14.0 weiterhin nicht erlaubt:

Span<Person> personSpan = devArray;

Span<Person> personSpanFromDevSpan = devSpan;

URL dieses Artikels:

https://www.heise.de/-11192287

Links in diesem Artikel:

[1] https://github.com/dotnet/csharplang/issues/7905

[2] mailto:rme@ix.de

Copyright © 2026 Heise Medien

(Bild: LilKar/Shutterstock.com)

Spring Modulith setzt konsequent auf fachliche, in sich abgeschlossene Module und schafft dafür neue Testmöglichkeiten.

Events sind in Spring Modulith ein zentrales Mittel zur losen Kopplung zwischen Modulen. Sie lassen sich zeitgesteuert auslösen, an externe Systeme weiterreichen und gezielt testen. Nachdem im ersten Teil [1] die fachliche Zerlegung einer Spring Boot-Anwendung in klar abgegrenzte Module im Mittelpunkt stand, geht es nun um weitere Event-Mechanismen sowie um Teststrategien, mit denen sich einzelne Module isoliert und realitätsnah überprüfen lassen.

Das Beispiel des Portals zur Pflanzenpflege hat bislang Events demonstriert, die Aktionen durchführen, nachdem eine fachliche Verarbeitung („Pflanze registriert“) erfolgt ist. Daneben gibt es oft auch Aktionen, die zeitgesteuert ausgeführt werden sollen. Zum Beispiel sollen jeden Monat Rechnungen für alle Kunden erzeugt und verschickt werden. Zeitgesteuerte Aktionen lassen sich in Spring Boot mit der Annotation @Scheduled umsetzen. Dieser wird beispielsweise ein cron-Ausdruck übergeben, der festlegt, wann die annotierte Methode ausgeführt wird. Solche Methoden lassen sich jedoch schwer testen. Im beschriebenen Beispiel müsste der Test zum Erzeugen von Rechnungen die Zeit künstlich setzen, um dafür zu sorgen, dass Spring die zeitgesteuerte Methode aufruft. Zudem ist ein cron-Ausdruck weniger ausdrucksstark, da er Zeitpunkte („jeweils am Monatsersten um 3 Uhr“) aber keine Ereignisse („Monatswechsel ist erfolgt“) angibt.

Mit der Moments-API, als Bestandteil von Spring Modulith, gibt es einen weiteren Weg, wiederkehrende Aktionen auszuführen. Sie besteht aus einer Reihe von Events, die Spring Modulith am Ende eines Zeitraums (z. B. Stunden-, Tages- oder Quartalswechsel) auslöst und die von der Anwendung konsumiert werden können. So lässt sich beispielsweise beim Monatswechsel auf das Event MonthHasPassed reagieren. Die Verarbeitung erfolgt wie bei regulären Events, in einer mit @EventListener annotierten Methode, die als Argument den gewünschten Event-Typen entgegennimmt. Listing 1 zeigt die Verwendung exemplarisch für den InvoiceGenerator, der beim Monatswechsel die Rechnungen erzeugt.

Listing 1: Der InoviceGenerator wird beim Monatswechsel über das MomentHasPassed-Event getriggert

package nh.demo.plantify.billing.invoice;

import org.springframework.context.event.EventListener;

import org.springframework.modulith.moments.MonthHasPassed;

// ...

@Component

class InvoiceGenerator {

// ...

@EventListener

@Transactional

void generateInvoices(MonthHasPassed event) {

var month = event.getMonth();

// Rechnungen für den Monat month erzeugen

// ...

}

}Vorteil an dieser Variante ist, dass der Code mit den Moments Events nicht nur verständlicher ist, als bei der Verwendung von @Scheduler, die Events liefern auch nützliche Informationen (z. B. welcher Monat abgelaufen ist). Das Bean TimeMaschine, das Spring Modulith automatisch im Application Context registriert, löst die Events aus. Für Tests lässt sich deren Zeit künstlich weiterstellen. Alle Events, die normalerweise in diesem vorgespulten Zeitraum ausgelöst würden, werden damit auch im Test ausgelöst.

Die Anwendung nutzt den ApplicationEventPublisher, um fachliche Events innerhalb der Anwendung zu veröffentlichen. Mit Spring Modulith lassen sich darüber Events auch an externe Systeme wie Kafka, RabbitMQ oder einen JMS Server übergeben. Dafür stellt Spring Modulith Broker-spezifische Starter-Module zur Verfügung, die sich über die Maven- oder Gradle-Konfiguration der Anwendung einbinden lassen.

Die Annotation @Externalized an einer Event-Klasse drückt aus, dass das Event an ein externes System geschickt werden soll. Listing 2 zeigt das InvoiceCreatedEvent, das die Anwendung an Kafka schickt. Das target-Attribute enthält einen Broker-spezifischen Ausdruck, der angibt, wie das Event geroutet werden soll. Im Beispiel wird das Event an das Kafka-Topic invoices geschickt, wobei die im Event enthaltene ownerId den Message Key bildet.

Listing 2: Ein Application Event, das über Kafka veröffentlicht wird

package nh.demo.plantify.billing.invoice;

import org.springframework.modulith.events.Externalized;

// ...

@Externalized(target = "invoices::#{#this.ownerId()}")

public record InvoiceGeneratedEvent(

UUID ownerId,

YearMonth billingPeriod,

BigDecimal amount

) { }In der kommenden Version 2.1 [2] implementiert Spring Modulith das Outbox-Pattern für das Versenden von @Externalized-Events. Damit stellt es sicher, dass jedes Event mindestens einmal erfolgreich an das externe System übermittelt wurde. Dazu wird intern das Framework Namastack [3] verwendet, das eine Implementierung des Outbox-Patterns für Spring Boot-Anwendungen bereitstellt. Um das Verhalten für die eigene Anwendung zu aktivieren, muss lediglich eine Spring Property gesetzt werden. Im Rahmen der Ankündigung dieses Features hat sich eine interessante Diskussion [4] über die konkrete Implementierung durch Namastack und deren Konsequenzen zwischen Roland Beisel (Lead von Namastack Outbox) und Gunnar Morling (ehem. Tech-Lead von Debezium) entwickelt.

Bis hierhin lag der Fokus auf der Aufteilung des Java-Codes in abgeschlossene Application Modules. Oft gehören zu einer Anwendung aber auch Migrationsskripte für die Datenbank, die beispielsweise Flyway verwaltet. Spring Boot führt diese beim Starten der Anwendung automatisch aus und sorgt dafür, dass die Datenbank auf einem für die aktuelle Version der Anwendung passenden Stand ist. Typischerweise finden sich die Flyway-Skripte einer Anwendung in einem zentralen migration-Verzeichnis als Dateien mit einer Versionsnummer im Namen. Die zentrale Verwaltung und Versionierung der Migrationsskripte widersprechen allerdings der Idee der Modularisierung.

Aus diesem Grund bietet Spring Modulith die Möglichkeit, die Skripte nicht nur zentral, sondern pro Modul abzulegen und zu versionieren. So kann jedes Modul seine eigene Historie von Migrationsskripten pflegen. Die übergeordnete Reihenfolge ergibt sich aus den Modulabhängigkeiten. Die modulspezifischen Flyway-Dateien gilt es in einem Unterordner abzulegen, der genauso wie das entsprechende Modul heißt. Zusätzlich kommt das Verzeichnis __root zum Einsatz, in dem globale Migrationsskripte ihren Platz finden. Die Anwendung führt die Skripte in diesem Verzeichnis immer als Erstes aus. Abbildung 1 zeigt die Migrationsskripte von Plantify.

(Bild: Nils Hartmann)

Damit die Modulstruktur auch in der Datenbank eingehalten wird, definiert jedes Modul sein eigenes Datenbankschema in Postgres. Im __root-Ordner befinden sich die Skripte zum Anlegen der Tabellen für die Event Publication Registry. In einem Integrationstest führt Spring Modulith immer nur die Skripte aus, deren Modul gerade getestet wird, und stellt damit sicher, dass es keine unerwünschten Referenzen zwischen den Skripten gibt.

Die Plantify-Anwendung ist nun in Module zerlegt, die im Wesentlichen über Events kommunizieren und somit weitgehend unabhängig voneinander sind. Dieser Ansatz führt dazu, dass man neue Features einführen kann, ohne bestehende Module erweitern zu müssen. Ein weiterer Vorteil ergibt sich beim Testen, denn dank dieser Architektur sind Module isoliert testbar.

Dazu stellt Spring Modulith die Annotation @ApplicationModuleTest zur Verfügung, die an eine Testklasse geschrieben wird. Diese Annotation ist eine Art Spezialisierung der bekannten @SpringBootTest-Annotation. Auch @ApplicationModuleTest sorgt dafür, dass der Application Context der Anwendung vor der Ausführung der Testmethoden erzeugt und gestartet wird. Im Gegensatz zu einem @SpringBootTest startet der Test allerdings nur ein einzelnes Modul mit all seinen Beans. Das ist vergleichbar mit Tests, die mit @DataJpaTest oder @JdbcTest annotiert sind. Diese beiden Annotationen definieren und starten allerdings horizontale Slices (z. B. alle Repositories). Ein Application-Module-Test bildet hingegen vertikale Slices, die alle (technischen) Schichten eines Moduls umfassen. Dadurch erhält der Test einen fachlichen Fokus. In der kommenden Version 2.1 von Spring Modulith lassen sich beide Ansätze kombinieren.

Per Default sorgt @ApplicationModuleTest dafür, dass nur das Modul startet, in dessen Package sich die Testklasse befindet. Der Test führt auch nur die Migrationsskripte der Datenbank aus diesem Modul aus. Listing 3 zeigt den Ausschnitt eines Tests, der den PlantController aus dem plant-Modul mit dem aus Spring bekannten MockMvcTester testet.

Listing 3: Ein Integrationstest für ein Application Module

package nh.demo.plantify.care;

import org.springframework.modulith.test.ApplicationModuleTest;

// ...

@ApplicationModuleTest(webEnvironment = RANDOM_PORT)

@AutoConfigureMockMvc

class CareTaskControllerTest {

@Autowired

MockMvcTester mockMvcTester;

@Test

void completes_existing_care_task() {

var result =

mockMvcTester.post()

.uri("/api/care-tasks/{id}/complete", "test-id")

.exchange();

assertThat(result).hasStatus(HttpStatus.OK);

// ...

}

}Der Test funktioniert, obwohl das care-Modul Klassen aus dem plant-Modul (PlantType) verwendet. Anders sieht es aus, wenn man das care-Modul erweitert und nun auch registrierte Beans (z. B. den PlantService) aus dem plant-Modul verwendet. Diese unterschiedlichen Arten der Verwendung gehen auch aus dem Architekturdiagramm hervor, das Spring Modulith für eine Anwendung erzeugen kann. Abbildung 2 stellt das etwas vereinfachte Diagramm für die erweiterte Plantify-Anwendung mit deren Abhängigkeiten dar. Besonders relevant ist „uses“, denn das verdeutlicht die Abhängigkeit zwischen zwei Modulen über Beans. Als dritte Abhängigkeit zeigt das Architekturdiagramm, aus welchen anderen Modulen ein Modul Events empfängt (“listen to“).

(Bild: Nils Hartmann)

Um auch in dieser Konstellation einen Modultest zu schreiben, gibt es mehrere Möglichkeiten. Zum einen lässt sich der PlantService wie in herkömmlichen Spring-Tests durch eine Mock-Bean ersetzen. Alternativ kann man einen Application Module Test auch anweisen, die abhängigen Module ebenfalls zu starten. Im Fall des Tests für das care-Modul bedeutet das, dass die Anwendung das plant-Modul ebenfalls startet, inklusive seiner Datenbankskripte. Kommt es in einer Anwendung öfter vor, dass sich ein Modul nicht isolieren lässt, deutet das möglicherweise auf eine zu enge Kopplung zwischen den Modulen hin.

Spring Modulith forciert das Arbeiten mit Events zur Entkopplung und Kommunikation zwischen Modulen. Aus diesem Grund ist es wichtig, in Testfällen zu prüfen, ob die Events korrekt verarbeitet und versendet werden. Das ist allerdings nicht trivial, da die Events asynchron und erst nach abgeschlossener Transaktion versendet werden.

Spring Modulith vereinfacht das Testen von Events mit mehreren Werkzeugen. Die Klasse AssertablePublishedEvents ermöglicht es, Events zu überprüfen, die in einem Test versendet werden. Listing 4 zeigt eine Erweiterung des zuvor vorgestellten Testfalls für den CareTaskController. In dieser erweiterten Variante stellt der Test sicher, dass beide erwarteten Events tatsächlich veröffentlicht wurden. Die Methode contains prüft, ob ein Event der angegebenen Klasse publiziert wurde, und mit matching wird die konkrete Instanz anschließend gezielt überprüft.

Listing 4: Veröffentlichte Events werden im Test überprüft

@ApplicationModuleTest(webEnvironment = RANDOM_PORT)

@AutoConfigureMockMvc

class CareTaskControllerTest {

@Test

void completes_existing_care_task(AssertablePublishedEvents events

) {

var result = mockMvcTester.post(); // ...

assertThat(result).hasStatus(HttpStatus.OK);

assertThat(events)

.contains(CareTaskCompletedEvent.class)

.matching(CareTaskCompletedEvent::careTaskId, "test-id-1")

.and()

.contains(CareTaskDeactivatedEvent.class)

.matching(CareTaskDeactivatedEvent::careTaskId, "test-id-1");

}

}Insgesamt unterscheidet sich das Testen bis hierher wenig von den aus Spring Boot-Tests bekannten Prinzipien. Etwas anders sieht es bei den Szenario-Tests aus. Dabei geht es darum, durch ein Event oder einen anderen Trigger einen Use Case auszulösen, den die Anwendung asynchron abarbeitet. Als Beispiel dient an dieser Stelle der CareTaskService, der das PlantRegisteredEvent verarbeitet und bei Erfolg das Event InitialCareTasksCreatedEvent auslöst. Das realistische Testen dieses Anwendungsfalls ist nicht ganz trivial. Die Veröffentlichung des Events muss in einer Transaktion passieren, da sonst der Event Listener nicht aufgerufen wird. Die Verarbeitung selbst erfolgt dann asynchron, weshalb der Test so lange darauf warten muss, bis das Ergebnis vorliegt. Dazu gibt es zwar Werkzeuge wie die Bibliothek Awaitility, aber beide Aufgaben lassen sich mit einem Szenario-Test von Spring Modulith noch weiter vereinfachen (Listing 5).

Listing 5: In einem Szenario-Test wird die Verarbeitung eines Events getestet

package nh.demo.plantify.care;

import org.springframework.modulith.test.Scenario;

// ...

@ApplicationModuleTest

@Import(TestcontainersConfiguration.class)

class CareTaskServiceTest {

@Autowired

CareTaskRepository careTaskRepository;

@Test

void creates_initial_tasks_for_new_plant(Scenario scenario) {

scenario

.publish(

new PlantRegisteredEvent( /* ... */ )

)

.andWaitForEventOfType(InitialCareTasksCreatedEvent.class)

.matching(e -> e.plantId().equals("p1"))

.toArrive();

// Event wurde versendet, Verarbeitung ist abgeschlossen

// Jetzt DB überprüfen

assertThat(careTaskRepository.findAll())

.satisfiesExactlyInAnyOrder(/* ... */);

}

}Eine Instanz der dafür notwendigen Scenario-Klasse übergibt Spring Modulith direkt an die Testmethode. publish veröffentlicht ein Event in ähnlicher Weise wie im Anwendungscode. Mit der Methode andWaitForEventOfType wartet die weitere Testausführung, bis das angegebene Event veröffentlicht wurde. Die matching-Methode erlaubt es, die Instanz des erwarteten Events noch weiter zu überprüfen. Nachdem das Event empfangen wurde, wird die Testausführung fortgesetzt. Im Beispiel prüfen die Tests mit den gewohnten Testmitteln aktiv, ob die Anwendung die Datenbank korrekt aktualisiert hat.

Anwendungsfällen, die nicht mit einem Event starten, sondern beispielsweise mit einem Serviceaufruf, oder die kein Event auslösen, stehen ähnliche Methoden an der Scenario-Klasse zur Verfügung, mit denen sich die Aktionen auslösen und (asynchron) erhaltene Ergebnisse prüfen lassen. Das ermöglicht das Implementieren realistischer Testfälle auf einfache Weise.

Listing 6 zeigt diese API am Beispiel eines Modul-Tests für den InvoiceGenerator, der im billing-Modul liegt. Die Events der Moments API triggern den InvoiceGenerator und dieser erzeugt bei jedem Monatswechsel Rechnungen für die Kunden und verschickt sie über Kafka. Der Test setzt die aktuelle Zeit auf den 29. November fest. Anschließend stellt er die Zeit mit der TimeMachine der Moments API um zwei Tage vor und verschiebt sie damit in den Dezember, sodass ein fiktiver Monatswechsel entsteht. Das triggert die Verarbeitung im InvoiceGenerator, der nun die Rechnungen für den November erzeugt und jede erstellte Rechnung über Kafka veröffentlicht. Mit waitForStateChange wartet der Test zunächst darauf, dass eine Liste von Kafka‑Messages vorliegt, und untersucht diese anschließend mit andVerify im Detail.

Listing 6: Eine Zeitverschiebung löst den Szenario-Test aus

package nh.demo.plantify.billing.invoice;

import org.springframework.modulith.moments.support.TimeMachine;

import org.springframework.modulith.test.ApplicationModuleTest;

import org.springframework.modulith.test.Scenario;

// ...

@ApplicationModuleTest@Import(TestcontainersConfiguration.class)

@TestPropertySource(properties = {

"spring.modulith.moments.enable-time-machine=true",

})

class InvoiceGeneratorTest {

// Kafka-Setup etc. ausgelassen

@Autowired

TimeMachine timeMachine;

@TestConfiguration

static class Config {

@Bean

Clock clock() {

Clock clock = Clock.fixed(

Instant.parse("2025-11-29T08:15:00.00Z"),

ZoneId.of("Europe/Berlin")

);

return clock;

}

}

@Test

void invoice_is_created_ and_send_to_kafka(Scenario scenario) {

scenario

.stimulate(() -> {

timeMachine.shiftBy(Duration.ofDays(2));

})

.andWaitForStateChange(() -> {

if (recordedKafkaMessages.isEmpty()) {

return null;

}

return recordedKafkaMessages;

})

.andVerify(messages -> {

assertThat(messages)

.containsExactlyInAnyOrder( /* ... */ )

});

}

}Spring Modulith erweitert Spring Boot um die Möglichkeit, Anwendungen in isolierte und gut entkoppelte Module zu zerteilen und gleichzeitig die Architekturregeln eines Projekts kontinuierlich zu überprüfen, deren Einhaltung sicherzustellen und so den gefürchteten Big Ball of Mud zu verhindern. Damit schließt es eine Lücke im Spring-Ökosystem. Für Projekte, die auf eine nachhaltige und tragfähige Architektur setzen wollen, bietet Spring Modulith eine interessante Alternative zu Microservices, die zwar eine noch höhere Entkopplung bieten, im Alltag aber auch viele Herausforderungen in Entwicklung und Betrieb mit sich bringen. Stellt sich im Laufe der Entwicklung heraus, dass die Möglichkeiten von Spring Modulith nicht ausreichen, zum Beispiel, weil separate Deployments einzelner Teile der Anwendung erforderlich sind, ist mit dem klar strukturierten Modulithen bereits eine gute Grundlage für die Weiterentwicklung in Microservices gegeben.

URL dieses Artikels:

https://www.heise.de/-11188766

Links in diesem Artikel:

[1] https://www.heise.de/hintergrund/Deep-Dive-Spring-Modulith-Teil-1-Fachliche-Module-im-Fokus-11179349.html

[2] https://spring.io/blog/2026/02/19/spring-modulith-2-1-m2-2-0-3-and-1-4-8-released

[3] https://outbox.namastack.io/

[4] https://www.linkedin.com/posts/odrotbohm_event-externalization-through-an-outbox-coming-activity-7429900523161567233-nN9o

[5] https://microservices.io/patterns/data/transactional-outbox.html

[6] https://spring.bettercode.eu/?wt_mc=intern.academy.dpunkt.konf_dpunkt_bcc_spring.empfehlung-ho.link.link&LPID=34171

[7] mailto:mdo@ix.de

Copyright © 2026 Heise Medien

Alle Details zur Störungsmeldung ansehen Eigene Internetstörung melden

(Bild: Lee Charlie/Shutterstock.com)

Batch-Scans mehrerer verdächtiger Dateien und passgenaue Malware-Recherchen zur Incident Response: Mit dem Gratis-Tool vt-cli folgt VirusTotal Ihrem Kommando.

Googles Online-Dienst VirusTotal (VT) ist die wohl beliebteste Anlaufstelle für Malware-Scans durch Privatanwender wie auch Profis. Über das Webinterface kann man einzelne Dateien oder verdächtige URLs mit wenigen Klicks übermitteln. VT durchleuchtet sie mit Scan-Engines mehrerer Anbieter, führt zusätzlich dynamische und statische Analysen durch und bündelt alle Informationen in einem ausführlichen Report.

Jenseits einfacher Anwendungsfälle stößt die grafische Oberfläche des Dienstes jedoch schnell an ihre Grenzen. Zum Beispiel dann, wenn Sie bei akutem Schadcode-Befall möglichst zügig nicht nur eine einzelne Datei, sondern gleich den Inhalt eines ganzen Ordners scannen wollen. Oder wenn Sie im Zuge einer Kompromittierung wissen möchten, ob einige der verdächtigen IP-Adressen aus Ihren Logfiles bereits bei früheren VT-Analysen aufgetaucht sind.

Das „VirusTotal Command-Line Interface“, kurz: vt-cli erspart Ihnen in solchen Situationen zeitraubende Einzel-Uploads beziehungsweise -Suchanfragen. Das auf der Kommandozeile basierende Hilfstool entkoppelt die VirusTotal-Funktionen vom Webinterface, indem es direkt auf das zugrundeliegende API zugreift. So können Sie mittels einfacher Terminal-Befehle die von VT gewohnten Scan- und Suchfunktionen nutzen und überdies den Output Ihren individuellen Bedürfnissen anpassen.

Wie Sie mit dem für Linux, Windows und macOS verfügbaren Gratis-Tool schnelle Batch-Scans umsetzen, Ergebnisse filtern und die VT-Plattform gezielt nach relevanten Bedrohungsinformationen durchsuchen können, erklärt dieser Artikel. Außerdem vermittelt er einen ersten Eindruck davon, wie Entwickler vt-cli zum Skripten von VirusTotal-Abfragen nutzen können, ohne sich mit Interna der Programmierschnittstelle zu befassen.

vt-cli ist ein offizielles VirusTotal-Projekt, dessen Quellcode bei GitHub gehostet wird. Am schnellsten bringt man es auf dem eigenen System zum Laufen, indem man auf die fertig kompilierten Binaries zurückgreift. Die stehen zum Veröffentlichungszeitpunkt dieses Artikels in Version 1.2.0 zum Download bereit [2].

Eine Installation ist nicht notwendig: Nach dem Extrahieren der Standalone-Anwendung „vt“ kopieren Sie diese einfach in das gewünschte Verzeichnis und starten sie mit dem Kommandozeilenbefehl vt init. In unserem Testdurchlauf mit Windows 11 sowie mit einer frischen Installation des Debian-basierten Kali Linux in VirtualBox klappte das jeweils problemlos. Wer das in der Sprache Go programmierte Projekt lieber selbst kompilieren möchte, folgt der Kurzanleitung in der Readme.MD [3].

(Bild: Screenshot)

In der vt-cli-Dokumentation tummeln sich Anwendungsbeispiele, die die bereitgestellten VirusTotal-Funktionen auf clevere und praktische Weise mit Unix-Befehlen wie cat oder grep kombinieren. Um diese Beispiele unverändert unter Windows übernehmen zu können, raten die vt-cli-Entwickler zur zusätzlichen Installation der freien Laufzeitumgebung Cygwin [4]. Das Cygwin-Terminal versteht Unix-Befehle und bietet laut vt-cli-Team zudem Performance-Vorteile gegenüber der Standard-Windows-Konsole bei der Ausgabe großer Textmengen.

Nach dem ersten Aufruf von vt-cli via vt init fragt das Tool nach einem VirusTotal-API-Key. Einen solchen können Sie in der Ausführung „standard free public“ kostenlos von der VT-Website beziehen [5]. Dort legen Sie zunächst einen Account an, loggen sich ein und klicken dann oben rechts auf Ihren Benutzernamen.

(Bild: VirusTotal / Screenshot)

Über den Menüpunkt „API Key“ sind der kostenlose Schlüssel wie auch Informationen zu den Nutzungsbedingungen und -beschränkungen abrufbar. Insbesondere die Aufforderung, den Schlüssel vor unbefugtem Zugriff zu schützen, sollten Sie dringend beherzigen: Bösewichte missbrauchen gestohlene Keys gern für massenhafte Anfragen, um etwa Verschleierungstaktiken ihres Schadcodes zu testen. Im schlimmsten Fall führt derlei Missbrauch zur Sperrung des Schlüssels.

Nach einmaliger Übergabe des Keys an vt-cli speichert das Tool diesen dauerhaft in einer Konfigurationsdatei im Home- beziehungsweise Benutzerverzeichnis Ihres Systems. Nun ist vt-cli startklar.

An dieser Stelle noch ein wichtiger Hinweis: Wenn Sie Dateien mit Ihrem kostenlosen API-Key zu VT hochladen, sind die Resultate dauerhaft online abrufbar – und zwar für alle Nutzer. Achten Sie deshalb unbedingt darauf, keine Dokumente vertraulichen Inhalts zu übermitteln.

Falls Sie bei einer bestimmten verdächtigen Datei unsicher sind, ob Ihr Upload nicht doch ein Datenschutzproblem darstellen könnte, bietet sich ein Alternativweg an: Mit vt file (Dateihash) starten Sie eine Suchanfrage auf der VT-Plattform. Ist die Datei dort bereits bekannt und ein Report vorhanden, gibt Ihnen vt-cli dessen Inhalt im Terminal aus.

Für die Anfrage benötigen Sie den SHA-256-, SHA-1- oder MD5-Hash Ihrer verdächtigen Datei. Den ermitteln Sie unter Linux ganz einfach mit Kommandozeilen-Tools wie sha256sum, sha1sum und md5sum. Unter Windows können Sie etwa das PowerShell-Cmdlet Get-FileHash [6] nutzen.

Um ein wenig mit den Scan-Funktionen zu experimentieren genügt es im Zweifel, schnell ein paar harmlose Testdateien zusammenzustellen oder alternativ auf die EICAR-Testdatei [7]zurückzugreifen.

Eine Analyse werfen Sie ganz einfach mit

vt scan file (Pfadangabe/Dateiname) --open

beziehungsweise

vt scan url (URL) --open

an. Dabei akzeptiert vt scan nicht nur URLs, sondern ebenso Domains und IP-Adressen.

Der Parameter --open sorgt dafür, dass vt-cli nach erfolgter Analyse Links zu den generierten VirusTotal-Reports auf der Kommandozeile ausgibt, so dass Sie sich in der gewohnten Webansicht durch die Ergebnisse klicken können. Alternativ dazu können Sie sich aber auch mit --wait alle Resultate direkt ins Terminal schreiben lassen, sobald die Analyse abgeschlossen ist.

Es lohnt in jedem Fall, sich näher mit den verfügbaren und teils auch kombinierbaren Scan-Parametern zu befassen: So schickt etwa --password string (Passwort) das benötigte Kennwort mit, wenn Sie ein geschütztes Schadcode-Archiv an VirusTotal senden. Eine Gesamtübersicht über alle verfügbaren Optionen bieten die vt-cli-Doku-Abschnitte zu scan file [8] und zu scan url [9].

Nun aber zurück zu unserem eingangs beschriebenen Batch-Scan-Szenario. Für den Scan mehrerer Dateien oder auch URLs akzeptiert vt-cli Eingaben nach dem Schema

scan file (Datei 1)(Datei 2)(…)

und

scan url (URL 1)(URL 2)(…).

Noch einfacher lässt sich der Scan eines ganzen Ordners voller verdächtiger Dateien mit folgendem Einzeiler abarbeiten:

vt scan file (Ordnerpfad) --open

(Bild: Screenshot)

Will man wiederum einen ganzen Schwung URLs nacheinander an VirusTotal übermitteln, speichert man diese zunächst in einer Textdatei mit einem Eintrag je Zeile. Das Abarbeiten dieser Liste gelingt dann mit vt-cli und dem Unix-Befehl cat folgendermaßen:

cat (Pfadangabe/URL-Liste) | vt scan url - --open

Dabei schickt vt scan url - den via cat ausgelesenen Dateiinhalt zeilenweise zur Analyse weiter. Im Anschluss liefert --open wie gewohnt zu jeder URL den erzeugten VT-Link zurück.

Sie haben keine Zeit, umfangreiche Analyseberichte zu wälzen und wünschen sich einfach nur eine schnelle Bedrohungseinschätzung auf der Kommandozeile?

In diesem Fall verzichten Sie beim Aufruf von vt scan komplett auf Parameter wie --open oder --wait. Statt VT-Links oder Reports gibt vt-cli dann einfach nur eine Analyse-ID in Gestalt eines Hashes zurück. Diese reichen Sie an den folgenden Befehl weiter:

vt analysis (ID)

Dieser schreibt lediglich die Resultate der Scan-Engines ins Terminal und verzichtet auf Zusatzinformationen wie Verhaltensanalysen oder Community-Kommentare.

(Bild: Screenshot)

Kombiniert mit Unix-Befehlen lässt sich diese Ausgabe noch weiter filtern. Etwa so:

vt analysis (Analyse-ID) | "grep category:" | sort | uniq -c

grep sucht in der Analyse alle Vorkommen des Begriffs „category“. VirusTotal nutzt diesen intern, um die Rückgaben der Scan-Engines in Kategorien wie „harmless“, „malicious“ und „undetected“ einzuordnen und Scanfehler zu protokollieren. sort und uniq -c sortieren die gefundenen Zeilen alphabetisch, zählen deren Vorkommen und entfernen Doppler vor der Ausgabe. Die könnte dann beispielsweise so aussehen:

1 category: "failure"

54 category: "malicious"

6 category: "timeout"

4 category: "type-unsupported"

11 category: "undetected"

Sie wissen jetzt, dass 54 Scanner die Datei oder URL für schädlich halten – eine recht klare Einschätzung. Auf ähnliche Weise gelingt übrigens auch eine schnelle Abfrage der herstellerspezifischen Malware-Aliases nach einem Dateiscan: Ersetzen Sie einfach „category:“ durch „result:“.

Wissenswert für Entwickler: Über die Analyse-IDs sind Scan-Ergebnisse dauerhaft referenzierbar. Somit kann man die IDs auch verwenden, um etwa im Zuge umfangreicher System-Scans Resultate „zwischenzuspeichern“ und weiterzuverarbeiten, statt sie sofort auszugeben.

Wenn ein System mit Schadsoftware infiziert wurde, steht man vor größeren Problemen als nur einer einzelnen infizierten Datei. Im Zuge der Incident Response gilt es, zahlreiche Einbruchsspuren (Indicators of Compromise, IoCs [10]) auszuwerten und sie zueinander in Beziehung zu setzen, um das Geschehen zu rekonstruieren und adäquat darauf reagieren zu können.

Vorhandene VirusTotal-Reports können auch in diesem Zusammenhang eine wertvolle Recherchequelle darstellen. Mit vt-cli zapfen Sie diese ganz nach Bedarf an: Via vt file (Hash), alternativ aber auch mit den Befehlen vt domain (Domain), vt ip (IP-Adresse) und vt url (URL), sofern Ihnen etwa verdächtige Netzwerkaktivitäten oder Informationen aus Firewall-Logs als Ausgangspunkt dienen.

Die große Stärke von Anfragen via vt-cli gegenüber der Suchfunktion auf der VT-Website offenbart sich, wenn man die verfügbaren Befehlsergänzungen nutzt. Statt sich einfach komplette Reports zurückliefern zu lassen, kann man die Suche spezifizieren, um im Zuge der Incident Response wesentliche Fragen zu klären. Hier ein paar Beispiele:

Alle verfügbaren Befehlsergänzungen finden Sie in den Doku-Abschnitten zu vt file [11], vt domain [12], vt ip [13] und vt url [14].

Kommandozeilenaffinität vorausgesetzt, ist vt-cli eine echte Bereicherung für alle, die die gewohnten VirusTotal-Funktionen flexibler und zielgerichteter nutzen wollen. Programmierern können die verfügbaren Befehle das Umsetzen eigener Projekte erleichtern – von stark individualisierten Scans bis hin zu exakt zugeschnittenen Suchanfragen an VT als Wissensdatenbank.

Ein guter Ausgangspunkt, um sich mit den hier angesprochenen sowie weiteren Features vertraut zu machen, ist neben der ausführlichen vt-cli-Doku [15] die via vt help auf der Kommandozeile abrufbare Übersicht über alle Befehle.

Grenzen setzt der Funktionsumfang des kostenlosen API-Keys, der Premium-Features wie etwa Malware-Downloads oder Zugriff auf den „VT Hunting“-Service ausklammert und die Zahl der täglichen VT-Anfragen auf 500 begrenzt.

Diese recht großzügigen Beschränkungen lassen jedoch reichlich Raum für die maßgeschneiderte Malware-Jagd mit vt-cli. Viel Spaß beim Experimentieren!

URL dieses Artikels:

https://www.heise.de/-11176057

Links in diesem Artikel:

[1] https://pro.heise.de/security/?LPID=39555_HS1L0001_27416_999_0&wt_mc=disp.fd.security-pro.security_pro24.disp.disp.disp

[2] https://github.com/VirusTotal/vt-cli/releases/tag/1.2.0

[3] https://github.com/VirusTotal/vt-cli#manual-building

[4] https://www.cygwin.com/

[5] https://docs.virustotal.com/docs/please-give-me-an-api-key

[6] https://learn.microsoft.com/en-us/powershell/module/microsoft.powershell.utility/get-filehash

[7] https://www.eicar.org/download-anti-malware-testfile/

[8] https://virustotal.github.io/vt-cli/doc/vt_scan_file.html

[9] https://virustotal.github.io/vt-cli/doc/vt_scan_url.html

[10] https://www.heise.de/hintergrund/Studiere-deinen-Feind-IoCs-als-Bausteine-einer-effektiven-IT-Verteidigung-9606508.html

[11] https://virustotal.github.io/vt-cli/doc/vt_file.html

[12] https://virustotal.github.io/vt-cli/doc/vt_domain.html

[13] https://virustotal.github.io/vt-cli/doc/vt_ip.html

[14] https://virustotal.github.io/vt-cli/doc/vt_url.html

[15] https://virustotal.github.io/vt-cli/

[16] mailto:o.v.westernhagen@outlook.de

Copyright © 2026 Heise Medien

Die Oral-B iO elektrische Zahnbürste wird mit allem geliefert, was für eine gründliche Zahnpflege zu Hause oder unterwegs nötig ist. Dazu gehören drei Aufsteckbürsten – für die ultimative Reinigung, für sanfte Pflege oder für ein strahlendes Weiß – ein Reise-Etui, ein Aufsteckbürstenhalter und eine Ladestation mit Tasche. Auch auf Reisen ist die Ausstattung praktisch, da Bürsten und Zubehör übersichtlich verstaut werden können.

Laut Hersteller entfernt die Bürste bis zu 100 Prozent mehr Plaque und reinigt 160 Prozent effektiver zwischen den Zähnen als eine Handzahnbürste. Das fällt besonders morgens auf, wenn wenig Zeit bleibt. Selbst schwer erreichbare Stellen werden zuverlässig sauber. Auch nach einem Snack oder Kaffee ist das Zahnfleisch geschützt.

Für Menschen mit empfindlichem Zahnfleisch oder Personen, die schon einmal Zahnfleischentzündungen hatten, kann die konsequente und sanfte Reinigung ein echter Vorteil sein. Selbst ein kurzer Einsatz der Bürste sorgt dafür, dass sich die Zähne glatt und gründlich sauber anfühlen.

Die Verbindung mit der Oral-B App bietet zusätzliches Feedback in Echtzeit. Künstliche Intelligenz analysiert die Putztechnik und gibt Hinweise auf zu starken oder zu schwachen Druck. Die Andruckkontrolle zeigt Rot bei zu viel Druck, Weiß bei zu wenig und Grün bei optimalem Druck. Besonders bei Menschen mit empfindlichem Zahnfleisch oder bei Kindern kann diese Funktion helfen, zu starken Druck zu vermeiden. So wird das Putzen effektiver, ohne dass das Zahnfleisch unnötig belastet wird.

Die Bürste verfügt über fünf Putzprogramme, die unterschiedliche Bedürfnisse abdecken. Die tägliche Reinigung sorgt für eine solide Routine, das intensive Programm entfernt hartnäckige Beläge, während sensitiv und super sensitiv besonders sanft zum Zahnfleisch sind. Das Aufhellprogramm kann nach Kaffee oder Tee helfen, Verfärbungen vorzubeugen. Der integrierte 2-Minuten-Timer vibriert alle 30 Sekunden und erinnert daran, die Bürste gleichmäßig zu verwenden.

Zusätzlich gibt es eine Erinnerung für den Wechsel des Bürstenkopfs, so dass die Bürste langfristig effizient bleibt. Gerade für Menschen, die oft vergessen, wann der letzte Wechsel war, ist das praktisch.

Die runden Bürstenköpfe erreichen Stellen, die bei herkömmlichen Zahnbürsten oft unzugänglich bleiben. Zusammen mit dem langlebigen Lithium-Ionen-Akku lässt sich die Bürste zuverlässig zu Hause oder unterwegs nutzen. Auf Reisen, im Hotelzimmer oder beim kurzen Putzen nach dem Sport funktioniert sie genauso gut wie in der morgendlichen Routine. Der Akku hält lange und reduziert das ständige Nachladen, was gerade bei hektischen Morgenroutinen angenehm ist.

Die elektrische Zahnbürste von Oral-B kostet momentan nur noch 99,99 Euro bei Amazon. Sie kommt inklusive drei verschiedener Aufsteckbürsten und einem Reise-Etui.

Reklame

Oral-B iO Series 5 Plus Edition Elektrische Zahnbürste ; Electric Toothbrush, Inkl. 3 Aufsteckbürsten, 5 Putzmodi für Zahnpflege, Reise-Etui ; Zahnbürste Elektrisch, Designed by Braun, Schwarz

50 % Rabatt sichernWeitere elektrische Zahnbürsten im Angebot gibt es hier.

Dieser Artikel enthält sogenannte Affiliate-Links. Wenn Sie die Produkte über diese Links kaufen, erhält Golem eine kleine Provision. Dies hat keinen Einfluss auf den Preis der Artikel.

Sony bringt in den kommenden Wochen eine überarbeitete Version des KI-Upscalers PSSR (Playstation Spectral Super Resolution) auf die Playstation 5 Pro.

Wie Chefarchitekt Mark Cerny im Firmenblog schreibt, analysiert die Technik die Spielebilder weiterhin Pixel für Pixel, setzt jedoch auf ein grundlegend neues neuronales Netzwerk und einen angepassten Algorithmus. Ziel ist es laut Cerny, Bildschärfe und Bildrate gleichzeitig zu verbessern.

Den Auftakt macht Resident Evil Requiem. Capcom zufolge werden damit besonders feine Details wie einzelne Haarsträhnen oder komplexe Lichtbrechungen präziser hochskaliert als mit dem Vorgänger-Upscaler.

Gerade solche Strukturen gelten als schwierig, weil sie beim klassischen Hochskalieren zu Flimmern oder Detailverlust neigen. Die überarbeitete Variante soll diese Informationen stabiler rekonstruieren und so die visuelle Qualität bei hohen Bildraten sichern.

Technisch basiert die neue Implementierung auf Erkenntnissen aus Project Amethyst, einer Kooperation mit AMD. Dessen Upscaling-Technik FSR 4 kommt bereits am PC zum Einsatz. Für die PS5 Pro wurde der Ansatz laut Sony weiter angepasst und über mehrere Monate optimiert – die Details stellte Cerny im Oktober 2025 zusammen mit AMD vor .

Anders als einfache Skalierungsverfahren kombiniert PSSR temporale Bilddaten, Bewegungsinformationen und ein trainiertes KI-Modell, um aus niedriger gerenderten Auflösungen ein möglichst natives 4K-Bild zu erzeugen.

Außerdem kündigte Sony für März 2026 ein Systemsoftware-Update an. In den Einstellungen der PS5 Pro lässt sich dann Enhance PSSR Image Quality aktivieren. Damit profitieren auch bestehende PSSR-kompatible Titel von der neuen Variante, ohne dass Entwickler zwingend eigene Patches bereitstellen müssen.

Sony verspricht teils sichtbar schärfere Darstellungen, konkrete Leistungsdaten nannte das Unternehmen jedoch nicht. Im März soll es für eine Reihe von Spielen außerdem Updates für die PS5 Pro geben, konkrete Titel wurden aber nicht genannt.

Anfang Februar hat Discord neue Maßnahmen zur Altersverifikation angekündigt . Ab März müssen alle Nutzer ihr Alter zweifelsfrei nachweisen, um zu verhindern, dass ihre Accounts eingeschränkt werden. Eine der Möglichkeiten dafür sollte ein Scan des Gesichts sein.

Die Nachricht sorgte schnell für eine Menge Kritik. Viele User wiesen auf wichtige Datenschutzfragen hin und kündigten an, der Plattform den Rücken zu kehren. Mittlerweile hat Discord die Thematik weiter präzisiert und den Rollout der Maßnahmen deutlich nach hinten verschoben .

90 Prozent der aktuellen Nutzer müssen demnach überhaupt nichts ändern, um Discord weiterzunutzen wie bisher. Die übrigen zehn Prozent sollen die Möglichkeit bekommen, ihr Alter nachzuweisen, ohne ihre Identität preisgeben zu müssen. Es kann der Eindruck entstehen, dass Discord unter dem Druck der User eingeknickt ist. Die Daten zeichnen aber ein anderes Bild.

Ein gängiges Narrativ der vergangenen Wochen war, dass Discord-Alternativen wie das gute alte Teamspeak von einem regelrechten Ansturm von Discord-Nutzern an die Grenzen der Belastbarkeit getrieben werden. Man konnte das Gefühl bekommen, dass Discord massenhaft Nutzer verlieren könnte.

Ein Blick auf die Daten von Google Trends zeigt, dass am 10. Februar 2026 weltweit das Interesse an Alternativen zu Discord geradezu explodiert ist. Sieht man sich die Kurve zur Suche nach "Discord Alternative" an, wird klar, dass die Ankündigung zumindest kurzzeitig einen klar sichtbaren Effekt hatte:

.jpg)

Zu den größten und am meisten empfohlenen Alternativen zu Discord gehören das schon angesprochene Teamspeak, Stoat (ehemals Revolut), Mumble und Nextcloud Talk. Auch bei diesen Suchbegriffen lässt sich ein deutlicher Anstieg des Interesses ab dem 10. Februar erkennen, wobei Teamspeak und Stoat nochmal klar vor den anderen Alternativen liegen:

.jpg)

Die angesprochenen Daten suggerieren, dass Discord möglicherweise wirklich ein entscheidender taktischer Fehler unterlaufen ist, der der Plattform deutlichen Schaden zugefügt hat. Fügt man den Alternativen aber den Suchbegriff "Discord" hinzu, zeigt sich ein ganz anderes Bild:

.jpg)

Um den zuvor so klaren Ausschlag des Interesses an den Alternativen zu erkennen, braucht es schon fast eine Lupe. Auch sonst ist maximal ein kleiner Anstieg des Interesses an Discord selbst zu erkennen. Nichtsdestotrotz hat sich die Kritik offenbar gelohnt, da Discord die Pläne tatsächlich angepasst und verschoben hat. Die Angst vor einem Exodus dürfte dabei aber wohl nur eine sehr kleine Rolle gespielt haben.

Dieser Inhalt ist Teil einer bezahlten Partnerschaft mit Google zur Förderung von Google Trends.

Alle Details zur Störungsmeldung ansehen Eigene Internetstörung melden

Luftschläge gegen den Iran bergen die Gefahr einer größeren Eskalation, meint unser Gastautor

(Bild: Orlok/Shutterstock.com)

Trump setzt vermutlich auf Luftschläge gegen Iran. Doch die Geschichte zeigt: Bomben brechen selten den Willen, die Rechnung geht nicht auf. Ein Gastbeitrag.

In den vergangenen Wochen hat US-Präsident Donald Trump eine große Armada der US-Marine und der US-Luftstreitkräfte in die Nähe des Irans entsandt [1], um die Islamische Republik dazu zu zwingen, ein Abkommen zu unterzeichnen, das überwiegend die Interessen der USA begünstigt.

Diese Verbände trafen unter ausdrücklichen und öffentlichen Warnungen [2] ein. Man solle nachgeben und "Onkel" sagen – andernfalls drohe eine Bestrafung aus der Luft.

Unterdessen verhandeln iranische und US-amerikanische Diplomaten indirekt im Oman. Ein weiteres Treffen ist für Donnerstag geplant, um eine diplomatische Lösung für das iranische Atomprogramm zu finden. Die USA verlangen, dass der Iran sein Urananreicherungsprogramm demontiert und aufgibt, während Teheran weiterhin darauf beharrt, seine Rechte gemäß Artikel IV des Atomwaffensperrvertrags (NPT) wahrzunehmen.

Was sich derzeit abspielt, trägt die Kennzeichen einer Kanonenbootdiplomatie des 21. Jahrhunderts, bei der See- und Luftmacht nicht nur als Abschreckung, sondern als Instrumente erzwingender Verhandlungsführung eingesetzt werden.

Zum Zeitpunkt der Abfassung dieses Textes hat Trump begrenzte Luftschläge erörtert, um den Iran zur Unterzeichnung eines Abkommens zu bewegen. Andernfalls drohten größere Kampagnen gegen "Regimeeinrichtungen", die möglicherweise das Ziel haben, die Islamische Republik zu stürzen.

Einige Berichte [4] deuten zudem darauf hin, dass ein mögliches Szenario ein direkter Schlag gegen den Obersten Führer, Ajatollah Chamenei, und seinen Sohn Mojtaba sein könnte.

Die Logik hinter Trumps Überlegungen ist geradlinig: Er geht davon aus, dass die iranische Führung nach dem im Juni 2025 gemeinsam mit Israel geführten Krieg gegen den Iran und angesichts der jüngsten massiven Proteste im Land, während sie gleichzeitig mit mehreren Krisen ringt, verzweifelt auf ein Abkommen angewiesen ist.

Doch Trumps Annahme beruht auf einer vertrauten, aber fehlerhaften strategischen Prämisse: dass Luftkampagnen ein wirksames Mittel seien, um gegnerische Staaten zur Unterwerfung zu zwingen oder – im Falle der US-Politik gegenüber dem Iran – der Islamischen Republik ein Ende zu bereiten.

Diese Annahme knüpft an eine lange Tradition von Luftkriegsdoktrinen an, die bis zu Giulio Douhet [5] zurückreicht. Douhet vertrat im frühen 20. Jahrhundert die Vorstellung, dass das Bombardieren von Städten die Moral breche und Regierungen zur politischen Kapitulation zwingen könne.

Für Präsidenten, die langwierige Bodenkriege scheuen, erscheint die Luftmacht oft als Möglichkeit, entschlossen zu handeln, während gleichzeitig amerikanische Verluste und langfristige Verpflichtungen minimiert werden. Seit seinem Amtsantritt im Januar 2025 hat Trump den Iran, den Irak, den Jemen, Syrien, Nigeria, Somalia und Venezuela bombardiert und sogar den Anführer eines Landes entführen lassen – nahezu ohne Kosten für die Vereinigten Staaten.

Doch immer wieder hat die moderne Kriegführung die Grenzen dieser Vorstellung aufgezeigt.

Während der Operation Rolling Thunder [6] in Vietnam (1965–1968) starteten die Vereinigten Staaten eine anhaltende Bombenkampagne, um Nordvietnam zu Verhandlungen zu amerikanischen Bedingungen zu zwingen. Stattdessen passte sich Hanoi an, verteilte seine Infrastruktur, verstärkte die Verteidigung und mobilisierte politischen Durchhaltewillen. Die Bombardierungen brachen weder den Willen Nordvietnams, noch erzwangen sie substanzielle Zugeständnisse.

Im Golfkrieg von 1991 zwangen anhaltende Luftangriffe den Irak nicht zum Rückzug aus Kuwait; erst die Bodenoffensive erwies sich als entscheidend. Dieselbe strategische Lehre wird auch durch Russlands Luft- und Raketenkrieg gegen die Ukraine unterstrichen: Anhaltende Schläge gegen Infrastruktur und militärische Ziele haben – ohne entscheidende Kontrolle am Boden – die politische Führung in Kiew nicht dazu bewegt, Moskaus territoriale Ambitionen zu akzeptieren.

Die systematische Studie des Chicagoer Professors Robert Pape zu Luftkampagnen bestätigt dieses Muster. Demnach ist Luftmacht weniger durch die Bestrafung ziviler Infrastruktur erfolgreich, sondern dann, wenn sie mit einer glaubwürdigen Drohung verbunden ist, Territorium einzunehmen oder zu halten.

Selbst die Nato-Kampagne im Kosovo – oft als Triumph der Luftmacht angeführt – gewann erst dann ihren zwingenden Charakter, als serbische Bodentruppen zunehmend bedroht waren und eine Nato-Invasion immer wahrscheinlicher [7] wurde. Die konsistente Lehre lautet: Ohne die Gefährdung territorialer Kontrolle erzwingt Bombardierung allein selten Kapitulation oder Aufgabe.

Der Iran dürfte keine Ausnahme von dieser Regel sein. Die unübertroffene Lufthoheit der Vereinigten Staaten ist zwar ein mächtiges Zerstörungsinstrument, doch bedeutet dies nicht zwangsläufig politische Unterwerfung. Präsident Masoud Peseschkian brachte diese Haltung am 21. Februar zum Ausdruck, als er erklärte [8]: "Die Weltmächte stellen sich auf, um uns zu zwingen, den Kopf zu senken [...] aber wir werden unseren Kopf nicht senken, trotz aller Probleme, die sie uns bereiten."

Tatsächlich kann der Iran aufgrund seiner Größe und strategischen Tiefe erhebliche Luftschläge verkraften, ohne zu kapitulieren. Das letzte Mal, dass der Iran gezwungen war, sich einem ausländischen Gegner zu ergeben, war im August 1941.

Damals verletzten britische und sowjetische Truppen während des Zweiten Weltkriegs seine Neutralität [9] und besetzten das Land, nachdem der Iran sich geweigert hatte, ihren Forderungen nach Ausweisung deutscher Staatsangehöriger nachzukommen.

Die Islamische Republik hat Jahrzehnte damit verbracht, sich auf eine Konfrontation mit überlegener US-Feuerkraft vorzubereiten. Ihre Militärdoktrin betont asymmetrische Kriegführung, Dezentralisierung und gehärtete Anlagen.

Berichten [10] zufolge hat der Iran in Erwartung möglicher US-Luftschläge damit begonnen, seine Atomanlagen zu verstärken, um die Auswirkungen amerikanischer Angriffe zu minimieren. Selbst im Falle einer vollständigen Zerstörung verfügt der Iran über die technologische und industrielle Kapazität, diese im Laufe der Zeit wieder aufzubauen. Bomben können physische Infrastruktur zerstören, aber kein Wissen und keine Technologie.

Noch wichtiger ist, dass das politische System der Islamischen Republik bemerkenswert widerstandsfähig ist. Es entstand aus einer Revolution, überlebte Attentate und einen achtjährigen totalen Krieg und konsolidierte sich unter jahrzehntelangem wirtschaftlichem Druck der USA, ohne zu kapitulieren. Während des Iran-Irak-Krieges verkraftete [11] der Iran Hunderttausende militärische und zivile Opfer, doch die Islamische Republik brach weder zusammen noch ergab sie sich.

Stattdessen wurde der Krieg als heilige Verteidigung der Nation gerahmt und die Sprache von Opferbereitschaft und Märtyrertum verankerte sich in der Staatsideologie und der politischen Mobilisierung. Diese historische Erfahrung ist von großer Bedeutung. Das Regime ist strukturell in einer Weise gegen öffentlichen Druck abgeschirmt, die den erzwingenden Hebel der Luftmacht begrenzt. Zudem verfügt es über institutionelle Mechanismen, um im Falle von Enthauptungsschlägen die Führungskontinuität zu sichern.

Zugleich verstehen iranische Entscheidungsträger die Asymmetrie in der Sensibilität gegenüber Verlusten. Die amerikanische politische Kultur, geprägt von demokratischer Rechenschaftspflicht und medialer Kontrolle, reagiert tendenziell empfindlich auf anhaltende Verluste. Demgegenüber hat die iranische Gesellschaft historisch eine deutlich höhere Toleranz gegenüber langanhaltender Entbehrung und Opferbereitschaft im Angesicht äußerer Angriffe gezeigt. Unter diesen Bedingungen ist Luftbestrafung eher dazu geeignet, den inneren Zusammenhalt des Regimes und die nationalistische Entschlossenheit zu festigen, als eine Kapitulation zu erzwingen.

Luftmacht ist ein unvollkommenes Instrument politischer Zwangsausübung. Sie kann zwar Anlagen zerstören. Sie kann jedoch kein Territorium besetzen, kein Regime ersetzen oder eine dauerhafte politische Kapitulation erzwingen, solange keine glaubwürdige Bodendrohung besteht.

Der preußische Militärtheoretiker Carl von Clausewitz warnte [12] davor, dass ein Krieg nach seinem Beginn eigene Dynamiken entwickelt. Zwar entscheiden politische Führer, wann sie einen Krieg beginnen, doch seinen Verlauf können sie nicht linear kontrollieren. Ist die Gewalt erst einmal entfesselt, folgen Eskalation, Vergeltung und unbeabsichtigte Konsequenzen oft Pfaden, die kein Planer vollständig voraussehen kann.

Sollte Washington unter der Illusion handeln, Bomben allein könnten Teheran zur Aufgabe zwingen, könnte die Stadt erfahren, was die Geschichte wiederholt gezeigt hat: Bombardierungen verhärten häufig die Entschlossenheit, statt sie zu brechen – und Kriege, die als Druckmittel begonnen werden, können sich zu Konflikten entwickeln, die weit größer sind, als ihre Initiatoren beabsichtigten.

Sina Azodi ist Assistenzprofessor für Nahostpolitik und Direktor des Nahoststudienprogramms an der Elliott School of International Affairs der George Washington University. Er ist Autor des Buches "Iran and the Bomb: The United States, Iran and the Nuclear Question" (Der Iran und die Bombe: Die Vereinigten Staaten, der Iran und die Atomfrage).

Dieser Text erschien zuerst auf Englisch auf unserem Partnerportal Responsible Statecraft [13].

URL dieses Artikels:

https://www.heise.de/-11190983

Links in diesem Artikel:

[1] https://responsiblestatecraft.org/fuel-tankers-iran-attack/

[2] https://www.pbs.org/newshour/amp/world/trump-warns-of-bad-things-if-iran-doesnt-make-a-deal-as-u-s-carrier-approaches-region

[3] https://responsiblestatecraft.org/author/sazodi/

[4] https://www.axios.com/2026/02/21/trump-iran-plan-kill-khamenei-regime-change-deal

[5] https://www.airuniversity.af.edu/Portals/10/AUPress/Books/B_0160_DOUHET_THE_COMMAND_OF_THE_AIR.pdf

[6] https://apps.dtic.mil/sti/tr/pdf/ADA215903.pdf

[7] https://publications.parliament.uk/pa/cm199900/cmselect/cmdfence/347/34723.htm?utm_source

[8] https://www.reuters.com/world/middle-east/pezeshkian-says-iran-will-not-bow-pressure-amid-us-nuclear-talks-2026-02-21/

[9] https://resources.saylor.org/wwwresources/archived/site/wp-content/uploads/2011/08/HIST351-10.2.4-Anglo-Soviet-invasion-of-Iraq.pdf

[10] https://www.bbc.com/news/articles/cwygxz81330o

[11] https://kurzman.unc.edu/death-tolls-of-the-iran-iraq-war/

[12] https://icct.nl/sites/default/files/import/publication/On-War.pdf

[13] https://responsiblestatecraft.org/coercion-through-iran-airstrikes/

Copyright © 2026 Heise Medien

(Bild: Henry Saint John / Shutterstock.com)

Burger King führt den KI-Assistenten "Patty" ein. Er hört über Headsets mit und bewertet, wie freundlich das Personal ist.

Bei Burger King hört künftig eine Künstliche Intelligenz mit, wenn Angestellte mit Kunden sprechen. Die Fast-Food-Kette stellt ihrem Personal einen Sprachassistenten namens "Patty" zur Seite, der direkt über die Headsets der Mitarbeiter läuft.

Das System erkennt wohl, so berichtet [1] The Verge, ob das Personal höflich ist und Formulierungen wie "Willkommen bei Burger King", "bitte" oder "danke" verwendet – und daraus leitet es eine Art Benotung für Freundlichkeit ab. Technisch stützt sich der Chatbot auf ein Sprachmodell von OpenAI.

Um festzulegen, was man unter einem guten Service verstehen möchte, hat die Kette nach eigenen Angaben ausgewertet, was sich Franchisenehmer und Gäste darunter vorstellen.

Auf dieser Basis lernte die KI, bestimmte Schlüsselwörter in Gesprächen zu identifizieren. Schichtleiter können "Patty" anschließend nach einer Einschätzung fragen – etwa, wie freundlich das Team an einem bestimmten Standort oder während einer Schicht aufgetreten ist.

Thibault Roux, Chief Digital Officer von Burger King, sagte gegenüber The Verge: "All dies ist als Coaching-Tool gedacht". Zusätzlich arbeite man daran, künftig auch den Tonfall von Gesprächen auszuwerten.

Gegenüber Associated Press stellte das Unternehmen [2] klar:

"Es geht nicht darum, Einzelpersonen zu bewerten oder Skripte durchzusetzen. Es geht darum, großartige Gastfreundschaft zu fördern und Managern hilfreiche Echtzeit-Einblicke zu geben, damit sie ihre Teams effektiver erkennen können."

Nicht alle teilen diesen Optimismus. Das Technikportal Gizmodo etwa warnte [3]: Ein ständig mithörender Bot, der dem Vorgesetzten Bewertungen liefert, könne rasch in Richtung lückenloser Überwachung kippen – zumal die genauen Maßstäbe hinter dem Freundlichkeitswert im Dunkeln blieben.

Der Chatbot ist nur ein Baustein der größeren "BK Assistant"-Plattform. Sie verknüpft Kassendaten, Küchengeräte, Lagerbestände und Drive-Thru-Gespräche miteinander.

In der Praxis heißt das: Wer nicht weiß, welcher Belag auf einen bestimmten Burger gehört, fragt einfach die KI. Gleiches gilt für das Reinigen von Küchengeräten.

Geht eine Zutat zur Neige oder fällt eine Maschine aus, schlägt das System automatisch Alarm. Innerhalb von 15 Minuten verschwinde der betroffene Artikel dann aus sämtlichen digitalen Speisekarten – egal ob am Selbstbedienungsterminal, auf der Drive-Thru-Tafel oder in der Liefer-App, erklärte Roux.

Aktuell läuft "Patty" in rund 500 US-Restaurants im Probebetrieb. Die dahinterliegende Plattform soll nach Unternehmensangaben bis Jahresende an allen etwa 7.000 US-Standorten verfügbar sein. Auch in Kanada [4] könnte "Patty" noch in diesem Jahr eingeführt werden.

Auf eine vollautomatische KI-Bestellannahme am Drive-Thru-Schalter verzichtet Burger King vorerst bewusst. "Wir tüfteln daran herum, wir spielen damit, aber es ist immer noch ein riskantes Unterfangen", räumte Roux ein. "Nicht jeder Gast ist dafür bereit." Weniger als 100 Filialen testen diese Variante bislang.

Andere Ketten haben mit ähnlichen Projekten bereits gemischte Erfahrungen gemacht. McDonald's stoppte 2024 einen gemeinsamen Versuch mit IBM, bei dem eine KI Bestellungen am Drive-Thru entgegennahm, und kooperiert nun stattdessen mit Google.

Taco Bell ruderte ebenfalls zurück, nachdem Kunden das System gezielt mit absurden Wünschen überfordert hatten.

Ob das Personal bei Burger King einen digitalen Zuhörer akzeptiert, der jede Interaktion sprachlich einordnet, muss sich erst noch zeigen. Die Trennlinie zwischen nützlichem Coaching und permanenter Kontrolle dürfte im Arbeitsalltag dünn sein.

URL dieses Artikels:

https://www.heise.de/-11192133

Links in diesem Artikel:

[1] https://www.theverge.com/ai-artificial-intelligence/884911/burger-king-ai-assistant-patty

[2] https://apnews.com/article/burger-king-ai-artificial-intelligence-headsets-friendliness-b7d5a4120dc669fe338a4da3eedb0016

[3] https://gizmodo.com/surveillance-with-a-smile-burger-king-will-use-ai-to-track-if-employees-say-please-and-thank-you-2000727068

[4] https://toronto.citynews.ca/2026/02/26/burger-king-to-bring-ai-based-voice-coach-to-canada-later-this-year/

Copyright © 2026 Heise Medien

Smart Locks aller Art – mit Erlaubnis – mit fast jedem Smartphone öffnen können – dafür soll der Standard Aliro sorgen.

(Bild: Connectivity Standards Alliance)

Der neue Smart-Home-Standard Aliro vereinheitlicht das Öffnen vernetzter Türschlösser durch digitale Schlüssel in Wallet-Apps.

Smart-Home-Standards sollen Türen zwischen Herstellersystemen öffnen. Bei Aliro ist das sogar buchstäblich die Auftragsbeschreibung. Das jetzt in Version 1.0 veröffentlichte Protokoll vereinheitlicht die Übergabe von Zugangsdaten und den Datentransport per Funk zwischen smarten Türschlössern und ihren Lesegeräten auf der einen Seite und Smartphones und Smartwatches auf der anderen Seite. Die drei großen Anbieter von Wallet-Apps – Apple, Google und Samsung – steuern die Behältnisse für digitale Schlüssel bei. Unter den Smart-Lock-Anbietern, die sich an dem Standard beteiligen, sind Branchengrößen wie Nuki, Assa Abloy (Yale), Aqara und Anker (Eufy). Entwicklungsteams haben jetzt Zugriff auf die finalen Spezifikationen von Aliro. Mit marktreifer Hardware und Software ist in Kürze zu rechnen.

Aliro soll es erleichtern, Smart Locks mit digitalen Schlüsseln eines Anbieters der Wahl zu kombinieren. Das soll nicht nur das Zugangsmanagement zu Türen privater Wohnungen und Häuser, sondern auch das für Büros, Hotels, Hochschulen oder Veranstaltungsorten erleichtern. Bisher ist man zum Öffnen von vernetzten Türschlössern von Privaträumen oft auf die App des jeweiligen Herstellers inklusive registriertem Konto angewiesen. In Geschäftsgebäuden sind wiederum Token zum Anfassen üblich. Beides ist nicht ideal für sporadischen Besuch.

Eine zentrale digitale Schlüsselverwaltung klingt vor allem dann verheißungsvoll, wenn man regelmäßig mehrere Schlösser unterschiedlicher Hersteller öffnet. Digitale Schlüssel für Wallet-Apps muss man nicht physisch verteilen und einziehen. Dass mehrere davon zentral an einem Ort liegen können, macht den Einsatz bequem.

Bisherige Zentrallösungen binden die Kundschaft allerdings nur eine Ebene höher an die Hard- und Software eines einzigen Anbieters. So etwa im Fall von Apple HomeKey. Das ist ein Verfahren, bei dem man mit der NFC-Funktion von iPhones und Apple Watches kompatible Türschlösser öffnet, indem man das Mobilgerät an eine zum Schloss gehörige Lesefläche hält. Oft steckt diese in einem Bedienteil mit Zifferntastatur an der Wand daneben. Der entsprechende Zugangscode ist bei HomeKey in der Wallet-App von Apple gespeichert.

Aliro erhöht im Vergleich dazu die Anzahl der Zugangsoptionen. Neben der Wallet-App von Apple sieht der Standard auch die von Google und Samsung als Speicherort für Zugangsdaten vor. Damit kommt eine sehr große Zahl an Smartphone- und Smartwatch-Modellen als Schlüsselträger infrage.

Für den Transport der Zugangsdaten kombiniert Aliro mehrere Funktechniken. Per NFC (Near Field Communication) erfolgt das sogenannte Tap-To-Access, also der Kontakt eines Mobilgeräts mit der Lesefläche, so wie bei Apple HomeKey. Per Bluetooth Low Energy ist eine Fernöffnung aus etwas größerer Distanz möglich. Ultrawideband (UWB) erleichtert dabei eine präzisere Ortung der beteiligten Geräte, damit sich Schloss und Smartphone vergewissern können, ob man wirklich direkt vor der Tür steht oder nicht. UWB ist bei Weitem nicht auf allen Mobilgeräten verfügbar und muss daher als zusätzliche Option betrachtet werden.