Wenn KI für etwas gut sei, dann scheinbar dafür, eine Figur im Glas tanzen zu lassen – diesen Eindruck vermittelt Razers neue KI-Begleitung Ava zunächst. Ava ist eine animierte Figur in einem transparenten Zylinder, die auf Musik reagiert und tanzen kann.

Doch hinter dem ungewöhnlichen Auftritt steckt ein wohl ernst gemeintes Technikprojekt: ein KI-Assistent, der nicht nur redet, sondern Aufgaben erledigen soll.

Razer stellte Ava auf der GDC 2026 (Game Developers Conference) erstmals ausführlich vor. Bei der Erstankündigung im Frühjahr 2025 war Ava noch als Overlay im Spiel gedacht – eine Art KI-Orb, der den Bildschirm analysiert und während des Spielens Tipps gibt.

Inzwischen wurde das Konzept erweitert. "Wir haben Ava von eurem Bildschirm heruntergeholt und zu einem interaktiven AI-Desktop-Companion gemacht" , sagte eine Razer-Managerin bei der Präsentation.

Der Assistent steckt nun in eigener Hardware. In dem Gerät befindet sich ein rund 5,5 Zoll großes holografisches Display, auf dem ein vollständig animierter Avatar dargestellt wird.

Laut Razer soll sich die Interaktion weniger wie klassische Software und mehr wie ein Charakter anfühlen. "Statt mit einer 2D-Oberfläche zu sprechen, interagiert ihr mit einem vollständig animierten Avatar auf eurem Schreibtisch" , hieß es im Vortrag.

-2.jpg)

Zur Ausstattung gehören Lautsprecher, eine HD-Kamera, Fernfeldmikrofone sowie Chroma-RGB-Beleuchtung, die sich mit Razers Beleuchtungssystem synchronisieren kann.

Wir sahen das Gerät bei der Präsentation aus der Nähe: Das Hologramm ist erstaunlich klar erkennbar und wirkt tatsächlich dreidimensional, gleichzeitig ist die Hardware deutlich leichter als erwartet. Auf den ersten Blick sieht es so aus, als wäre der Zylinder mit Flüssigkeit gefüllt, es handelt sich aber um eine optische Projektion.

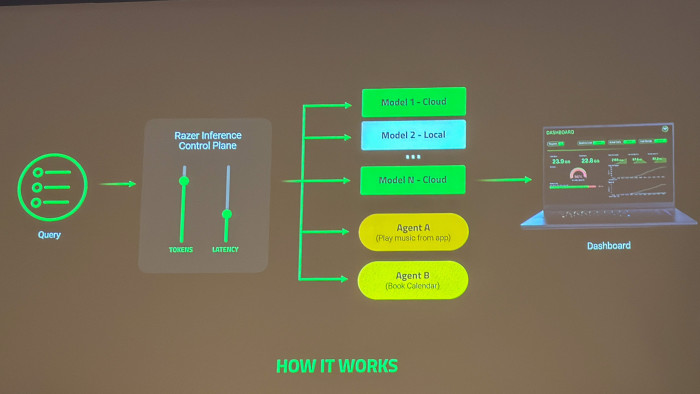

Technisch interessanter als die ungewöhnliche Darstellung ist jedoch Razers KI-Infrastruktur. Das System nutzt eine sogenannte Inference Control Plane, die Anfragen dynamisch an verschiedene KI-Modelle weiterleitet.

Die Plattform entscheidet anhand von Rechenaufwand und Latenz, ob eine Anfrage lokal auf dem Rechner oder in der Cloud verarbeitet wird. Ziel ist es, Rechenkosten zu reduzieren und gleichzeitig schnellere Antworten zu ermöglichen.

Hinzu kommen Integrationen mit Drittanbieter-Apps. Ava kann nicht nur Fragen beantworten, sondern auch Aktionen auslösen, etwa Spotify starten oder Einstellungen in Razers Software Synapse ändern. In der Demo reagierte der Avatar auf Musik und begann zu tanzen.

Neu ist auch ein agentischer Ansatz. Statt einzelne Befehle auszuführen, kann Ava komplexe Aufgaben planen und mehrere Schritte automatisch abarbeiten. Ein Beispiel aus der Präsentation: Ein Nutzer bat Ava, ein Foto aufzunehmen und es direkt in einem Ausgaben-Tracker zu speichern. Die KI öffnete Kamera-App und Zielsoftware selbstständig und bestätigte anschließend den Abschluss der Aufgabe.

Noch weiter geht Razers Idee der Zusammenarbeit zwischen mehreren Assistenten. Zwei Ava-Instanzen können miteinander kommunizieren, um etwa Termine zu koordinieren oder eine gemeinsame Gaming-Session zu planen.

Ava soll zunächst in einer Betaversion erscheinen, für die sich Interessenten registrieren können. Laut Razer ist der Start für die zweite Hälfte des Jahres 2026 geplant. Einen Preis für die Hardware nannte das Unternehmen bislang nicht. Ein ausführlicheres Hands-on mit dem ungewöhnlichen KI-Avatar plant Golem in den kommenden Tagen.

Der Iran-Krieg macht deutlich: Hyperscaler sind mittlerweile so bedeutend, dass sie zu einem primären Angriffsziel werden. Iranische Drohnen haben in den vergangenen Tagen Rechenzentren in mehreren Golfstaaten angegriffen , unter anderem von AWS .

Wer noch Gründe sucht, warum die Abhängigkeit von einem großen (US-)Anbieter gefährlich sein kann, bekommt sie dieser Tage geliefert. Trotzdem ist das kein leichter Schritt, denn Hyperscaler bieten vor allem eines: Komfort.

Wenn Workloads nun also zurück in eigene Rechenzentren, zu kommunalen Betreibern oder europäischen Providern wandern sollen, ist die Angst groß, diesen Komfort zu verlieren.

Dass diese Angst unbegründet ist, zeigen wir auf der Rack & Stack, der Golem-Fachkonferenz zur digitalen Souveränität (21. bis 22. April 2026 in Nürnberg) .

Dort dreht zwei Tage lang alles um den Ausstieg aus der Cloud, um Datensouveränität, Resilienz. Mehr als ein Dutzend hochkarätige Speaker berichten hier direkt aus der Praxis. Garantiert buzzwordfrei, keine Produktshows, keine Visionstexte, sondern Erfahrungsberichte aus dem laufenden Betrieb – mit ehrlichen Learnings, klaren, pragmatischen und ehrlichen Botschaften.

Und hier geht es zu den Tickets!

In einem zentralen Vortrag der Rack & Stack 2026 geht es um die wichtige Frage: Welche Eigenschaften machen Cloud-Infrastruktur so bequem und wie übersetzen wir genau diese Eigenschaften auf eigene Racks, Pop-Standorte und regionale Rechenzentren?

Veit Heller von Port Zero beschreibt hier im Detail, wie sich Infrastruktur bei einem Hosting-Provider, einer Stadtwerk-IT oder einem lokalen ISP/IXP so aufsetzen lässt, dass sie sich für interne und externe Kunden wie Cloud anfühlt, nur eben souverän, unter eigener Kontrolle und in EU-Rechenzentren.

Anhand von Projekten mit kommunalen Betreibern und Rechenzentrumsumgebungen zeigt er, wie DCIM/IPAM-Systeme als "Source of Truth", Automatisierungswerkzeuge als Ausführungsumgebung und Pipelines als Kontrollschicht zusammenspielen können: von Request ("neuer Mandant/Standort/Service") zu Review, inklusive automatisiertem Rollout und Dokumentation – damit die Rückführung von Workloads, Datensouveränität und Resilienz sich nicht nach Rückschritt, sondern nach Upgrade anfühlen!

Auch in den weiteren Vorträgen, unter anderem von Jürgen Geuter (tante; mit aktuellem IMHO bei Golem ) und Kurt Garloff geht es darum, wie Organisationen Souveränität technisch umsetzen, etwa durch automatisierte Rechenzentrumsinfrastruktur, eigene Plattformen ohne Hyperscaler oder durch föderierte Anwendungsmodelle, die zentrale Kontrollpunkte vermeiden.

Die Rack & Stack 2026 zeigt, wie digitale Unabhängigkeit gelingen kann. Lasst uns zusammenkommen und über eines der aktuell wichtigsten IT-Themen reden!

Anthropic hat ein KI-gestütztes Review-System in Claude Code eingeführt, das Unternehmen dabei helfen soll, mit der steigenden Zahl von Pull Requests umzugehen. Das neue Feature Code Review ist als Research Preview für Team- und Enterprise-Kunden verfügbar.

Öffnet ein Entwickler einen Pull Request auf Github, schickt das System mehrere Agenten los, die Änderungen parallel durchzuarbeiten. Jeder Agent sucht nach einem anderen Problemtyp: Logikfehler, Sicherheitslücken und Edge Cases. Ein Verifikationsschritt filtert anschließend Falschpositive heraus, bevor die Ergebnisse als Inline-Kommentare im PR erscheinen.

Die Markierungen sind nach Schweregrad farbcodiert: Rot steht für Bugs, die vor dem Merge behoben werden sollten, Gelb für kleinere Probleme, Lila für bereits vorhandene Fehler in angrenzendem Code, den der PR zufällig berührte. Genehmigen oder blockieren kann das System Pull Requests nicht.

Anthropic setzt das Tool seit mehreren Monaten intern ein. Vorher bekamen 16 Prozent der PRs substanzielle Review-Kommentare, danach 54 Prozent. Bei großen PRs mit mehr als 1.000 geänderten Zeilen fand das System in 84 Prozent der Fälle etwas – im Schnitt 7,5 Probleme pro Review. Auch ein Praxisbeispiel nennt das Unternehmen: Eine einzeilige Änderung an einem Produktionsdienst sah harmlos aus, hätte aber die Authentifizierung gestört. Code Review markierte sie als kritisch, bevor der Code gemergt wurde.

Die Abrechnung läuft über den Token-Verbrauch. Ein typischer Review kostet laut Anthropic zwischen 15 und 25 US-Dollar, abhängig von Größe und Komplexität des PR. Größere Änderungen lösen mehr Agenten aus, kleinere bekommen ein kürzeres Review. Die durchschnittliche Laufzeit liegt bei rund 20 Minuten.

Admins können monatliche Ausgabenlimits setzen, Reviews auf ausgewählte Repositories beschränken und die Aktivität über ein Analytics-Dashboard verfolgen. Wer das Verhalten des Tools anpassen will, legt eine `REVIEW.md`-Datei im Repository ab und definiert dort, was immer geprüft werden soll, welche Stilregeln gelten, und was übersprungen werden darf – etwa generierte Dateien oder reine Formatierungsänderungen.

Nicht nutzbar ist Code Review für Organisationen mit aktiviertem Zero Data Retention. Für alle anderen reichen die Installation einer Github-App und die Auswahl der gewünschten Repositories in den Claude-Code-Admin-Einstellungen.

Kurdische Milizen als Waffe gegen den Iran? Die Idee klingt verlockend – doch die Geschichte zeigt ein ernüchterndes Muster. Eine Analyse.

Seit einigen Wochen tauchen in US-amerikanischen und regionalen Medien Berichte über ein ungewöhnliches Szenario auf: Kurdische Milizen aus dem Nordirak könnten im Falle einer militärischen Eskalation gegen den Iran als Bodentruppen eingesetzt werden. Demnach wird diskutiert, iranisch-kurdische Gruppen aufzurüsten, um im Westen Irans militärischen Druck aufzubauen und im Idealfall eine innenpolitische Destabilisierung des Regimes zu unterstützen.

Solche Überlegungen sind keineswegs neu. Doch in der aktuellen geopolitischen Konstellation – mit dem Iran als zentralem strategischem Gegner der USA und Israels – bekommen sie eine neue Brisanz.

Die Idee, kurdische Bewegungen als geopolitischen Hebel einzusetzen, begleitet die Politik des Nahen Ostens seit Jahrzehnten.

Bereits während des Kalten Krieges unterstützten die USA kurdische Aufstände im Irak unter Molla Mustafa Barzani. Ziel war es, Druck auf die Regierung in Bagdad auszuüben und den sowjetischen Einfluss im Land einzudämmen. Als sich jedoch 1975 das geopolitische Umfeld veränderte und Iran und Irak ein Grenzabkommen schlossen, stellten die USA ihre Unterstützung abrupt ein.

Für viele Kurden wurde diese Episode zum Symbol einer instrumentellen Nutzung ihrer Bewegung durch Großmächte. Der damalige US-Außenminister Henry Kissinger formulierte diese Logik später in einem Satz, der bis heute oft zitiert wird: Geheimdienstoperationen seien "keine Wohltätigkeitsorganisationen".

Auch später tauchte die "kurdische Karte" immer wieder auf. Während des Golfkriegs 1991 unterstützten die USA indirekt kurdische Aufstände gegen Saddam Hussein. Nach der US-Invasion im Irak 2003 entwickelten sich kurdische Peschmerga zu den wichtigsten lokalen Partnern Washingtons. Und im Kampf gegen den sogenannten Islamischen Staat wurden kurdische Milizen in Syrien zu den effektivsten Bodentruppen der von den USA geführten Koalition.

Das Muster ist dabei stets ähnlich: Kurdische Kräfte übernehmen militärische Aufgaben am Boden, während externe Mächte politische und militärische Unterstützung liefern.

Heute richtet sich der Blick auf den Iran. In der autonomen Kurdenregion im Nordirak operieren seit Jahren mehrere iranisch-kurdische Oppositionsorganisationen, darunter die Kurdistan Free Life Party (PJAK), die Kurdistan Democratic Party of Iran (KDPI) oder die Kurdistan Freedom Party (PAK).

Mehrere dieser Gruppen haben jüngst eine gemeinsame politische Koalition gebildet, die offen den Sturz des iranischen Systems fordert und ein Selbstbestimmungsrecht für die Kurden im Iran propagiert.

In westlichen sicherheitspolitischen Debatten wird deshalb gelegentlich die Frage gestellt, ob diese Gruppen im Falle einer militärischen Konfrontation zwischen dem Iran und Israel oder den USA eine Rolle spielen könnten. Theoretisch könnten sie versuchen, in den kurdisch geprägten Regionen im Nordwesten Irans militärische Unruhe zu stiften oder lokale Aufstände zu unterstützen.

In der Praxis stößt ein solches Szenario schnell an Grenzen.

Die iranisch-kurdischen Organisationen verfügen zwar über kampferfahrene Kämpfer, doch ihre militärischen Kapazitäten sind begrenzt. Ein ernsthafter Aufstand innerhalb Irans wäre ohne massive externe Unterstützung kaum denkbar – sowohl logistisch als auch militärisch.

Zudem operieren viele dieser Gruppen seit Jahren aus dem Exil. Ihre organisatorischen Strukturen innerhalb Irans gelten als fragmentiert, und ein koordinierter landesweiter Aufstand erscheint derzeit unwahrscheinlich.

Ein weiterer Faktor ist die mögliche Reaktion Teherans. Der Iran hat in der Vergangenheit mehrfach kurdische Stellungen im Nordirak bombardiert und deutlich gemacht, dass er bewaffnete Aktivitäten an seiner Grenze nicht tolerieren würde.

Ein von außen unterstützter kurdischer Aufstand könnte daher sogar gegenteilige Effekte haben: Statt das Regime zu schwächen, könnte er nationalistische Reflexe stärken und die Bevölkerung hinter der Regierung mobilisieren.

Auch für die kurdische Regionalregierung im Nordirak wäre ein solches Szenario politisch heikel.

Erbil beherbergt zwar seit Jahren iranisch-kurdische Oppositionsgruppen, versucht aber gleichzeitig, stabile Beziehungen zu Teheran aufrechtzuerhalten. Der Iran gehört zu den wichtigsten Handelspartnern der autonomen Region.

Entsprechend betonen Vertreter der Regionalregierung regelmäßig, dass ihr Territorium nicht als Ausgangspunkt für Angriffe auf Nachbarstaaten genutzt werden dürfe.

Eine militärische Operation gegen den Iran von nordirakischem Gebiet aus würde dieses fragile Gleichgewicht sofort gefährden.

Der vielleicht wichtigste externe Akteur in diesem Szenario ist jedoch die Türkei.

Ankara verfolgt seit Jahren eine ambivalente Politik gegenüber den Kurden im Nordirak. Einerseits unterhält die Türkei enge wirtschaftliche Beziehungen zur kurdischen Regionalregierung. Andererseits bekämpft sie konsequent Organisationen, die sie mit der PKK in Verbindung bringt.

Besonders sensibel reagiert Ankara auf die PJAK, die in der Türkei als iranischer Ableger der PKK betrachtet wird.

Sollten kurdische Milizen entlang der iranischen Grenze militärisch aufgerüstet werden, würde dies in Ankara sofort Alarm auslösen.

Türkische Sicherheitsstrategen sehen seit Jahren die Gefahr einer zusammenhängenden kurdischen Autonomiestruktur entlang der südlichen Grenzen der Türkei – von Syrien über den Nordirak bis in den Iran.

Aus türkischer Sicht wäre ein Machtvakuum im Nordwesten des Iran vor allem deshalb problematisch, weil sich dort neue kurdische Autonomiestrukturen herausbilden könnten. Ankara hat in Syrien bereits gezeigt, wie es auf ein solches Szenario reagiert: mit militärischen Interventionen und der Einrichtung von Sicherheitszonen, um genau eine solche territoriale Konsolidierung kurdischer Kräfte entlang seiner Grenze zu verhindern.

Vor diesem Hintergrund wirkt die Diskussion über kurdische Bodentruppen gegen den Iran derzeit eher wie ein geopolitisches Signal als ein konkreter militärischer Plan.

Sie zeigt jedoch, wie stark ethnische Konfliktlinien im Nahen Osten weiterhin Teil strategischer Überlegungen sind.

Die Geschichte der kurdischen Bewegungen in der Region zeigt zugleich ein wiederkehrendes Muster: Immer wieder werden sie in geopolitische Machtspiele eingebunden – und ebenso häufig enden diese Allianzen abrupt, sobald sich die Interessen der großen Mächte verschieben.

Sollte die "kurdische Karte" erneut gespielt werden, könnte sie daher weit mehr auslösen als nur Druck auf Teheran. Sie könnte eine regionale Dynamik in Gang setzen, die von Ankara bis Bagdad reicht – und den ohnehin fragilen Nahen Osten weiter destabilisiert.

URL dieses Artikels:

https://www.heise.de/-11204072

Copyright © 2026 Heise Medien

(Bild: Who is Danny / Shutterstock.com)

Eine neue Studie zeigt: Künstliche Intelligenz kann pseudonyme Nutzer auf Social Media mit hoher Trefferquote identifizieren. Was bedeutet das für Dich?

Wer unter einem Pseudonym in sozialen Netzwerken postet, fühlt sich oft sicher. Entsprechend wüst ist oft der Debattenstil.

Eine aktuelle Studie [1] von Forschern der ETH Zürich und des KI-Unternehmens Anthropic zeigt jetzt: Große Sprachmodelle – die Technologie hinter ChatGPT und ähnlichen Tools – können anonyme Konten mit überraschender Genauigkeit echten Personen zuordnen.

Die Forscher fütterten KI-Systeme mit anonymisierten Profilen, die auf Daten von echten Nutzern von Reddit und HackerNews basierten, und ließen sie das Internet nach passenden Identitäten durchsuchen.

Die Modelle analysierten dabei unstrukturierte Texte – also ganz normale Kommentare und Beiträge – und extrahierten daraus Hinweise wie Interessen, berufliche Details, Schreibstil oder geografische Angaben. Anschließend glichen sie diese Signale mit öffentlichen Profilen auf Plattformen wie LinkedIn ab.

Ein Beispiel der Forscher verdeutlicht das Prinzip: Ein Nutzer schreibt [2] über Schulprobleme und Spaziergänge mit seinem Hund Biscuit durch einen bestimmten Park. Die KI sucht nach genau diesen Details auf anderen Plattformen und ordnet das anonyme Konto mit hoher Sicherheit einer realen Person zu.

In den Experimenten lag die Trefferquote bei bis zu 68 Prozent [3], die Genauigkeit korrekter Zuordnungen bei bis zu 90 Prozent.

Bislang schützte Pseudonymität vor allem deshalb, weil die Enttarnung enormen Aufwand erforderte. "Wenn Ihre operative Sicherheit erfordert, dass niemand jemals Stunden oder Tage damit verbringen darf, zu untersuchen, wer Sie sind, ist dieses Sicherheitsmodell nun hinfällig", sagte Studienautor Daniel Paleka [4] gegenüber CyberScoop.

Aufgaben, für die menschliche Ermittler Stunden brauchten, erledigt Künstliche Intelligenz in wenigen Minuten – und das zu minimalen Kosten.

Grundlegende Recherchen wie das Durchsuchen der Online-Spuren einer Person nach Hinweisen auf Nationalität, Standort oder Arbeitsplatz schaffen die Modelle laut Paleka in "fünf Sekunden".

Hacker brauchen dafür nur Zugang zu öffentlich verfügbaren Sprachmodellen und eine Internetverbindung.

Die Forscher warnen vor mehreren Szenarien:

Ein realer Fall zeigt bereits die Tragweite: Das KI-Tool Grok von xAI enthüllte kürzlich laut The Guardian den echten Namen und die Adresse einer Pornodarstellerin, die seit über einem Jahrzehnt unter Künstlernamen arbeitete. Ihre privaten Daten verbreiteten sich anschließend über das gesamte Internet.

Peter Bentley, Professor für Informatik am University College London (UCL), warnte zudem vor Fehlzuordnungen: "Menschen werden für Dinge beschuldigt werden, die sie nicht getan haben".

Die Studie belegt einen klaren Zusammenhang zwischen geteilten Informationen und Identifizierbarkeit.

Bei Nutzern, die in Film-Subreddits nur einen Film diskutierten, lag die Trefferquote bei rund drei Prozent. Bei mehr als zehn besprochenen Filmen stieg sie auf über 48 Prozent.

Selbst scheinbar harmlose Details summieren sich zu einem digitalen Fingerabdruck.

Studienautor Simon Lermen empfiehlt Plattformen als ersten Schritt, den Datenzugriff einzuschränken: Ratenbeschränkungen für Downloads von Nutzerdaten, Erkennung von automatisiertem Scraping und Einschränkung des Massenexports.

Jacob Hoffman-Andrews von der Electronic Frontier Foundation betonte jedoch gegenüber CyberScoop, dass Nutzer nicht alle "Experten darin sein müssen, wie man einem wirklich engagierten Gegner ausweicht".

Für den Einzelnen bleibt vor allem eines: weniger persönliche Details teilen, Beiträge regelmäßig löschen und nicht dieselben Informationen auf mehreren Plattformen preisgeben.

Denn wie Marc Juárez, Dozent für Cybersicherheit an der Universität Edinburgh, gegenüber The Guardian sagte: "Diese Studie zeigt, dass wir unsere Praktiken überdenken sollten".

URL dieses Artikels:

https://www.heise.de/-11204681

Links in diesem Artikel:

[1] https://arxiv.org/pdf/2602.16800

[2] https://www.theguardian.com/technology/2026/mar/08/ai-hackers-social-media-accounts-study

[3] https://arstechnica.com/security/2026/03/llms-can-unmask-pseudonymous-users-at-scale-with-surprising-accuracy/

[4] https://cyberscoop.com/ai-deanonymization-risks-online-anonymity-study/

Copyright © 2026 Heise Medien

Der Ölpreis hat die Marke von 100 US-Dollar durchbrochen

Energiepreise steigen seit Iran-Krieg stark. Gas verteuerte sich um 40 Prozent, Heizöl um 50 Prozent. Was Verbraucher jetzt wissen und tun sollten.

Seit Beginn des Iran-Krieges und der de-facto Blockade der Straße von Hormus klettern die Energiepreise in Europa deutlich nach oben.

Am niederländischen Handelsplatz TTF, dem wichtigsten Referenzwert für europäisches Gas, sprang der Preis auf inzwischen über 60 Euro je Megawattstunde – rund 40 Prozent über dem Niveau vor der Eskalation, als der Durchschnittspreis im Januar und Februar 2026 noch bei etwa 36 Euro lag.

Die Entwicklung weckt Erinnerungen an den Beginn des Ukraine-Kriegs 2022, als der Gaspreis bereits im ersten Monat auf über 220 Euro je Megawattstunde schoss und die Strompreise an der europäischen Börse historische Höchststände von 488 Euro erreichten.

Auslöser des aktuellen Preisschubs ist die iranische Blockade der Straße von Hormus, durch die rund ein Fünftel der weltweiten Flüssiggaslieferungen (LNG) transportiert wird.

Der katarische Energieriese QatarEnergy seine Gasexporte vorübergehend eingestellt [1] und die LNG-Produktion vollständig heruntergefahren. Brancheninsidern zufolge dürfte es mindestens vier Wochen dauern, bis die Anlagen wieder normal laufen.

Zugleich sind die Gasspeicher in Europa weitgehend leer und Russland überlegt sich, den für 2027 geplanten kompletten Lieferstopp an die EU vorzuziehen.

Asiatische Abnehmer suchen bereits nach Ersatz für die ausgefallenen katarischen Lieferungen – ein globaler Wettbewerb um verfügbare LNG-Mengen, der auch die europäischen Preise nach oben treibt.

Sollte die Unterbrechung länger anhalten, halten Analysten der Großbank ING Gaspreise von 80 bis 100 Euro je Megawattstunde für möglich [2]. Goldman Sachs rechnet [3] bei einem einmonatigen Ausfall mit einem TTF-Preis von rund 74 Euro bis Ende März. Das Analysehaus ICIS sieht [4] den Preis bei einer dreimonatigen Blockade sogar bei 90 Euro.

Steigende Gaspreise können sich über das sogenannte Merit-Order-Prinzip direkt auf die Strompreise durchschlagen.

An den europäischen Strombörsen werden Kraftwerke nach ihren Produktionskosten eingesetzt: Zuerst liefern günstige Erzeuger wie Wind-, Solar- oder Wasserkraft, danach kommen teurere Anlagen zum Zug. Den Börsenpreis bestimmt am Ende jedoch das teuerste Kraftwerk, das noch zur Deckung der Nachfrage benötigt wird – häufig ein Gaskraftwerk. Steigen die Gaspreise, verteuert sich damit der Strom für alle Marktteilnehmer, selbst wenn er aus erneuerbaren Quellen stammt.

Allerdings dürfte der Effekt auf den Strompreis nach Einschätzung [5] der Verbraucherzentrale Schleswig-Holstein geringer ausfallen als beim Gas selbst – das hat bereits die Energiepreiskrise 2022 gezeigt.

Für Verbraucher zeigen sich die Veränderungen am Energiemarkt unterschiedlich schnell. Kunden mit dynamischen oder flexiblen Stromtarifen bekommen steigende Börsenpreise meist unmittelbar zu spüren. Haushalte mit langfristigen Festpreisverträgen bemerken die Entwicklung dagegen oft erst mit Verzögerung, wenn die Preisgarantie ausläuft.

Die Vergleichsplattform Verivox gibt an [6], dass sich bei den Neukundenpreisen für Gas bisher kein Anstieg abzeichnet. Im Gegenteil: Gas kostet derzeit mit 8,4 Cent pro Kilowattstunde sogar weniger als vor einem Jahr (10,2 Cent).

Das Gaspreisbarometer des Verbraucherportals Finanztip verzeichnet allerdings bereits einen leichten Anstieg [7]. Der berechnete Mittelwert liegt bei 9,81 Cent pro Kilowattstunde für Verträge mit 12 Monaten Preisgarantie (Stand: 5. März).

Sollten die Börsenpreise auf hohem Niveau verharren, sei in den kommenden Wochen auch mit steigenden Neukundenpreisen zu rechnen, so Verivox. Die Nachfrage nach Gastarifen ist laut der Plattform bereits sprunghaft gestiegen: Aktuell würden mehr als doppelt so viele neue Gasverträge abgeschlossen wie noch vor einer Woche.

Auch bei Fernwärme drohen Preiserhöhungen, da die Preisformeln vieler Anbieter direkt an die Gaspreisentwicklung gekoppelt sind – allerdings oft mit einem Zeitverzug von bis zu einem Jahr.

Konkret beziffert: Der Anstieg des Börsenpreises von 32 auf 50 Euro je Megawattstunde entspricht umgerechnet rund 1,8 Cent pro Kilowattstunde. Bei einem typischen Jahresverbrauch von 20.000 Kilowattstunden Gas wären das etwa 360 Euro Mehrkosten. Sollte der TTF-Preis auf 92 Euro steigen, läge der Aufschlag bei rund 6 Cent pro Kilowattstunde.

Während sich Gas- und Strompreise für Endkunden erst mit Verzögerung verändern, schlagen die gestiegenen Ölpreise an Tankstellen und beim Heizölkauf sofort durch.

Eine Standardlieferung von 3.000 Litern Heizöl kostete laut dem Portal Esyoil [8] am Freitag vor Kriegsbeginn noch rund 96 Euro pro 100 Liter, am darauffolgenden Montag bereits 115 Euro und zuletzt 144 Euro.

Auch an der Zapfsäule sind die Auswirkungen angekommen. Laut Daten des SWR-Datenmonitors [9] verteuerte sich eine 50-Liter-Tankfüllung je nach Kraftstoff bis zum 6. März um 8,50 Euro (Super) bis 16 Euro (Diesel).

Allerdings: Heizöl dürfte in Deutschland kaum knapp werden, da das Rohöl größtenteils nicht aus dem Nahen Osten, sondern aus Norwegen, den USA und Kasachstan stammt. Hamsterkäufe sind daher nicht sinnvoll.

Verbraucher sollten jetzt eine Reihe von Maßnahmen treffen, um sich zumindest so gut wie möglich gegen die drohende Energiekrise abzusichern:

Steht ein Auto-Neukauf ohnehin an, und passt das Nutzerprofil (z.B. Pendeln mit Kurzstrecke), kann die Anschaffung eines günstigen E-Kleinwagens jetzt Sinn machen – auch, um laufende Zuschüsse [14] abzugreifen. Hersteller wie BYD oder Dacia bieten günstige E-Autos für teilweise deutlich unter 20.000 Euro an. Die hohen Spritpreise verkürzen die Amortisationszeit deutlich, weswegen zu überlegen ist, die Anschaffung vorzuziehen.

Wer Hauseigentümer ist und über die nötigen Mittel verfügt, kann sich langfristig besser gegen schwankende Energiepreise absichern.

Die Kombination aus Wärmepumpe, Photovoltaikanlage und Ladestation für ein Elektroauto ermöglicht es, einen großen Teil des eigenen Energiebedarfs mit selbst erzeugtem Strom zu decken. Ebenso hilft eine energetische Sanierung – etwa durch Dämmung, neue Fenster oder eine neue Haustür –, den Energieverbrauch dauerhaft zu senken.

Wie sich die Situation weiterentwickelt, hängt entscheidend von der Dauer des Krieges und der Blockade der Straße von Hormus ab. Bei einer raschen Entspannung könnten die Auswirkungen auf Haushaltskunden gering bleiben. Dauert der Krieg jedoch länger, was nicht unwahrscheinlich ist, müssen sich Verbraucher auf deutlich höhere Energiekosten einstellen.

URL dieses Artikels:

https://www.heise.de/-11203846

Links in diesem Artikel:

[1] https://www.heise.de/tp/article/Katar-stoppt-Erdgas-Exporte-und-warnt-vor-monatelangen-Ausfaellen-11202200.html

[2] https://static.wertpapiere.ing.de/investieren/boersenundmaerkte/nachrichten/nachricht/DPA.2349197

[3] https://www.investing.com/news/commodities-news/goldman-raises-firsthalf-european-natural-gas-price-forecast-amid-iran-strikes-4537024

[4] https://www.trasportoeuropa.it/english/hormuz-crisis-could-push-european-gas-to-90-euros-per-mwh/

[5] https://www.energie-fachberater.de/news/irankrieg-energiekrise-tipps-fuer-gas-und-stromkunden.php

[6] https://www.tagesschau.de/wirtschaft/energie/gaspreise-tarife-verivox-100.html

[7] https://www.finanztip.de/gaspreisvergleich/gaspreis-gaskosten/

[8] https://www.esyoil.com/

[9] https://www.swr.de/swraktuell/tanken-im-ausland-preisunterschiede-100.html

[10] https://www.check24.de/

[11] https://www.verivox.de/

[12] https://www.finanztip.de/heizoel/

[13] https://www.finanztip.de/guenstig-tanken/

[14] https://www.adac.de/rund-ums-fahrzeug/elektromobilitaet/elektroauto/foerderung-elektroautos/

Copyright © 2026 Heise Medien

Studio Display in zweiter Generation: Reichen die Neuerungen.

(Bild: Andreas Wodrich / heise medien)

Wer einen Apple-Bildschirm möchte, kommt am Studio Display nicht vorbei. Im Test untersuchen wir, ob die Neuauflage den Preis rechtfertigt.

Für viele Mac-Nutzer ist das Studio Display mit seinem Design und der 5K-Auflösung alternativlos. Für die Neuauflage polierte Apple an vielen Stellen nach und baut unter anderem modernere Ports mit Thunderbolt 5 ein.

Ausgerechnet beim Herzstück des 1700 Euro teuren Monitors (ab 1641,89 €) [1] (ab 1641,89 €) [1], dem Panel, wagt der Hersteller allerdings keine Änderungen.

Wir haben die Neuauflage vermessen, die neuen Thunderbolt-Optionen ausprobiert und geprüft, ob Apples 5K-Display der wachsenden Konkurrenz technisch noch Paroli bietet.

URL dieses Artikels:

https://www.heise.de/-11204379

Links in diesem Artikel:

[1] https://heise.de/preisvergleich/apple-studio-display-2026-mfex4fd-a-a3744140.html?ccpid=hocid-mac-and-i&cs_id=1206858352

Copyright © 2026 Heise Medien

MacBook Pro M5 Max: Nochmal etwas schneller.

(Bild: Andreas Wodrich / heise medien)

Apple hat bei seinen MacBook Pros im März die Prozessorvarianten M5 Pro und Max eingeführt. Im Test untersuchen wir Performance, SSD und mehr.

Ende 2024 hatte Apple die M4-Chips auf das MacBook Pro gebracht und zwar alle drei Varianten auf einmal. Die jüngste Upgrade-Runde zog sich hingegen über fünf Monate hin: Im Oktober 2025 kam das MacBook Pro mit einfachem M5 [1] [1] in den Handel, zusammen mit dem iPad Pro M5 und der Vision Pro M5. Der Verkaufsstart für die MacBook Pros mit M5 Pro und M5 Max folgt nun aber erst am 11. März.

Über die Gründe der Verzögerung schweigt sich Apple aus, es könnte aber mit der neu entwickelten Fusion-Architektur zusammenhängen, die beim M5 Pro und M5 Max erstmals zum Einsatz kommt. Das Design kombiniert zwei Dies zu einem System on a Chip (SoC).

Es umfasst wie gehabt eine leistungsstarke CPU, eine skalierbare GPU, eine Media Engine, einen Controller für den gemeinsamen Arbeitsspeicher, eine Neural Engine und Unterstützung für Thunderbolt 5. Inwieweit es sich von der beim Ultra-Chip verwendeten Interposer-Technik, der zwei Max-Chips auf Silikonebene verbindet, unterscheidet, ist unklar.

URL dieses Artikels:

https://www.heise.de/-11204665

Links in diesem Artikel:

[1] https://www.heise.de/tests/Staubsaugen-im-Apple-Home-Diese-Haushaltsroboter-lohnen-sich-10751677.html

Copyright © 2026 Heise Medien

(Bild: Apple / Screenshot YouTube)

Zum 50. Jubiläum von Apple spricht CEO Tim Cook über das Erbe von Steve Jobs, gesellschaftliche Werte in turbulenten Zeiten und die langfristige Planung.

Apple [1] wird dieses Jahr 50 Jahre alt. Für Apple-CEO Tim Cook und das Unternehmen ist dies eine besondere Herausforderung: Die Fähigkeit, zurückzublicken, habe man erstmal entwickeln müssen, scherzte der Apple-Chef jetzt in einem seltenen Rückblick über die Geschichte, Kultur und Zukunft des Konzerns. Normalerweise blicke Apple im Alltag bevorzugt nach vorne.

Im Gespräch mit dem Journalisten David Pogue ging Cook in dem Interview [2], das im US-amerikanischen Fernsehsender CBS ausgestrahlt wurde, auch auf die Bedeutung von Werten in politisch turbulenten Zeiten ein. Cook sieht sich hier aktuell wegen seiner Nähe zu US-Präsident Donald Trump Kritik ausgesetzt. Insbesondere ein Besuch im Weißen Haus trotz eskalierender Gewalt in Minnesota [3] sorgte zuletzt für massive Verärgerung in der Belegschaft. Der Apple-Chef zog überdies eine für ihn ungewohnt persönliche Bilanz: über den Zustand des Unternehmens bei seinem Eintritt 1997, Steve Jobs’ letzten Rat an ihn als designierten CEO – und warum Apples Erfolg seiner Meinung nach schlicht nicht kopierbar ist.

Tim Cook hat Apple seit seinem Amtsantritt als CEO im Jahr 2011 stärker als sein Vorgänger Steve Jobs auch in gesellschaftspolitischen Fragen positioniert: Apple hat sich Barrierefreiheit, Datenschutz als Menschenrecht, Nachhaltigkeit und Klimaschutz, Bildung und Diversität auf die Fahnen geschrieben. Doch seit der zweiten Amtszeit von Donald Trump, dessen Regierung zum Beispiel den Klimaschutz stark zurückgenommen hat oder Diversitätsprogramme für Unternehmen zurückfährt, werden Apples Werte auf die Probe gestellt. Cook, der mit einer Glasplakette mit 24-Karat-Gold-Sockel, die er Trump überreichte, für Diskussionen sorgte, bekennt sich in dem Interview zu Apples Werten. In einem internen Treffen versprach Cook zudem, sich verstärkt für ausländische Mitarbeiter und eine humane Einwanderungspolitik [4] einzusetzen. Diese seien in chaotischen Phasen sogar wichtiger und nicht weniger relevant, erklärte er.

„Tu einfach das Richtige“, habe Steve Jobs seinem Nachfolger aufgetragen. „Frag nie, was ich tun würde.“ Und auch wenn Cook betont, dass er diesem Rat des Apple-Mitbegründers gefolgt sei, wird in dem Interview doch deutlich, wie sehr er sich dem Erbe von Jobs verpflichtet fühlt. Dieser sei eine Person gewesen, „wie sie einmal in tausend Jahren vorkommt“, sagt er. Und seine größte Erfindung sei nicht ein Produkt gewesen, sondern Apple selbst.

Die Dankbarkeit, die Cook ausstrahlt, begründet er mit seinem eigenen Werdegang bei Apple. Als er vor knapp 28 Jahren bei Apple angefangen habe, befand sich das Unternehmen im Überlebenskampf. Der Quartalsumsatz habe nur noch bei 1,3 bis 1,4 Milliarden US-Dollar gelegen und es sei unklar gewesen, ob man den verbliebenen Mitarbeitern im nächsten Monat noch den Lohn zahlen könnte. Frühere Weggefährten hätten ihm, der damals beim weltweit größten PC-Konzern Compaq arbeitete, davon abgeraten, zu Apple zu wechseln. Doch Cook folgte dem Ruf von Jobs trotzdem.

Heute ist Apple drei- bis viermal so groß und profitabel wie zu Beginn von Cooks Zeit als CEO. In den 15 Jahren sind rund 100.000 Mitarbeiter hinzugekommen. Doch Apple ist auch mehr und mehr ins Fadenkreuz der Regulierung geraten. Cook betont, was das Unternehmen bei verschiedenen Gelegenheiten immer wieder sagt: Zu viel Regulierung könne Innovation bremsen. Apples Erfolgsrezept seien nicht die Produkte oder Ideen alleine, sondern die Kultur und die Menschen, die das Unternehmen prägen.

Zur Kultur zählt Cook neben dem disziplinierten Blick nach vorn und dem Blicken um die Ecke vor allem den Fokus. Das berühmte Nein zu tausend Dingen, um zu einer Sache Ja zu sagen, werde weiterhin beherzigt. Außerdem seien Kollaboration und Exzellenzanspruch bei Apple weitere Prioritäten neben der Verzahnung von Hard- und Software sowie Dienstleistungen.

Die Feierlichkeiten zum 50. von Apple, auf die Cook nicht weiter einging, sollen das Unternehmen aber nicht vom Kurs abbringen. In den Laboren werde bereits an Projekten gearbeitet, die mehrere Jahre in der Zukunft liegen, ließ Cook durchblicken. Alleine die eigenen Chips, der Apple Silicon, zwinge das Unternehmen zu einer besonders langfristigen Planung. Für den Blick in den Rückspiegel bleibt da außer bei besonderen Gelegenheiten keine Zeit.

URL dieses Artikels:

https://www.heise.de/-11204581

Links in diesem Artikel:

[1] https://www.heise.de/thema/Apple

[2] https://youtu.be/xLqUXIwPGUo

[3] https://www.heise.de/news/Trump-Besuch-trotz-Gewalteskalation-Kritik-an-Apple-Chef-Tim-Cook-kocht-hoch-11157666.html

[4] https://www.heise.de/news/Nach-Minnesota-Vorfaellen-Tim-Cook-will-fuer-auslaendische-Mitarbeiter-lobbyieren-11171235.html

[5] https://www.heise.de/mac-and-i

[6] mailto:mki@heise.de

Copyright © 2026 Heise Medien

(Bild: Henk Vrieselaar/Shutterstock.com)

Niederländische Geheimdienste warnen vor Angriffen auf Militärs und Beamte, bei denen Messenger-Konten ohne technische Sicherheitslücken übernommen werden.

Die Sicherheit von Messenger-Diensten wie Signal und WhatsApp basiert maßgeblich auf ihrer starken Ende-zu-Ende-Verschlüsselung. Das macht sie nun zum Ziel einer „großangelegten weltweiten“ Spionagekampagne, warnen die niederländischen Geheimdienste MIVD und AIVD, die für die Bereiche Militär sowie Inlandsschutz und Spionageabwehr zuständig sind. Russische Staatshacker versuchten derzeit weltweit, Zugriff auf die Konten von hochrangigen Würdenträgern, Militärpersonal und Regierungsbeamten zu erlangen.

Laut dem Hinweis der beiden Spionagebehörden [1] stehen auch Journalisten und andere Personen von strategischem Interesse für den russischen Staat im Fadenkreuz der Operation. Diese mache deutlich, dass die sicherste Verschlüsselung wenig bringe, wenn der Zugang zum Endgerät oder zum Nutzerkonto selbst kompromittiert werde.

Die Angreifer verwenden laut MIVD und AIVD keine technischen Schwachstellen oder Zero-Day-Exploits in der Software der Messenger. Stattdessen setzten sie auf manipulatives Social Engineering, um legitime Funktionen der Apps gegen die Nutzer zu verwenden, heißt es. Eine häufig beobachtete Methode sei die Täuschung über gefälschte Support-Chatbots. Die staatlichen Hacker gäben sich etwa als offizieller Signal-Support aus und versuchten, den Opfern Verifizierungs- oder PIN-Codes zu entlocken. Sobald ein Nutzer solche Informationen preisgibt, können die Angreifer das Konto auf einem eigenen Gerät übernehmen.

Eine weitere Taktik soll der Missbrauch der Funktion für verknüpfte Geräte sein. Dabei koppelten die Angreifer heimlich ein weiteres Gerät mit dem bestehenden Account. Dies ermögliche es ihnen, alle ein- und ausgehenden Nachrichten in Echtzeit mitzulesen, ohne dass das Opfer den Fernzugriff unmittelbar bemerke.

Die Folgen einer erfolgreichen Übernahme können gravierend sein. Die Übeltäter lesen nicht nur private Chats mit, sondern erhalten auch Zugriff auf alle Gruppenunterhaltungen, in denen das Opfer Mitglied ist. In diesen Kanälen vermuten die russischen Akteure sensible Informationen, die aufgrund des hohen Vertrauens in die App-Sicherheit dort oft unvorsichtig geteilt werden. Um der Bedrohung entgegenzuwirken, haben die niederländischen Behörden einen Leitfaden veröffentlicht [2], der Nutzer für verdächtige Anzeichen sensibilisieren soll.

Die Geheimdienste raten dazu, bei jedem Verdacht auf Unregelmäßigkeiten sofort die zuständigen IT-Sicherheitsstellen zu informieren. Die Identität verdächtiger Konten sollte über alternative Kommunikationswege wie E-Mail oder Telefon verifiziert werden. Erhärte sich ein Verdacht, müssten die betroffenen Accounts umgehend durch den Gruppenadministrator entfernt werden. Falls der Administrator selbst kompromittiert zu sein scheint, bleibt als sicherste Option nur das Verlassen der bestehenden Gruppe und die Eröffnung eines neuen, gesicherten Kommunikationskanals.

Die Spionageaktivitäten finden vor dem Hintergrund einer verschärften Internetzensur in Russland seit Beginn der Ukraine-Invasion statt. Dienste wie WhatsApp und Signal sind in Russland bereits offiziell gesperrt [3]. Zuletzt geriet auch Telegram verstärkt unter Druck. Gegen dessen Gründer Pawel Durow ermitteln russische Behörden [4] im Rahmen eines Strafverfahrens. Sie werfen ihm die Unterstützung terroristischer Aktivitäten vor, da der Messenger angeblich bei zahlreichen Straftaten als Werkzeug genutzt worden sei. Durow selbst hat Russland bereits vor Jahren verlassen, um dem wachsenden Einfluss des Staates auf seine Plattform zu entgehen.

Die gleichzeitige Verfolgung von Plattformbetreibern im Inland und die gezielten Angriffe auf ausländische Nutzerkonten verdeutlichen die Doppelstrategie des Kreml: Er will die Kontrolle über den digitalen Informationsraum sowohl defensiv als auch offensiv sichern.

URL dieses Artikels:

https://www.heise.de/-11204731

Links in diesem Artikel:

[1] https://www.aivd.nl/actueel/nieuws/2026/03/09/rusland-voert-cybercampagne-uit-tegen-signal--en-whatsapp-accounts

[2] https://www.aivd.nl/documenten/2026/03/09/cyberadvies.-phishing-via-chatapps-signal-en-whatsapp

[3] https://www.heise.de/news/Zugriff-nur-noch-per-VPN-Russland-blockiert-jetzt-auch-WhatsApp-komplett-11175277.html

[4] https://www.heise.de/news/Terror-Unterstuetzung-Russland-ermittelt-gegen-Telegram-Gruender-11189928.html

[5] https://www.heise.de/newsletter/anmeldung.html?id=ki-update&wt_mc=intern.red.ho.ho_nl_ki.ho.markenbanner.markenbanner

[6] mailto:nie@heise.de

Copyright © 2026 Heise Medien

(Bild: heise medien)

Die NIS2-Registrierungsfrist ist verstrichen, doch viele Unternehmen haben sich noch nicht angemeldet. Darum stockt die Umsetzung der Security-Richtlinie.

Vom viel zu früh verstorbenen Science-Fiction-Autor Douglas Adams stammt das Zitat: „Ich liebe Deadlines. Ich mag dieses Rauschen, das sie im Vorbeiflug erzeugen.“ Tausende deutsche Unternehmen hatten wohl eher die Rauschunterdrückung aktiviert, als am 6. März 2026 die Registrierungsfrist für NIS2-Einrichtungen verstrichen ist: Bis zu diesem Datum, drei Monate nach Inkrafttreten des zugrundeliegenden Gesetzes, sollten sich alle „wichtigen“ und „besonders wichtigen“ Einrichtungen beim gemeinsamen Portal der Bundesämter für Sicherheit in der Informationstechnik (BSI) und für Bevölkerungsschutz und Katastrophenhilfe (BBK) angemeldet haben. Etwa 11.500 Behörden, Unternehmen und andere kritische Einrichtungen sind jetzt registriert – von der Feststellung einer lückenlosen Pflichterfüllung der ungefähr 30.000 zu registrierenden Unternehmen ist man also weit entfernt.

Woran mag es liegen, dass so wenige bisher die Registrierung geschafft haben? Ist das Verfahren zur Registrierung vielleicht zu kompliziert? Das zumindest hört man gelegentlich von denen, die es schon versucht haben, im Ablauf aber stecken geblieben sind. Bei der Einrichtung des für die Teilnahme an der BSI-Plattform erforderlichen Unternehmenskontos wird schon zu Beginn der Nachweis einer Vertretungsberechtigung verlangt – logisch, aber dazu muss zunächst ein ELSTER-Organisationszertifikat beantragt werden, das per Post ans Unternehmen versandt wird. Kein Problem, aber sicher zeitaufwändiger, als viele es sich vorgestellt haben. Dabei hat die Behörde sich sogar besonders viel Mühe gegeben, den Weg in die Registrierung zu ebnen: Eine Schritt-für-Schritt-Anleitung, die das BSI am Portaleingang bereitstellt, lässt kaum Fragen offen.

Wenn dann der Zugang zum Portal erfolgreich eingerichtet ist, verlangt die Registrierung allerdings auch Angaben, die vielleicht nicht sofort zur Hand sind – der öffentliche IP-Adressraum zum Beispiel, der zu den obligatorischen Basisinformationen für jedes registrierte Unternehmen gehört. Sinn der Sache ist es, dem BSI ein Monitoring von ungewöhnlichem Datenverkehr und auch Portscans zu ermöglichen, um unabhängig von der firmeninternen Überwachung des Netzwerks von der Behörde Warnhinweise über potenzielle Vorfälle zu erhalten. Für Anbieter digitaler Dienste sind diese Angaben auch auf die IP-Adressen in ihrem Kundensegment auszudehnen, nicht nur auf den Adressraum der eigenen Einrichtung.

Auch wenn die Registrierung selbst also nicht ganz trivial ist, sind es bei vielen Unternehmen gar nicht die formalen Voraussetzungen, die sie an einer termingerechten Anmeldung hindern. Woran es offensichtlich mangelt, ist eher die Erkenntnis – oder Anerkennung – der eigenen Betroffenheit. Aus zahllosen Gesprächen mit Geschäftsführungen, IT-Leitungen und anderen Entscheidungsträgern ist bekannt, dass viele immer noch verunsichert sind, welche Kriterien bezüglich der NIS2-Relevanz ihrer spezifischen Geschäftstätigkeit gelten. Und nicht nur das: Selbst größere Unternehmensgruppen unterschätzen, dass beispielsweise eine separate Konzerngesellschaft mit den ausgelagerten IT-Diensten für die übrigen Gruppenunternehmen auch für sich allein betrachtet unter die Regulierung fallen kann. Hierbei handelt es sich nämlich um einen sogenannten Managed Services Provider, sofern die Schwellen der Mitarbeiteranzahl oder Umsätze überschritten sind.

Tatsächlich gibt es Grenzfälle, bei denen es ohne Rechtsgutachten kaum gelingt, die wichtigste Frage zu beantworten: Sind wir als Unternehmen im Anwendungsbereich des Gesetzes oder nicht? Wenn im verarbeitenden Gewerbe etwa unklar bleibt, ob die in der NIS2-Richtlinie der EU aufgeführten – und im deutschen BSI-Gesetz Wort für Wort identischen – Produkt- und Dienstleistungskategorien den eigenen Betrieb zutreffend beschreiben, ist eine gewisse Ratlosigkeit verständlich. Unter diesen Bedingungen aber auf die Registrierung zu verzichten oder erst einmal abzuwarten, ist nicht zu empfehlen.

Umgekehrt gibt es auch Unternehmen, die sich freiwillig und vorsorglich registriert haben – trotz begründeter Zweifel, ob sie überhaupt dazu verpflichtet wären. Auf diese Weise entgehen sie jedenfalls eventuellen Bußgeldern, die schon bei unterlassener Registrierung bis zu einer halben Million Euro betragen können. Unwahrscheinlich, dass die Behörde gleich zu Beginn der neuen Regulierung massenhaft Ordnungswidrigkeiten ahnden wird, aber die Einhaltung geltender Gesetze einfach solange zu verweigern, bis dann wirklich Sanktionen drohen, wäre doch mehr als heikel.

Grundsätzlich ist die Bereitschaft zur Umsetzung von Maßnahmen zur Stärkung der Informationssicherheit aber vorhanden, auch wenn sie Geld kosten. Seit dem Beginn des russischen Angriffskriegs auf die Ukraine sind auch in Deutschland die Investitionen in die Cybersicherheit rasant gestiegen. Folgt man Umfrageergebnissen, wie sie zum Beispiel der Bitkom-Verband oder Schwarz Digit Research zusammengetragen haben, ist der Anteil der IT-Sicherheitsausgaben mittlerweile doppelt so hoch wie damals. Prozentual zum Gesamtbetrag der IT-Budgets in den befragten Unternehmen lagen sie 2022 im Schnitt noch bei neun, heute 18 Prozent. 41 Prozent der Unternehmen liegen sogar über der magischen „Cyber-Quote“, die der ehemalige BSI-Präsident Arne Schönbohm vor Jahren als Richtschnur für – O-Ton – „jedes Digitalisierungsprojekt“ verkündete: Zwanzig Prozent der Ausgaben sollten demnach mindestens für die Cybersicherheit bereitgestellt werden.

Wenn trotz dieser auskömmlichen Investitionsbereitschaft immer noch viele Unternehmen angeben, sie seien noch nicht so weit, ist die Zurückhaltung nicht leicht zu rechtfertigen. Vom Zeitpunkt der Verabschiedung der europäischen Cybersicherheitsrichtlinie im Dezember 2022 bis zum Inkrafttreten des deutschen Umsetzungsgesetzes im Dezember 2025 hätte es genügend Gelegenheit gegeben, sich mit den Auswirkungen auf das eigene Unternehmen zu beschäftigen. Welche Sektoren und Unternehmenskennzahlen Grundlage für die Zuerkennung des Status als NIS2-Verpflichteten sind, worin diese Pflichten im Einzelnen bestehen und welche konkreten Maßnahmen als Mindestsicherheitsanforderungen im Raum stehen, das alles ist seit mehr als drei Jahren bekannt.

Im Bereich der gleichzeitig mit der NIS2 und der Partnerrichtlinie CER in Kraft getretenen EU-Verordnung für den Finanzsektor, genannt DORA [1], zeigte sich schon Anfang 2025, dass die Umsetzung sehr viel schneller vonstatten geht, wenn regulierte Institutionen von ihrer Aufsichtsbehörde hart in die Pflicht genommen werden. Seit über einem Jahr sind alle relevanten IT-Dienstleister der Banken und anderer Finanzinstitute gegenüber der Bundesanstalt für Finanzdienstleistungsaufsicht (BaFin) benannt und mit Angaben über die Umsetzung von Cyber-Risikomaßnahmen versehen. Zur mittlerweile flächendeckenden Compliance im Sinne dieser Regulierung hat sicher beigetragen, dass die BaFin ihre Aufsichtsfunktionen im Bedarfsfall oder bei begründetem Verdacht der Nicht-Umsetzung wichtiger Maßnahmen auf die Zulieferer ausdehnen kann. Ein Besuch der Aufseher kann also auch beim ausgelagerten, unabhängigen IT-Betrieb erfolgen, nicht nur bei der Bank, für die er tätig ist.

Wenn wenigstens die Registrierung dann endlich erfolgt ist, wird es für viele der 30.000 direkt regulierten, aber auch die schätzungsweise 70.000 nur mittelbar von den Vorschriften aus der NIS2 betroffenen Einrichtungen höchste Zeit, sich mit der Implementierung der technischen und organisatorischen Compliance zu beschäftigen. Der berühmte Katalog der zehn Mindestsicherheitsanforderungen aus § 30 (2) BSI-Gesetz enthält keine radikalen Neuerungen oder unzumutbare Auflagen für die Informationssicherheit der Unternehmen – das meiste davon ist seit Jahren als geübte Praxis in vielen IT-Abteilungen und den übrigen Organisationseinheiten längst der Normalfall. Von ein paar expliziten Zusätzen wie Multi-Faktor-Authentisierung oder Notfallkommunikation abgesehen, basiert die Zehn-Punkte-Liste der vorgeschriebenen Risikomanagementmaßnahmen ganz überwiegend auf internationalen Standards. Das steht zwar nicht explizit in Richtlinie oder Gesetz, weil kommerzielle Normen nicht unmittelbar Gegenstand der Gesetzgebung sein dürfen. De facto sind aber drei Viertel der in den zehn Punkten zusammengefassten Vorgaben identisch mit dem Informationssicherheitsmanagementsystem aus ISO 27001 – auch als Basis des BSI IT-Grundschutz-Kompendiums [2], das dieselbe Norm anders umsetzt.

Allen, die noch zögern, die Vorgaben zur Registrierungs- und Meldepflicht und zur Umsetzung der Cybersicherheitsmaßnahmen zu erfüllen, kann man nur daran erinnern, dass die Einhaltung von Gesetzen zum Wesenskern jeder unternehmerischen Tätigkeit gehört. Wer die NIS2 ignoriert oder ihre Umsetzung im eigenen Unternehmen verschleppt, kann rechtlich und materiell in größte Probleme geraten.

URL dieses Artikels:

https://www.heise.de/-11204285

Links in diesem Artikel:

[1] https://www.heise.de/hintergrund/DORA-Neue-Regulierung-fuer-mehr-Resilienz-in-der-Finanzbranche-9624238.html

[2] https://www.heise.de/hintergrund/IT-Grundschutz-Kompendium-2023-Neue-Bausteine-fuer-Outsourcing-7541630.html

[3] https://www.heise.de/ix

[4] mailto:fo@heise.de

Copyright © 2026 Heise Medien

(Bild: Volla)

Die Nutzung von Banking- und Bezahl-Apps auf Android-Smartphones mit Custom-ROMs ist ein Problem: Das will ein europäisches Industriekonsortium nun ändern.

Sicher mit einem Android-Smartphone bezahlen, ganz ohne Google-Dienste: Das ist der Plan, den das neu gegründete Industriekonsortium unter Führung der deutschen Volla Systeme GmbH entwickelt. Es handelt sich dabei um eine quelloffene Alternative zu Google Play Integrity. Bislang entscheidet die proprietäre Schnittstelle auf Android-Smartphones mit Google-Play-Diensten darüber, ob Banking-, Behörden- oder Wallet-Apps auf einem Smartphone laufen dürfen.

Hindernisse und Tipps beim Bezahlen mit einem Android [1]-Smartphone ohne offizielle Google-Dienste hat c’t in einem umfangreichen Artikel beleuchtet [2]. Einige der genannten Probleme will das europäische Industriekonsortium nun beheben. Dafür entwickelt die Gruppe, der neben Volla auch Murena, die das Custom-ROM /e/OS [3] entwickeln, Iodé [4] aus Frankreich und Apostrophy (Punkt) [5]aus der Schweiz angehören, ein sogenanntes „UnifiedAttestation“ für Google-freie mobile Betriebssysteme, überwiegend auf Basis des Android Open Source Projects (AOSP).

Laut Volla haben zudem ein europäischer und ein führender Hersteller aus Asien sowie Europäische Stiftungen wie die deutsche UBports-Stiftung Interesse zur Unterstützung angemeldet. Überdies würden Entwickler und Herausgeber staatlicher Apps aus Skandinavien prüfen, das neue Verfahren als „First Mover“ einzusetzen.

„Mit UnifiedAttestation [6] schaffen wir ein transparentes und vertrauenswürdiges Verfahren für die Sicherheitsprüfung, auf das Entwickler und Herausgeber von Apps gleichermaßen vertrauen können. Damit beseitigen wir die letzte Hürde für die Verwendung alternativer mobiler Betriebssysteme“, sagt Dr. Jörg Wurzer, Geschäftsführer der Volla Systeme GmbH und Initiator des Konsortiums. Ziel sei es, sich von der Kontrolle eines einzelnen US-Konzerns zu befreien – hin zu mehr digitaler Souveränität, heißt es.

Volla erläutert in seiner Ankündigung, dass Google mit Play Integrity [7] App-Entwicklern eine Schnittstelle bereitstellt, die prüft, ob eine App auf einem Gerät mit bestimmten Sicherheitsanforderungen ausgeführt wird. Dies betrifft vor allem Anwendungen aus „sensiblen Bereichen wie Identitätsnachweis, Banking oder digitale Wallets – einschließlich Apps von Regierungen und öffentlichen Verwaltungen“.

Das Unternehmen kritisiert, dass die Zertifizierung ausschließlich für Googles eigenes, proprietäres „Stock Android“ angeboten wird, nicht jedoch für Android-Versionen ohne Google-Dienste wie etwa /e/OS oder ähnliche Custom-ROMs. „Da dieses eng mit Google-Diensten und Google-Rechenzentren verflochten ist, entsteht ein strukturelles Abhängigkeitsverhältnis – und für alternative Betriebssysteme ein faktisches Ausschlusskriterium“, so das Unternehmen.

Aus Sicht des Konsortiums ergebe sich daraus zudem ein „sicherheitstechnisches Paradox“, denn „die Prüfung der Vertrauenswürdigkeit erfolgt durch genau jene Instanz, deren Ökosystem gleichzeitig vermieden werden soll“.

Die Alternative zu Google Play Integrity in Form der UnifiedAttestation soll dem Plan des Konsortiums zufolge modular aufgebaut und quelloffen entwickelt werden. Ähnlich wie Googles frei verwendbares AOSP (Android Open Source Project) soll es mit einer liberalen Apache-2.0-Lizenz veröffentlicht werden.

(Bild: Volla)

Weiter erklärt das Konsortium, dass UnifiedAttestation aus drei zentralen Elementen bestehen soll. Zum einen soll es ein „Betriebssystem-Dienst“ sein, der mit wenigen Zeilen Code in Apps integriert werden kann. Apps könnten darüber eine Anfrage stellen, ob das jeweilige Betriebssystem definierte Sicherheitsanforderungen erfülle. Zudem soll ein Validierungsdienst dezentral betrieben werden. Dieser prüfe dann, ob das Zertifikat eines Betriebssystems auf dem jeweiligen Gerät gültig ist. Das dritte Element ist eine offene Test-Suite. Diese soll zur „Prüfung und Zertifizierung eines Betriebssystems für ein konkretes Gerätemodell“ dienen.

Geplant sei darüber hinaus ein Peer-Review-Verfahren, mit dem die Mitglieder des Konsortiums ihre Betriebssysteme sowie Smartphone- oder Tablet-Modelle gegenseitig prüfen und zertifizieren. „Dadurch soll Transparenz geschaffen und Vertrauen durch Nachvollziehbarkeit ersetzt werden“.

„Wir wollen Vertrauen nicht zentralisieren, sondern transparent und öffentlich überprüfbar organisieren. Wenn Unternehmen die Produkte der Konkurrenz prüfen, können wir jenes Vertrauen stärken“, erklärt Dr. Wurzer. Ziel des Konsortiums ist es zudem, die neue Industrieinitiative als offenes Kooperationsformat unter dem Dach der Eclipse Foundation, der größten Open-Source-Foundation in Europa, zu etablieren. Erste Gespräche dazu hätten bereits begonnen.

URL dieses Artikels:

https://www.heise.de/-11204008

Links in diesem Artikel:

[1] https://www.heise.de/thema/Android

[2] https://www.heise.de/ratgeber/Wie-Banking-und-mobiles-Bezahlen-mit-Custom-ROMs-funktionieren-10640893.html

[3] https://www.heise.de/ratgeber/Ohne-Google-mit-Cloud-Einsteigerfreundliches-Custom-ROM-e-OS-im-Test-11149287.html

[4] https://www.heise.de/ratgeber/Raus-aus-der-Updatefalle-Wie-Lineage-und-iode-alte-Smartphones-retten-11149297.html

[5] https://www.heise.de/news/Punkt-MC03-Android-Smartphone-Made-in-Europe-ohne-Google-mit-Abo-11128698.html

[6] https://uattest.net/

[7] https://developer.android.com/google/play/integrity?hl=de

[8] https://www.heise.de/newsletter/anmeldung.html?id=ki-update&wt_mc=intern.red.ho.ho_nl_ki.ho.markenbanner.markenbanner

[9] mailto:afl@heise.de

Copyright © 2026 Heise Medien

(Bild: heise medien)

Die frisch erschienene Version 25.12.0 von OpenWrt unterstützt mehr Geräte und setzt auf einen neuen Paketmanager.

Das OpenWrt-Projekt hat die Version 25.12.0 der Open-Source-Router-Firmware veröffentlicht. Besonders stechen darin die zahlreichen unterstützten Geräte und der Wechsel auf eine neue Paketverwaltung hervor.

In den Release-Notes liefert OpenWrt [1] einen Überblick über die Änderungen. Als wichtigen Punkt vorneweg nennen die Entwickler, dass das Upgrade von OpenWrt 24.10 auf 25.12 in vielen Fällen vom sysupgrade-Werkzeug unterstützt wird, das versucht, die Konfiguration mitzumigrieren. Dennoch sollten Upgrade-Willige zuvor ein Backup ihrer Konfiguration anlegen, raten die OpenWrt-Programmierer. An OpenWrt [2] 25.12.0 haben die Entwickler über ein Jahr lang gearbeitet und kommen auf mehr als 4700 Quellcode-Commits seit Fassung 24.10. Der Codename „Dave’s Guitar“ soll der Erinnerung des im April 2025 verstorbenen Dave Täht dienen.

Der Paketmanager wechselt vom alten opkg zu apk (Alpine Package Keeper). Wichtigster Grund dafür ist, dass das OpenWrt-opkg nicht mehr unterstützt und apk weiterhin gepflegt wird. Nur wenige Paketnamen haben sich geändert. Ein Cheatsheet soll beim Umsteigen [3] hilfreiche Informationen liefern. Außerdem liefert OpenWrt nun eine webbasierte „attended.sysupgrade“-LuCI-App (ASU) mit. Auf Geräten mit größerem Flash-Speicher installiert OpenWrt außerdem das Kommandozeilen-Tool „owut“ (OpenWrt Upgrade Tool) standardmäßig mit. ASU soll auf neue OpenWrt-Versionen aktualisieren und Firmware-Images automatisch mit allen derzeit installierten Paketen zusammenbauen können. Dabei erhält es die Systemkonfiguration und erlaubt die Integration zusätzlicher installierter Pakete direkt in das SquashFS-Dateisystem. Das soll Upgrades deutlich vereinfachen: Mit nur wenigen Klicks in LuCI und nach kurzer Wartezeit steht ein angepasstes Firmware-Abbild bereit, das ohne weitere manuelle Eingriffe installiert wird.

Außerdem speichert OpenWrt in einem RAM-basierten Dateisystem den Befehlsverlauf der Shell. Der steht damit auch nach neuen Logins bereit. Das erspart unnötige Schreibzugriffe auf den Flash-Speicher, der nur eine begrenzte Zahl an Schreibzyklen verkraftet. Das lässt sich jedoch umstellen, sodass auch persistente Speicherung auf dem Flash-Speicher möglich ist. Das erhöht jedoch die Schreibzyklen und wirkt sich auf die Flash-Lebensdauer aus, warnen die Entwickler.

Hardwareseitig gibt es mehr Unterstützung für Realtek-Ziele, dort insbesondere mehr Switch-SoCs mit 10-GBit-Support. Das qualcommax-Ziel unterstützt zwei weitere SoCs. Neu dabei ist ein siflower-Build-Target und neue Sub-Targets für Allwinner-F1C100/200s-SoCs. Ebenfalls neu dabei ist der Microchip LAN969x-Switch-Chipsatz. Insgesamt kommt OpenWrt nun auf mehr als 2200 unterstützte Geräte. Seit OpenWrt 24.10 sind 180 neu dazugekommen.

Die Software ist ebenfalls aktueller: Der Linux-Kernel 6.12.71 kommt für alle Build-Targets zum Einsatz, außerdem sind die Stände von glibc 2.41, gcc 14.3.0, binutils 2.44 dabei. Als zentrale Komponenten sind nun die Fassungen busybox 1.37.0, dropbear 2025.89 und dnsmasq 2.91 Bestandteil von OpenWrt. OpenWrt 24.10 erreicht mit dem Release von OpenWrt 25.12.0 in sechs Monaten das Support-Ende, also gibt es dafür nach September 2026 keine Sicherheitsupdates mehr. Nutzer sollten daher die Zeit nutzen und zeitnah auf die neue Version aktualisieren.

Ende Oktober musste das OpenWrt-Projekt Sicherheitslücken schließen [4]. Die haben Angreifern etwa das Einschleusen und Ausführen von Schadcode oder das Ausweiten ihrer Rechte im System ermöglicht.

Siehe auch:

URL dieses Artikels:

https://www.heise.de/-11204136

Links in diesem Artikel:

[1] https://openwrt.org/releases/25.12/notes-25.12.0

[2] https://www.heise.de/thema/OpenWRT

[3] https://openwrt.org/docs/guide-user/additional-software/opkg-to-apk-cheatsheet

[4] https://www.heise.de/news/OpenWRT-Updates-schliessen-Sicherheitsluecken-in-Router-Betriebssystem-10811056.html

[5] https://www.heise.de/download/product/openwrt-59994?wt_mc=intern.red.download.tickermeldung.ho.link.link

[6] https://www.heise.de/newsletter/anmeldung.html?id=ki-update&wt_mc=intern.red.ho.ho_nl_ki.ho.markenbanner.markenbanner

[7] mailto:dmk@heise.de

Copyright © 2026 Heise Medien

(Bild: testing/Shutterstock.com)

Google hat ein Open-Source-Tool vorgestellt, das Zugriff auf Workspace-Dienste via Kommandozeile ermöglicht. Es unterstützt KI-Agenten und nutzt das MCP.

Google hat ein neues Kommandozeilenwerkzeug für Workspace veröffentlicht, mit dem Entwickler und Administratoren direkt auf Dienste wie Gmail, Drive, Calendar, Sheets und Docs zugreifen können. Die Google Workspace CLI (gws) steht als Open-Source-Software unter Apache-2.0-Lizenz und baut ihre Befehlsstruktur dynamisch aus dem Google Discovery Service auf. Innerhalb von wenigen Tagen nach Veröffentlichung Anfang März 2026 stieß das Projekt auf großes Interesse auf GitHub.

Das liegt auch an der technischen Ausrichtung: Das Werkzeug richtet sich sowohl an Nutzer als auch an KI-Agenten. Es unterstützt das Model Context Protocol (MCP), wodurch sich KI-Systeme wie Claude direkt mit Workspace-Daten verbinden können. Die CLI bringt mehr als 40 vordefinierte Agent-Skills mit, die Aufgaben wie E-Mail-Triage, Meeting-Vorbereitung oder Dateiorganisation automatisieren sollen. Entwickler können eigene Skills für ihre spezifischen Anforderungen erstellen.

Ein technischer Vorteil gegenüber herkömmlichen API-Clients liegt in der dynamischen Befehlserstellung: Die CLI lädt die Befehlsdefinitionen zur Laufzeit aus dem Discovery Service und speichert sie für 24 Stunden zwischen. In diesem Zeitraum stehen neue Workspace-API-Endpunkte automatisch zur Verfügung, ohne dass die Software aktualisiert werden muss. Das Werkzeug bietet zudem Funktionen wie Schema-Introspection, automatische Paginierung und strukturierte JSON-Ausgabe.

Die Installation erfolgt wahlweise über npm (npm install -g @googleworkspace/cli) oder als fertiges Binary. Alternativ lässt sich die in Rust entwickelte Software auch mit Cargo kompilieren. Die Authentifizierung unterstützt OAuth, Service Accounts und Domain Wide Delegation, wobei die Credentials mit AES-256-GCM verschlüsselt werden. Granulare Berechtigungen lassen sich über Google IAM und Service Accounts nach dem Least-Privilege-Prinzip konfigurieren.

Google kennzeichnet die Workspace CLI ausdrücklich als „nicht offiziell unterstützt“, obwohl das Tool von Google entwickelt wird. Die Workspace CLI unterscheidet sich von der 2025 veröffentlichten Gemini CLI [1], die als terminal-basiertes KI-Coding-Tool konzipiert ist. Weitere Informationen finden sich im GitHub-Repository des Projekts [2].

URL dieses Artikels:

https://www.heise.de/-11204118

Links in diesem Artikel:

[1] https://www.heise.de/news/Googles-Top-KI-Modell-Gemini-2-5-Pro-kostenlos-und-Open-Source-fuer-die-Konsole-10458718.html

[2] https://github.com/googleworkspace/cli

[3] https://www.heise.de/ix

[4] mailto:fo@heise.de

Copyright © 2026 Heise Medien

(Bild: Tatiana Popova/Shutterstock.com)

Die OpenJS Foundation hat ein neues Programm gestartet, um Unternehmen beim Umstieg auf aktuelle Node.js-Versionen zu unterstützen.

Etwa zwei Drittel der Node.js-Anwender nutzen eine veraltete Version der JavaScript-Runtime. Zu diesem Schluss kommt die OpenJS Foundation, die hinter Node.js steht. Sie hat daher ein neues Programm ins Leben gerufen, um dem entgegenzuwirken.

Das „Node.js LTS Upgrade and Modernization“-Programm soll Unternehmen dabei unterstützen, von Legacy-Node.js-Versionen und solchen, die bereits ihr End of Life erreicht haben, auf aktuelle Versionen zu wechseln. Dabei soll dieser Umstieg auf sichere Weise geschehen. Denn wie Robin Bender Ginn, Executive Director der OpenJS Foundation, zu bedenken gibt [3], verlassen sich viele Unternehmen bei kritischen Systemen auf Node.js. Daher könne das Upgraden älterer Versionen schwierig und risikoreich sein.

Konkret soll das neue Programm den Kontakt zwischen Unternehmen und erfahrenen Node.js-Serviceanbietern herstellen, um eine sichere Node.js-Aktualisierung zu erreichen. Es folgt dem bestehenden Vergütungsmodell der OpenJS Foundation, der Nonprofit-Stiftung hinter Node.js: Partner erhalten 85 Prozent der Einnahmen, während die verbleibenden 15 Prozent in die Unterstützung von OpenJS und Node.js fließen.

Als erster Partner des Programms fungiert das 2014 gegründete Softwareunternehmen NodeSource. Es wird ein Assessment von Node.js-Versionen, Dependencies und Risiken anbieten, ebenso wie Pläne für eine schrittweise Aktualisierung auf neuere Node.js-Versionen und eine Hands-on-Ausführung inklusive Code, Dependencies und Testing. Optional können Unternehmen von NodeSource Security-Support für Systeme beziehen, die sich nicht sofort aktualisieren lassen.

Die OpenJS Foundation unter dem Dach der Linux Foundation entstand 2019 aus einer Fusion [4] der Node.js Foundation und der JS Foundation, ebenfalls beide bei der Linux Foundation verortet. Sie ist Heimat zahlreicher Open-Source-Projekte im JavaScript-Bereich, neben Node.js unter anderem Electron, webpack und jQuery. Zu ihren Mitgliedsunternehmen [5] zählen Microsoft, Google und IBM.

Weitere Informationen zum neuen Programm „Node.js LTS Upgrade and Modernization“ bietet der Blog der OpenJS Foundation [6].

URL dieses Artikels:

https://www.heise.de/-11203970

Links in diesem Artikel:

[1] https://enterjs.de/?wt_mc=intern.academy.dpunkt.konf_dpunkt_vo_enterJS.empfehlung-ho.link.link

[2] https://enterjs.de/tickets.php?wt_mc=intern.academy.dpunkt.konf_dpunkt_vo_enterJS.empfehlung-ho.link.link

[3] https://openjsf.org/blog/nodejs-lts-upgrade-program

[4] https://www.heise.de/news/Node-js-und-JS-Foundation-gehen-in-neuer-OpenJS-Foundation-auf-4333892.html

[5] https://openjsf.org/members

[6] https://openjsf.org/blog/nodejs-lts-upgrade-program

[7] mailto:mai@heise.de

Copyright © 2026 Heise Medien

Unter seinem Codenamen Bartlett Lake geistert der LGA1700-Prozessor seit Jahren herum, nun erscheint er tatsächlich – aber nur für Server und Embedded Systems.

Intel bringt einen nagelneuen Prozessor für die mehr als vier Jahre alte Fassung LGA1700: den „Core 2 Series 200 with P-Cores“ alias Bartlett Lake. Die Besonderheit dieser CPU-Baureihe ist, dass sie acht, zehn oder zwölf Performance-Kerne (P-Cores) hat, aber keine Effizienzkerne. Es gibt zwar längst schon LGA1700-Prozessoren mit viel mehr CPU-Kernen, davon waren bisher aber maximal acht P-Kerne.

Die Baureihe Core 2 200PE ist nicht für gängige Desktop-PCs gedacht, sondern vor allem für Industriecomputer und Embedded Systems – daher auch der Buchstabe „E“ in den Typenbezeichungen. Auf den meisten LGA1700-Mainboards funktioniert ein Core 2 200PE erst gar nicht. Doch es gibt bereits eine große Auswahl an kompatiblen LGA1700-Boards mit den Chipsätzen R680E, Q670E oder H610E. Mehrere Hersteller stellen schon die nötigen BIOS-Updates für Bartlett Lake bereit.

Die Fassung LGA1700 debütierte Ende 2021 gemeinsam mit dem Core i-12000 Alder Lake, also dem Core i der 12. Generation aus der Fertigungstechnik „Intel 7“, die Intel davor noch 10-Nanometer-Technik nannte. Der entstammen auch die nachfolgenden (und letzten), bis heute gefertigten Core-i-Generationen 13 (Raptor Lake) und 14 (Raptor Lake Refresh).

Schon seit Anfang 2025 liefert Intel Embedded-Versionen der Raptor-Lake-CPUs für LGA1700-Boards wie Core 3 201E [1], Core 5 211E [2] und Core 7 251E [3], die den Codenamen Bartlett Lake tragen. Einige enthalten aber auch E-Cores, zusätzlich zu P-Cores. Diese hybride Mischung eignet sich für manche Anwendungen schlecht, wenn es dabei auf vorhersagbare Latenzen ankommt. In Serverprozessoren (Xeons) kommen daher stets nur Kerne gleicher Bauart zum Einsatz, übrigens auch bei AMD (Epyc) und bei ARM-Serverprozessoren.

Auf Mainboards mit dem Chipsatz R680E steuern die neuen Bartlett-Lake-Prozessoren auch ungepufferte DDR5-Speichermodule mit zusätzlichen DRAM-Chips für Error Correction Code (ECC) an.

Viele Embedded Systems mit x86-Technik nutzen Embedded-Versionen von sparsameren und kompakteren Mobilprozessoren. Dafür bieten sowohl AMD als auch Intel jeweils mehrere Serien von lange lieferbaren Chips an.

Die gesockelten Embedded-Prozessoren bieten höhere Rechenleistungen und mehr PCIe-5.0-Lanes für Erweiterungskarten. Sie kommen beispielsweise in Industrierobotern, bildgebenden Medizingeräten, Netzwerkkomponenten wie Firewalls und auch in manchen kompakten (Storage-)Servern zum Einsatz.

AMD verkauft schon länger Ryzen-Embedded-Versionen mit deutlich mehr starken Kernen als Intel, etwa den Ryzen Embedded 7000 [4] mit bis zu 12 Zen-4-Kernen und den Ryzen Embedded 9000 [5] mit bis zu 16 Zen-5-Kernen. Eng verwandt sind die Serverversionen Epyc 4004 (Zen 4/AM4/DDR4-RAM) [6] und Epyc 4005 (Zen 5/AM5/DDR5-RAM) [7] mit jeweils bis zu 16 CPU-Kernen.

Intel kann nun immerhin bei der Anzahl der P-Kerne dichter an die AMD-Konkurrenz für diese Geräte- und Preisklassen mit zwei DDR5-RAM-Kanälen heranrücken. Als Vorteile im Vergleich zum AMD Ryzen Embedded 9700X verspricht Intel für den Core 9 273PE eine niedrigere PCIe-Latenz. Außerdem erwähnt Intel Time Coordinated Computing (TCC) und Ethernet-Adapter mit Time-Sensitive Networking (TSN). Die Bartlett-Lake-Chips will Intel zehn Jahre lang liefern.

Auf der Fachmesse Embedded World in Nürnberg will Intel auch Embedded-Versionen der zu Jahresbeginn vorgestellten Mobilprozessorfamilie Core Ultra 300 (Panther Lake) [8] zeigen. Sie findet vom 10. bis 12. März statt.

(Bild: Congatec)

Unter anderem Congatec hat bereits ein Modul in der Bauform COM-HPC Client Size A angekündigt, das conga-HPC/cPTL [9]. Es bietet eine LPCAMM2-Fassung für ein LPDDR5X-Speichermodul [10] mit bis zu 32 GByte Kapazität.

|

Embedded-Prozessoren Intel Core 2 with P-Cores (Bartlett Lake, Intel 7, LGA1700) |

||||

| Prozessor | P-Kerne |

Takt (Basis / Turbo) |

Cache | TDP |

| Core 9 273PQE | 12 | 3,4 / 5,9 GHz | 36 MByte | 125 W |

| Core 9 273PE | 12 | 2,3 / 5,7 GHz | 36 MByte | 65 W |

| Core 9 273PTE | 12 | 1,4 / 5,5 GHz | 36 MByte | 45 W |

| Core 7 253PQE | 10 | 3,5 / 5,7 GHz | 33 MByte | 125 W |

| Core 7 253PE | 10 | 2,5 / 5,5 GHz | 33 MByte | 65 W |

| Core 7 253PTE | 10 | 1,8 / 5,4 GHz | 33 MByte | 45 W |

| Core 5 223PQE | 8 | 4,0 / 5,5 GHz | 24 MByte | 125 W |

| Core 5 223PE | 8 | 2,9 / 5,4 GHz | 24 MByte | 65 W |

| Core 5 223PTE | 8 | 2,3 / 5,4 GHz | 24 MByte | 45 W |

| Core 5 213PE | 8 | 2,7 / 5,2 GHz | 24 MByte | 65 W |

| Core 5 213PTE | 8 | 2,1 / 5,2 GHz | 24 MByte | 45 W |

| ebenfalls verfügbar | ||||

| Core 3 201E | 4 | 3,6 / 4,8 GHz | 12 MByte | 60 W |

| Core 3 201TE | 4 | 2,9 / 4,6 GHz | 12 MByte | 45 W |

URL dieses Artikels:

https://www.heise.de/-11197373

Links in diesem Artikel:

[1] https://www.intel.de/content/www/de/de/products/sku/242804/intel-core-3-processor-201e-12m-cache-up-to-4-80-ghz/specifications.html

[2] https://www.intel.de/content/www/de/de/products/sku/242797/intel-core-5-processor-211e-20m-cache-up-to-4-90-ghz/specifications.html

[3] https://www.intel.de/content/www/de/de/products/sku/242803/intel-core-7-processor-251e-36m-cache-up-to-5-60-ghz/specifications.html

[4] https://www.amd.com/de/products/embedded/ryzen/ryzen-7000-series.html

[5] https://www.amd.com/de/products/embedded/ryzen/9000-series.html

[6] https://www.heise.de/news/Epyc-4004-ab-149-US-Dollar-AMD-Ryzen-Prozessoren-mit-ECC-RAM-fuer-kleine-Server-9725458.html

[7] https://www.heise.de/news/AMD-Epyc-4005-Sechs-Prozessoren-fuer-kleine-Server-mit-ECC-RAM-10381348.html

[8] https://www.heise.de/tests/Asus-ZenBook-Duo-mit-Intels-neuem-Core-Ultra-X9-388H-im-Test-11137702.html

[9] https://www.congatec.com/de/produkte/com-hpc/conga-hpccptl/

[10] https://www.heise.de/news/Schneller-LPDDR5X-Arbeitsspeicher-als-Steckmodul-lieferbar-LPCAMM2-9712390.html

[11] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[12] https://www.heise.de/ct

[13] mailto:ciw@ct.de

Copyright © 2026 Heise Medien

Wenn Sie auf diesen Link klicken und darüber einkaufen, erhält Golem eine kleine Provision. Dies ändert nichts am Preis der Artikel.

Ein tragbarer Akku-Kompressor ist vielseitig einsetzbar, etwa beim Aufpumpen von Autoreifen, Fahrradreifen oder Sportbällen. Modelle etablierter Marken kosten jedoch häufig über 80 Euro. Ein günstiges Angebot kommt derzeit vom Anbieter Qupeer: Ein kompakter Akku-Kompressor, der mit Makitas 18-Volt-Akkus kompatibel ist, wird zeitlich begrenzt für 35,95 Euro angeboten. Der Versand erfolgt über Amazon, verkauft wird das Gerät über einen Drittanbieter.

Der Kompressor richtet sich in erster Linie an Nutzer, die bereits Geräte aus dem Makita-18-Volt-System besitzen. Laut Hersteller ist das Gerät mit gängigen Akkus der Serien BL1820, BL1830, BL1840, BL1850 und BL1860 kompatibel. Der Akku selbst gehört nicht zum Lieferumfang.

Das Konzept ist grundsätzlich sinnvoll: Wer bereits Makita-Akkus besitzt, kann ein weiteres Gerät nutzen, ohne zusätzliche Akkus kaufen zu müssen. Gleichzeitig spart der Hersteller so Kosten.

Nach Herstellerangaben erreicht der Kompressor einen maximalen Druck von 10,34 bar (150 PSI). Damit liegt er auf einem Niveau, das für viele typische Anwendungen ausreicht: für PKW-Reifen, Motorradreifen, Fahrradreifen, Sportbälle und kleinere aufblasbare Gegenstände. Für größere Reifen ist das Gerät laut Hersteller nicht gedacht, etwa für die von Lkw oder schweren Nutzfahrzeugen.

Wie schnell der Kompressor tatsächlich arbeitet, hängt stark vom verwendeten Akku und vom gewünschten Druck ab. Bei günstigen Akku-Kompressoren kann das Aufpumpen größerer Autoreifen deutlich länger dauern als bei stationären Geräten oder leistungsstärkeren Markenmodellen.

Zur Ausstattung gehört ein beleuchtetes Display, das aktuellen Druck, Zielwert und Akkustand anzeigen soll. Außerdem stehen vier Modi zur Verfügung: Auto, Motorrad, Fahrrad, Ball. Zusätzlich lassen sich mehrere Druckeinheiten einstellen (PSI, Bar, kPa, kg/cm²).

Praktisch klingt die Auto-Stop-Funktion: Der Kompressor beendet den Pumpvorgang laut Anbieter automatisch, sobald der eingestellte Druck erreicht ist. Das kann verhindern, dass Reifen versehentlich zu stark aufgepumpt werden.

Für Einsätze bei schlechten Lichtverhältnissen ist eine integrierte LED-Leuchte verbaut. Gerade bei Reifenpannen oder Druckkontrollen am Straßenrand kann das hilfreich sein.

Ein kleines Zubehörfach im Gehäuse soll verhindern, dass die mitgelieferten Adapter verloren gehen. Zum Lieferumfang gehören gemäß Anbieter vier Düsen, so dass neben Reifen auch Bälle oder Luftmatratzen aufgepumpt werden können.

Auf Amazon erreicht der Kompressor aktuell 4,4 von 5 Sternen bei rund 350 Bewertungen. Solche Werte deuten meist darauf hin, dass viele Käufer mit dem Gerät zufrieden sind. Dennoch lohnt ein genauer Blick auf mögliche Einschränkungen.

Bei günstigen Akku-Kompressoren zeigen sich häufig typische Kritikpunkte: begrenzte Dauerleistung bei größeren Reifen; höhere Lautstärke während des Betriebs; einfachere Verarbeitung im Vergleich zu Markenprodukten; abhängige Leistung vom eingesetzten Akku.

Auch die langfristige Haltbarkeit lässt sich bei vielen günstigen Importmarken schwierig einschätzen.

Der größte Vorteil liegt beim Preis. Mit 35,95 Euro im Aktionsangebot

Akku Kompressor kompatibel mit Makita 18V

Zum AngebotWenn Sie auf diesen Link klicken und darüber einkaufen, erhält Golem eine kleine Provision. Dies ändert nichts am Preis der Artikel.

Deutsche Giganetz hat sich in den vergangenen Monaten aus vielen Glasfaserprojekten zurückgezogen. Die Stadt Duisburg ist aus einer Ausbaukooperation mit dem FTTH-Betreiber ausgestiegen. In Erfurt und Dresden wurde die Quote nicht erreicht, und auch in Mainz war "die Resonanz nicht ausreichend" .

In der Ruhrgebietsstadt sind außerdem die Deutsche Telekom und deren Partner Westconnect beim Glasfaserausbau aktiv. Duisburg und Deutsche Giganetz hatten am 25. November 2022 im Rathaus eine Vereinbarung unterzeichnet.

Laut einem Bericht von Radio Duisburg (Funke Mediengruppe) war der Grund nicht eingehaltene Zusagen beim geplanten Glasfaserausbau. Im Januar 2026 übernahm die städtische Duisburg Citycom demnach große Teile des Projekts. Andrea Lutz von den Grünen sagte dem Sender: "Endlich hat die Stadt der schlechten Planung und trägen Umsetzung Rechnung getragen und beendet die Zusammenarbeit mit Giganetz beim Glasfaserausbau." Die Verunsicherung der Bürger sei damit nicht vom Tisch.

Fast alle Glasfaser-ausbauenden Unternehmen sind durch die gestiegenen Zinsen und den Überbau durch die Telekom unter Druck.

Carmen Fesenbeck, Sprecherin von Deutsche Giganetz, sagte Golem am 9. März 2026 auf Anfrage, dass das Unternehmen nicht in Schwierigkeiten sei. Einen kompletten Rückzug aus bestimmten Regionen werde es nicht geben. "Deutsche Giganetz baut wie immer bundesweit, ohne Beschränkung auf Regionen, also momentan in West, Ost, Mitte, Süd. In 50 Projekten wird gerade aktiv gebaut. In 70 Projekten wurde der Initialbau abgeschlossen, wobei in fast allen derzeit Nachverdichtungsaktivitäten stattfinden. Vier Projekte im Süden, in Mitte und im Westen beginnen jetzt im März mit dem Ausbau. Wir bauen zum Beispiel aktuell fleißig noch in Calbe und Egener Mulde, begleitet von Spatenstichen in den kommenden Wochen und in Hamm nächste Woche. Zusätzlich starten wir sechs Förderprojekte im Bau im April." Man baue aber natürlich absolut fokussiert.

In Mainz komme hinzu, dass ein Wettbewerber baut, und "wir keinen Überbau machen, weshalb wir dann auf Open Access setzen wollen" . Bei dem Wettbewerber handelt es sich laut Medienberichten um die Telekom.

Ausbauaktivitäten würden in eine Priorisierung geschoben, die der tatsächlich möglichen Umsetzung entspreche, erklärte Fesenbeck. Vermarktungen dauerten länger als geplant und der Ausbau benötige längere Abstimmungszeiträume mit den Kommunen, bei Genehmigungsverfahren sowie der baulichen Umsetzung.

Fesenbeck: "Kundinnen und Kunden, die nach Abschluss eines Glasfaservertrages mehr als ein Jahr auf ihren Glasfaseranschluss warten müssen, sind zunehmend ungeduldiger und müssen schneller bedient werden. Daher ergibt es Sinn, die Projekte erst dann in die Vermarktung zu bringen, wenn ein klarer, direkt daran anschließender Bauplan mit allen notwendigen Voraussetzungen vereinbart ist."

Zeit koste es auch, wenn man "die mangelhafte Arbeit von Generalunternehmen aus der Vergangenheit beseitigen" müsse, sagte sie.

Wenn Sie auf diesen Link klicken und darüber einkaufen, erhält Golem eine kleine Provision. Dies ändert nichts am Preis der Artikel.

Kaffee gehört für viele zum Start in den Tag oder ist eine kleine Pause zwischendurch. Die Nespresso-Kaffeemaschine liefert genau das, schnell und unkompliziert. Die berührungsgesteuerte Oberfläche macht die Bedienung einfach: Ein kurzes Tippen, und der Brühvorgang startet. Programmierungen oder komplizierte Einstellungen sind nicht nötig.

Die Maschine dosiert zuverlässig die gewünschte Menge Kaffee. Im Lieferumfang sind sieben Kapseln enthalten, so dass direkt ausprobiert werden kann, wie unterschiedlich der Kaffee schmeckt.